Spracherkennung offline bedeutet, dass Sprachbefehle direkt auf dem Gerät verarbeitet werden – ohne Cloud, ohne Internetverbindung und ohne permanente Übertragung von Audiodaten. Das ist besonders attraktiv, wenn Datenschutz und geringe Latenz wichtig sind: Ein Smart-Home-Schalter soll sofort reagieren, ein Industriepanel soll auch im Funkloch zuverlässig funktionieren, und ein Wearable soll nicht erst einen Server anfragen müssen. Gleichzeitig ist Offline-Sprachsteuerung technisch anspruchsvoll, weil sie mit begrenzter Rechenleistung, wenig Arbeitsspeicher und oft schwierigen akustischen Bedingungen (Hall, Hintergrundlärm, unterschiedliche Stimmen) umgehen muss. Wer sich jedoch an bewährte Konzepte hält, kann sehr zuverlässige Systeme bauen – vom einfachen „Ein/Aus“-Befehl bis hin zu kleinen, lokalen Vokabularen für Menüsteuerung. Der Schlüssel ist, die richtige Technik für den passenden Anwendungsfall zu wählen: Manchmal reicht ein Wake-Word plus wenige Kommandos (Keyword Spotting). In anderen Projekten ist ein kleines Offline-ASR-System sinnvoll, das kurze Sätze erkennt. Dieser Artikel erklärt praxisnah, welche Ansätze es gibt, welche Hardware und Mikrofone sich eignen, wie ein typischer Offline-Workflow aussieht, wie Sie Fehlalarme reduzieren und wie Sie Spracherkennung offline so integrieren, dass sie robust, sicher und langfristig wartbar bleibt.

Warum Offline-Sprachbefehle sinnvoll sind

Cloud-Spracherkennung ist bequem, aber nicht immer passend. Offline-Verarbeitung bietet Vorteile, die sich in echten Projekten schnell bemerkbar machen: Reaktionszeit, Zuverlässigkeit und Kontrolle über die eigenen Daten. Gerade in privaten Umgebungen oder im industriellen Umfeld kann es entscheidend sein, dass Audiodaten das Gerät nicht verlassen.

- Datenschutz: Audiosignale bleiben lokal, es wird nichts „mitgehört“ und hochgeladen

- Geringe Latenz: Befehle werden in Millisekunden verarbeitet, ohne Netzwerklaufzeit

- Offline-Fähigkeit: funktioniert ohne Internet, auch bei Ausfall des Routers

- Kostenkontrolle: keine laufenden Cloud-Kosten, keine API-Limits, kein Traffic

- Robustheit: weniger externe Abhängigkeiten, leichter langfristig betreibbar

Wenn Sie die Begriffe einordnen möchten, hilft ein Blick auf Spracherkennung und Automatic Speech Recognition (ASR).

Die zwei Hauptansätze: Keyword Spotting vs. vollständige Spracherkennung

Offline-Sprachsteuerung ist nicht gleich Offline-Sprachsteuerung. In der Praxis dominieren zwei Ansätze, die sehr unterschiedliche Anforderungen haben. Wer das verwechselt, landet schnell bei unnötiger Komplexität oder enttäuschender Erkennungsrate.

Keyword Spotting: Wenige Befehle, hohe Zuverlässigkeit

Keyword Spotting (auch „Command Recognition“ oder „Befehlswort-Erkennung“) erkennt eine kleine Menge vordefinierter Wörter oder Phrasen wie „Licht an“, „Stopp“, „Start“, „Lauter“. Dieser Ansatz ist ideal für Mikrocontroller und stromsparende Systeme, weil Modelle klein sind und sich gut optimieren lassen. Außerdem ist die Fehlerrate bei gutem Training und sauberem Audio oft deutlich besser als bei „freier“ Sprache.

- Typisch: 5–30 Kommandos, manchmal plus Wake-Word

- Vorteil: schnell, sparsam, robust gegen Rechenlimits

- Nachteil: begrenztes Vokabular, weniger natürliches Sprechen

Offline-ASR: Kurze Sätze und größere Vokabulare

Bei Offline-ASR (Automatic Speech Recognition) wird Sprache in Text umgewandelt oder gegen ein größeres Vokabular gematcht. Das ist flexibler, benötigt aber meist deutlich mehr Rechenleistung und Speicher. Häufig ist das eher ein Thema für Einplatinencomputer oder leistungsfähige MCUs/SoCs, nicht für sehr kleine Controller.

- Typisch: Menüsteuerung, kurze Sätze, lokale Dialoge

- Vorteil: natürlicher, mehr Ausdrucksmöglichkeiten

- Nachteil: höherer Ressourcenbedarf, komplexere Integration

Wake-Word offline: Erst „aktivieren“, dann Befehle verarbeiten

Ein bewährtes Muster für Offline-Sprachsteuerung ist die Kombination aus Wake-Word (z. B. „Computer“, „Hallo Gerät“) und anschließenden Befehlen. Das reduziert Fehlaktivierungen, spart Energie und ist aus Datenschutzsicht sauberer: Das System muss nicht permanent komplexe Erkennung auf volle Phrasen anwenden, sondern reagiert nur nach einer klaren Aktivierung.

- Energie sparen: Wake-Word läuft „leichtgewichtig“, ASR/Kommandos nur bei Aktivierung

- Weniger Fehlalarme: zufällige Wörter lösen nicht sofort Aktionen aus

- Bessere UX: klarer Ablauf: Aktivieren → Befehl

- Sicherheit: kritische Aktionen können zusätzlich bestätigt werden

Ein bekannter Ansatz für Wake-Word-Erkennung ist „Porcupine“; Details finden Sie über Porcupine Wake Word Engine (Herstellerseite, inklusive Embedded-Optionen).

Hardwarewahl: Mikrocontroller, SBC oder Hybrid?

Ob ein Projekt auf einem Mikrocontroller oder besser auf einem kleinen Linux-System läuft, hängt von Vokabular, Latenz, Strombudget und Update-Strategie ab. Für wenige Kommandos reicht oft ein MCU. Für flexible Offline-ASR ist ein SBC wie Raspberry Pi oder ein leistungsfähiger SoC oft angenehmer.

- Mikrocontroller: ideal für Keyword Spotting, Wake-Word, sehr niedrigen Stromverbrauch

- Einplatinencomputer (Linux): ideal für größere Modelle, komfortable Toolchains, mehr Speicher

- Hybrid: MCU macht Wake-Word + Ereignis, SBC macht bei Bedarf ASR und Logik

Faustregel für Einsteiger

Wenn Sie maximal 10–20 Befehle brauchen und das Gerät mit Batterie laufen soll, ist Keyword Spotting auf einem Mikrocontroller oft die beste Wahl. Wenn Sie freie Sprache oder viele Formulierungen verstehen müssen, ist ein Linux-System meist der pragmatischere Einstieg.

Mikrofon und Audio-Frontend: Der unterschätzte Erfolgsfaktor

Viele Offline-Projekte scheitern nicht am Modell, sondern an schlechtem Audio. Ein Mikrocontroller kann nur das erkennen, was am Mikrofon ankommt. Hallige Räume, Lüftergeräusche, schlechte Mikrofonposition und Störungen der Stromversorgung verschlechtern die Erkennung massiv. Deshalb lohnt es sich, dem Audio-Frontend früh Aufmerksamkeit zu geben.

- Mikrofontyp: MEMS-Mikrofone sind kompakt und verbreitet

- Digital vs. analog: I2S/PDM-Mikrofone liefern meist sauberere Signale als günstige analoge Module

- Abstand: 30–100 cm sind für viele Setups realistischer als „aus dem Nebenraum“

- Position: weg von Motoren/Netzteilen, nicht in Gehäusekanten „eingeschnürt“

- Stromversorgung: saubere 3,3 V/5 V, Entkopplung gegen Störspitzen

Rauschunterdrückung und Echo-Cancelling

Wer Lautsprecher und Mikrofon im selben Gerät hat (z. B. Sprachfeedback), braucht oft Echo-Unterdrückung. Für Mikrocontroller ist das nicht trivial. In solchen Fällen ist ein SBC oder ein spezielles Audio-Frontend (DSP) häufig die bessere Basis.

Workflow: So entsteht Offline-Spracherkennung in einem realen Projekt

Ein professioneller Workflow verhindert, dass Sie am Ende ein System haben, das nur „am Schreibtisch“ funktioniert. Entscheidend sind realistische Daten, saubere Trennung von Training und Test sowie ein klarer Deployment-Prozess.

- Anforderungen definieren: Welche Befehle? Welche Umgebung? Wie viele Sprecher?

- Audio aufnehmen: im echten Raum, mit echtem Mikrofon, mit Hintergrundlärmvarianten

- Labeln: korrekte Zuordnung von Kommandos und Negativbeispielen („kein Befehl“)

- Training/Feintuning: kleines Modell, stabile Feature-Extraction (z. B. MFCC)

- Optimieren: Quantisierung, Modellgröße reduzieren, Laufzeit messen

- Integration: Audio-Pipeline, Erkennungslogik, Schwellenwerte, Zustände

- Feldtest: Fehlalarme pro Stunde, Erkennungsrate in Alltagssituationen

Negativdaten sind Pflicht

Für wenige Kommandos reicht es nicht, nur „Licht an“ und „Licht aus“ aufzunehmen. Sie brauchen viele Beispiele, in denen niemand einen Befehl sagt: Gespräche, Radio im Hintergrund, typische Haushaltsgeräusche. Diese Negativdaten sind entscheidend, um Fehlaktivierungen zu reduzieren.

Modelle und Libraries: Praktische Optionen für Offline-Sprachbefehle

Die Wahl der Software hängt stark davon ab, ob Sie auf Mikrocontroller- oder Linux-Ebene arbeiten. Für Mikrocontroller sind kleine Inferenz-Engines und Keyword-Modelle üblich. Für Linux sind komplette Offline-ASR-Stacks verfügbar.

TinyML/Embedded: Kommandos und Wake-Word

Im Embedded-Umfeld ist TensorFlow Lite for Microcontrollers eine gängige Grundlage, um kleine Modelle auf MCUs auszuführen. Typisch ist eine Pipeline aus Audioaufnahme, Feature-Extraction (z. B. MFCC) und einem kleinen Klassifikationsnetz. Für Wake-Word gibt es spezialisierte Engines (siehe oben), die oft deutlich effizienter sind als „selbst gebaut“.

Linux/SBC: Offline-ASR für echte Sprache

Wenn Sie Text aus Sprache erzeugen möchten, ist ein lokales ASR-System sinnvoll. Eine verbreitete Offline-Option ist Vosk, das auf vielen Plattformen funktioniert und offline nutzbar ist. Für eine klassische, eher ressourcenschonende ASR gibt es CMU Sphinx (PocketSphinx). Welche Lösung passt, hängt von Sprache, Hardware und gewünschter Qualität ab.

Erkennungslogik: Schwellen, Zustände und Fehlalarme reduzieren

Offline-Erkennung ist nie „magisch“. Sie benötigen eine Logik, die Modell-Ausgaben sinnvoll interpretiert. Viele Systeme liefern Wahrscheinlichkeiten pro Klasse. Wenn Sie jede Ausgabe sofort als Befehl ausführen, wird es Fehlreaktionen geben. Besser ist ein mehrstufiges Vorgehen mit Zuständen, Mindestkonfidenz und zeitlicher Stabilisierung.

- Konfidenzschwelle: Befehl nur akzeptieren, wenn Wahrscheinlichkeit über X liegt

- Mehrfachbestätigung: derselbe Befehl muss in 2–3 Fenstern konsistent erscheinen

- Cooldown-Zeit: nach erfolgreichem Befehl kurze Sperre gegen Doppeltrigger

- Hysterese: unterschiedliche Schwellwerte für Aktivierung und Deaktivierung

- „Unknown“-Klasse: bewusste „kein Befehl“-Kategorie verhindert Zwangsklassifikation

Warum „Unknown“ und „Silence“ echte Qualitäts-Booster sind

Viele Keyword-Modelle werden stabiler, wenn sie explizit für „Unbekannt“ (alles andere) und „Stille“ trainiert werden. Dadurch lernt das Modell, Nicht-Befehle als Nicht-Befehle zu erkennen, statt irgendetwas zu raten.

Mehrsprachigkeit und Deutsch: Was Sie realistisch erwarten sollten

Deutsch offline zu erkennen ist möglich, aber die Qualität hängt stark von Daten und Modell ab. Für Keyword Spotting ist Deutsch oft unkritisch, weil Sie gezielt wenige Phrasen trainieren. Für allgemeine Offline-ASR ist die Sprachunterstützung des Systems entscheidend (Modelle, Wörterbücher, Akustikmodelle). Achten Sie darauf, dass das Tool Ihrer Wahl ein brauchbares deutsches Modell bietet und dass Ihre Zielumgebung (z. B. Dialekte, Hall, Abstand) in den Testdaten berücksichtigt ist.

- Keyword Spotting: gut für Deutsch, weil Sie eigene Kommandos trainieren können

- Offline-ASR: Qualität stark modellabhängig, reale Tests sind Pflicht

- Dialekte: erhöhen den Bedarf an vielfältigen Trainings-/Testdaten

- Umgebung: Küchen, Badezimmer, Werkstätten sind akustisch „härter“ als ein Büro

Sicherheit und Missbrauch: Offline heißt nicht automatisch „sicher“

Wenn ein Gerät Sprachbefehle ausführt, sollten Sie Sicherheitsaspekte berücksichtigen – besonders bei Türen, Alarmanlagen oder kritischer Steuerung. Offline-Verarbeitung reduziert zwar Cloud-Risiken, verhindert aber nicht, dass jemand einen Befehl absichtlich vors Mikrofon spricht oder per Audio abspielt. Für sensible Funktionen sind zusätzliche Schutzmaßnahmen sinnvoll.

- Wake-Word + Bestätigung: kritische Aktionen doppelt absichern

- Kontextregeln: Befehle nur in bestimmten Zuständen zulassen (z. B. „Tür öffnen“ nur nach Authentifizierung)

- Physischer Schalter: Mikrofon-Hardware-Schalter oder „Push-to-talk“ für maximale Kontrolle

- Logging lokal: Ereignisse protokollieren, aber keine Roh-Audiodaten speichern

Push-to-talk als „einfacher“ Datenschutz

Wenn das Mikrofon nur aktiv ist, während eine Taste gedrückt wird, lösen Sie viele Datenschutz- und Fehlalarmprobleme auf einmal. Das ist weniger „smart“, aber oft die verlässlichste Lösung für DIY- und Prototyping-Projekte.

Praxisbeispiele: Welche Architektur passt zu welchem Projekt?

Um die Entscheidung greifbar zu machen, hilft ein Blick auf typische Projektmuster. Damit vermeiden Sie, eine Lösung zu wählen, die entweder überdimensioniert oder im Alltag zu fragil ist.

- Smart-Home-Schalter (Batterie): Wake-Word + 5–10 Kommandos auf MCU, Funk nur bei Aktion

- Werkstattsteuerung (Netzteil): Keyword Spotting mit robustem Mikrofon, große Negativdatenbasis

- Lokales Bedienpanel (Raspberry Pi): Offline-ASR mit begrenztem Vokabular und Menübefehlen

- Industriesensor: kein Freisprechen, sondern Push-to-talk oder klar definierte Befehle

Outbound-Ressourcen zur Vertiefung

- TensorFlow Lite for Microcontrollers: Embedded-Inferenz für Sprachmodelle und Keyword Spotting

- Vosk: Offline-Spracherkennung für lokale Anwendungen

- CMU Sphinx / PocketSphinx: Klassische Offline-ASR-Optionen

- Porcupine: Wake-Word-Erkennung für Embedded und Edge

- Spracherkennung: Begriffe und Grundlagen

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

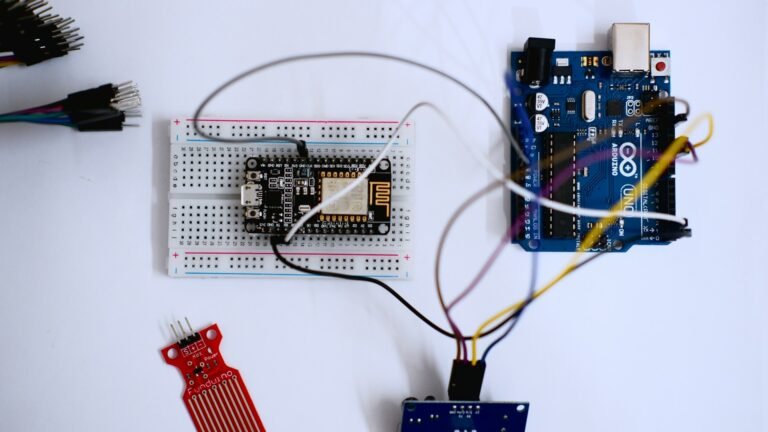

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.