Die Frage „KI auf dem Mega 2560: Ist TinyML mit 16 MHz möglich?“ taucht 2026 häufiger auf, weil viele Maker vorhandene Arduino-Mega-Projekte um einfache Mustererkennung, Anomalie-Checks oder Sprach-/Gesten-Trigger erweitern möchten. Die kurze Antwort lautet: Ja, TinyML kann auf dem Arduino Mega 2560 funktionieren – aber nur innerhalb klarer Grenzen. Der ATmega2560 ist ein 8-Bit-AVR-Controller mit 16 MHz Takt, sehr begrenztem RAM und ohne Hardware-FPU. Das heißt: Klassische „KI“ im Sinne großer neuronaler Netze ist nicht realistisch. Was hingegen sehr gut klappt, sind kompakte, stark quantisierte Modelle (typisch int8) oder sogar „ML-ähnliche“ Verfahren, die in C/C++ sehr effizient umgesetzt werden. Entscheidend sind dabei drei Punkte: Modellgröße (Flash), Arbeitsspeicherbedarf (SRAM, vor allem für Tensor-Arena und Zwischentensoren) und Rechenlast (Inferenzzeit pro Messfenster). Wer diese Parameter von Anfang an plant, kann mit dem Mega 2560 erstaunlich robuste TinyML-Anwendungen umsetzen – von Vibrationsklassifikation bis hin zu einfachen Keyword-Detektoren auf sehr kleinen Audioschnipseln.

Was „TinyML“ auf einem Mega 2560 praktisch bedeutet

TinyML ist kein einzelnes Framework, sondern ein Ansatz: Machine Learning so zu gestalten, dass es auf Mikrocontrollern mit wenigen Kilobyte RAM und begrenzter Rechenleistung läuft. Auf dem Mega 2560 heißt das in der Praxis meist:

- Inference statt Training: Das Training findet auf dem PC/Cloud statt; der Mega führt nur die Inferenz aus.

- Quantisierung: Modelle werden in 8-Bit (int8) oder sogar binärähnliche Darstellungen gebracht, um Speicher und Zeit zu sparen.

- Sehr kleine Netze: Wenige Layer, wenige Parameter, oft „klassische“ Features statt Rohdaten.

- Ops-Auswahl: Nur Operationen nutzen, die es als effiziente Microcontroller-Implementierung gibt (z. B. Fully Connected, Depthwise Conv in kleinen Varianten, einfache Aktivierungen).

Wichtig ist: Viele moderne TinyML-Beispiele im Netz zielen auf 32-Bit-MCUs (Cortex-M, ESP32). Auf dem Mega 2560 müssen Sie konservativer planen und häufiger mit Alternativen arbeiten.

Hardware-Realität: 16 MHz und knapper Speicher als Leitplanken

Der Arduino Mega 2560 ist beliebt, weil er viele Pins und Schnittstellen bietet. Für TinyML sind aber vor allem Flash und SRAM relevant. Laut offiziellen Board-Spezifikationen besitzt der Mega 2560 256 KB Flash (davon ein Teil für Bootloader) und 8 KB SRAM bei 16 MHz Takt. Eine gute Übersicht finden Sie in den Technischen Daten des Arduino Mega 2560 Rev3.

Für TinyML bedeutet das:

- Flash: Reicht für ein kleines Modell plus Runtime, aber die Runtime (Interpreter + Ops) kann schnell zehntausende Bytes beanspruchen.

- SRAM: 8 KB sind der Engpass. Neben Ihrem Sketch brauchen Sie Platz für Sensorpuffer, Feature-Vektoren, Stack/Heap und die „Arena“ (Arbeitsbereich) der ML-Runtime.

- CPU: 16 MHz ohne FPU zwingt zu Integer-Arithmetik und schlanken Modellen.

Frameworks und Tooling 2026: Was auf AVR realistisch ist

Wer „TinyML“ sagt, denkt häufig an TensorFlow Lite Micro. Wichtig: Die offizielle Arduino-Integration von TFLite Micro richtet sich primär an Boards mit mbed OS oder ESP32-Architektur. Das wird in vielen Ports und Dokumentationen explizit genannt, etwa in Arduino-orientierten TFLite-Micro-Bibliotheken, die als Zielplattform „mbed oder ESP32“ angeben. Ein Einstiegspunkt ist z. B. eine Arduino-orientierte TFLite-Micro-Implementierung auf GitHub: TensorFlow Lite Micro Library for Arduino.

Heißt das, AVR ist ausgeschlossen? Nicht zwingend – aber Sie benötigen entweder spezielle AVR-freundliche Ports oder Wrapper-Projekte, die bewusst auf kleine Modelle und minimalen RAM-Verbrauch ausgelegt sind.

Pragmatischer Weg: Sehr kleine Modelle mit EloquentTinyML & Co.

In der Maker-Szene wird für AVR häufig auf leichtgewichtige Wrapper gesetzt, die TensorFlow-Lite-Micro-Komponenten in stark abgespeckter Form nutzen. Ein bekanntes Beispiel ist EloquentTinyML. Die Idee: Sie exportieren ein quantisiertes TFLite-Modell, binden es als Byte-Array ein und führen die Inferenz mit minimaler Konfiguration aus. Die Projektseite mit Dokumentation und Beispielen finden Sie unter EloquentTinyML auf GitHub.

Für den Mega 2560 ist dabei besonders wichtig, dass Sie die Operatoren streng begrenzen (nur die, die Ihr Modell wirklich nutzt) und die Tensor-Arena so klein wie möglich halten. Außerdem sollten Sie Feature-Engineering ernst nehmen: Je besser Ihre Features die Aufgabe beschreiben, desto kleiner darf das Modell sein.

Edge Impulse als „TinyML-Generator“: Sinnvoll, aber kritisch prüfen

Für viele Einsteiger ist Edge Impulse attraktiv, weil es den Weg von Datenerfassung über Training bis zum Embedded-Export stark vereinfacht. Für sehr kleine MCUs existieren Community-Erfahrungen und Optimierungs-Tipps, z. B. im Edge Impulse Forum. Das ersetzt keine Spezifikationsprüfung, kann aber praxisnahe Hinweise liefern (z. B. welche DSP-Blöcke auf kleinen Controllern funktionieren und wie man Speicher spürt).

Wenn Sie Edge Impulse nutzen, achten Sie besonders auf:

- Exportformat (Arduino Library vs. C++ SDK) und ob es tatsächlich auf AVR kompiliert.

- Feature-Pipeline: Oft ist DSP/Feature-Extraction der Schlüssel, nicht das NN.

- RAM-Reporting: Prüfen Sie, wie viel „Arena“ bzw. Buffer tatsächlich benötigt wird.

Rechenleistung abschätzen: Was bedeutet 16 MHz für Inferenzzeiten?

Ob TinyML „flüssig“ läuft, hängt von Ihrer Zyklus-Bilanz ab. Eine grobe Abschätzung hilft, bevor Sie Tage in Training und Portierung stecken. Nehmen wir an, Ihr Modell benötigt N elementare Operationen (z. B. Multiply-Accumulate, MAC). Wenn eine Operation im Mittel c CPU-Zyklen benötigt, ergibt sich die Rechenzeit aus:

Dabei ist f die Taktfrequenz (hier 16 MHz). Beispiel: Ein sehr kleines Modell mit 10 000 MACs und durchschnittlich 10 Zyklen pro MAC hätte:

Also ca. 6,25 ms reine Rechenzeit – das wäre für viele Sensoraufgaben problemlos. In der Realität kommen Overhead (Interpreter, Speicherzugriffe, Aktivierungen) hinzu, und manche Operationen sind teurer. Trotzdem zeigt die Rechnung: TinyML ist möglich, solange N klein bleibt.

Speicherbedarf verstehen: Flash vs. SRAM und die „Tensor-Arena“

Auf dem Mega 2560 ist SRAM die härteste Grenze. Grob setzen sich die RAM-Anforderungen zusammen aus:

- Stacks/Heap Ihres Sketches

- Sensorpuffer (z. B. Audio-Fenster, IMU-Ringbuffer)

- Feature-Vektoren (z. B. MFCCs, Statistiken)

- ML-Runtime-Arbeitsbereich („Arena“), inklusive Zwischentensoren

Ein häufiger Fehler ist, den Modell-Flash zu optimieren, aber die Arena zu groß zu lassen. In vielen TinyML-Setups ist nicht das Modell selbst das RAM-Problem, sondern die Zwischentensoren während der Ausführung. Je komplexer das Netz (mehr Layer, mehr Kanäle), desto größer wird die Arena.

Welche TinyML-Aufgaben sind auf dem Mega 2560 realistisch?

Wenn Sie die Grenzen akzeptieren, gibt es sehr sinnvolle Einsatzfelder:

- Zustandsklassifikation aus Sensorwerten: Vibration „normal“ vs. „Fehler“, Motor „läuft“ vs. „blockiert“, Tür „offen“ vs. „geschlossen“ anhand Beschleunigungsprofilen.

- Anomalie-Erkennung mit kleinen Feature-Sets: Schwellenwert-basierte Features plus kleiner Klassifikator.

- Gesten/Bewegungsmuster: IMU-Daten in kurzen Fenstern, stark komprimierte Features.

- Einfache Audio-Trigger: Sehr kleine Keyword-Modelle nur mit wenigen Klassen – aber hier ist RAM besonders kritisch.

Weniger realistisch (oder nur mit massiven Kompromissen): Bildverarbeitung, komplexe Sprachmodelle, große CNNs oder alles, was lange Sequenzen mit viel Kontext benötigt.

Die wichtigsten Optimierungshebel für TinyML auf AVR

Quantisierung konsequent nutzen

Für den Mega 2560 ist int8-Quantisierung praktisch Pflicht. Sie sparen Flash und Rechenzeit und vermeiden float-lastige Pfade. Achten Sie darauf, dass Ihr Export tatsächlich vollständig quantisiert ist und keine „Hidden Floats“ im Pre/Postprocessing versteckt sind.

Feature-Engineering statt Rohdaten

Je „intelligenter“ Ihre Features, desto kleiner kann das Netz sein. Statt 512 Rohwerte pro Fenster einzuspeisen, reichen manchmal 10–30 Merkmale (Mittelwert, Varianz, Peak, Frequenzband-Energie). Das reduziert sowohl N (Ops) als auch RAM.

Operatoren minimieren

Viele ML-Runtimes binden Operator-Code abhängig vom Modell ein. Wählen Sie Modellarchitekturen, die mit wenigen Standard-Operatoren auskommen. Hintergrundwissen dazu bietet z. B. die Erklärung, wie „Ops aufgelöst“ werden, in TinyML-orientierten Lernnotizen: Building an Application (TinyML Notes).

Speicherlayout und Datenstrukturen straffen

Auf AVR lohnt es sich, konsequent speichersparend zu programmieren: kleine Datentypen, keine großen globalen Arrays ohne Not, sparsame String-Nutzung, und Puffer als Ringbuffer statt „alles sammeln“. Für Feature-Vektoren sind int16/int8 häufig ausreichend.

Timing-Design: Inferenzfenster und Abtastrate anpassen

Wenn Ihr System „in Echtzeit“ reagieren muss, definieren Sie ein klares Inferenzbudget (z. B. alle 100 ms). Dann wählen Sie Abtastrate und Fenstergröße so, dass Sie innerhalb dieses Budgets bleiben. Bei IMU-Anwendungen reichen oft 50–200 Hz statt 1 kHz – das senkt Puffergrößen und Rechenaufwand dramatisch.

Typische Fallstricke: Warum TinyML-Projekte auf dem Mega scheitern

- RAM unterschätzt: Arena + Sensorpuffer + Serial-Strings sprengen 8 KB schneller als gedacht.

- Zu großes Modell: Ein paar zusätzliche Neuronen können Arena und Flash „kippen“.

- Float-Verarbeitung im Preprocessing: MFCC/FFT mit float kann auf AVR langsam und speicherhungrig werden, wenn nicht optimiert.

- Debugging über Serial: Zu viel Logging kostet Zeit und RAM; außerdem kann es Timing-Probleme kaschieren.

- Falsche Erwartung: TinyML ist auf AVR eher „smarte Klassifikation“ als „KI wie am PC“.

Praxis-Setup: So planen Sie ein TinyML-Projekt für den Mega 2560

Ein robustes Vorgehen ist, zuerst die Hardware-Budgets festzulegen und dann die ML-Pipeline darauf zu designen:

- RAM-Budget definieren: z. B. maximal 3 KB Arena, 2 KB Sensorpuffer, Rest für Sketch/Stack.

- Fenster/Features festlegen: Welche Sensoren, welche Abtastrate, welche Feature-Anzahl?

- Modell minimal starten: Erst ein sehr kleines Modell stabil zum Laufen bringen, dann iterieren.

- Messung statt Gefühl: Inferenzzeit messen (Millis), RAM-Verbrauch beobachten, Flash-Größe prüfen.

- Fallback-Logik einbauen: Wenn Inferenz ausfällt oder unsicher ist, muss das System sicher reagieren.

Wann Sie besser auf ein anderes Board wechseln sollten

Der Mega 2560 ist ideal, wenn Sie viele I/Os, mehrere UARTs oder 5-V-Peripherie brauchen und TinyML nur „kleine Intelligenz“ hinzufügen soll. Wenn jedoch das ML-Modell im Zentrum steht oder Sie komplexere Signale (Audio, mehrere Sensorströme, hohe Feature-Dichte) verarbeiten möchten, sind Boards mit mehr RAM und 32-Bit-CPU deutlich effizienter. In diesem Fall lohnt sich oft ein Blick auf TinyML-freundliche Plattformen und die offizielle TensorFlow-Lite-Micro-Basis selbst: TensorFlow Lite Micro (GitHub). Für Arduino-orientierte TFLite-Micro-Ansätze ist außerdem das Arduino-Ökosystem rund um kompatible Architekturen relevant, wie oben verlinkt.

Checkliste: „Ist TinyML mit 16 MHz möglich?“ in Ihrer Anwendung beantworten

- Passt Ihr Modell (inkl. Runtime) in den Flash, ohne dass der Sketch unwartbar wird?

- Bleibt Ihre SRAM-Nutzung unter 8 KB inklusive Arena, Puffer, Stack/Heap?

- Ist die Inferenzzeit kleiner als Ihr Zeitbudget pro Zyklus (z. B. < 20 ms bei 50 ms Loop-Ziel)?

- Nutzen Sie int8-Quantisierung und vermeiden float-lastige Pfade?

- Haben Sie Features so gewählt, dass das Modell klein bleiben kann?

- Ist die Systemlogik auch ohne ML-Ausgabe sicher und stabil?

Weiterführende Ressourcen für Planung und Umsetzung

- Arduino Mega 2560 Rev3 – technische Daten und Spezifikationen

- TensorFlow Lite Micro – Referenzprojekt und Grundlagen

- EloquentTinyML – kompakter TinyML-Ansatz für Arduino

- Arduino-orientierte TFLite-Micro-Bibliothek (mbed/ESP32 Fokus)

- TinyML Notes: Operator-Resolver und Laufzeitkonzepte verständlich erklärt

- Edge Impulse Forum – Praxisberichte und Optimierungsideen für kleine MCUs

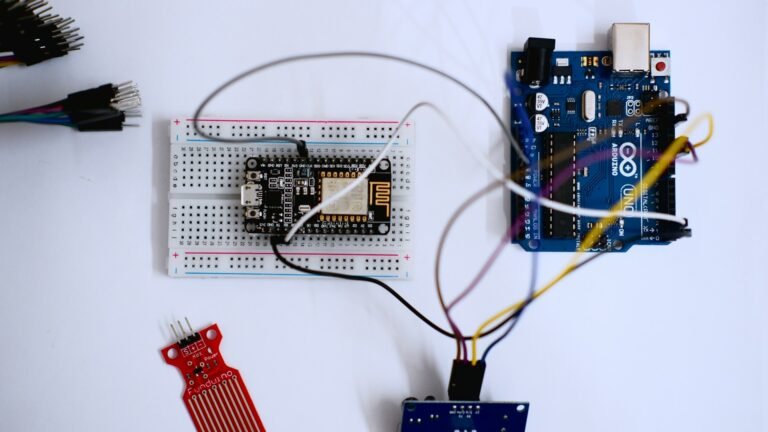

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.