KI-Gestensteuerung mit dem Arduino Leonardo eröffnet eine spannende Schnittstelle zwischen Mensch und Computer: Statt Maus oder Tastatur zu bedienen, lösen Handbewegungen, Neigungen oder bestimmte Posen gezielt Aktionen aus. Das Hauptkeyword KI-Gestensteuerung beschreibt dabei den Kern des Konzepts: Sensoren erfassen Bewegungen, ein KI-Modell erkennt daraus Gesten, und der Leonardo setzt diese Gesten als USB-Eingaben um. Gerade weil der Arduino Leonardo (ATmega32U4) eine native USB-Schnittstelle besitzt, eignet er sich hervorragend, um sich gegenüber dem PC als Tastatur, Maus oder Gamepad auszugeben – ohne zusätzliches USB-zu-Seriell-Modul. In der Praxis entsteht so ein flexibles System für Präsentationen, Streaming, Smart-Home-Shortcuts oder barriereärmere Bedienkonzepte. Wichtig ist jedoch, die Architektur realistisch zu planen: Je nach Sensorik und Modellgröße läuft die eigentliche KI entweder auf dem PC, auf einem zweiten leistungsfähigeren Mikrocontroller oder – in sehr kleinen TinyML-Szenarien – direkt auf dem Leonardo. Dieser Artikel führt Sie strukturiert durch die Optionen, zeigt typische Aufbauten und gibt praxisnahe Hinweise, damit Ihre Gestensteuerung zuverlässig, sicher und sauber umsetzbar bleibt.

Warum der Arduino Leonardo für Gestensteuerung interessant ist

Der Arduino Leonardo basiert auf dem ATmega32U4 und kann sich über USB direkt als Human Interface Device (HID) anmelden. Das ist der entscheidende Vorteil gegenüber vielen Boards, die für USB eine zusätzliche Schnittstellen-Bridge benötigen. Mit den Arduino-Bibliotheken für HID lassen sich Tastenanschläge, Mausbewegungen oder Medienbefehle erzeugen – ein zentraler Baustein, wenn Gesten am Ende konkrete PC-Aktionen auslösen sollen. Einen Einstieg in die offiziellen Referenzen bietet die Arduino-Dokumentation zur Keyboard-Library (und analog die Mouse-Funktionen).

Für Projekte mit „KI + Hardware“ ist außerdem hilfreich, dass der Leonardo viele digitale Pins, mehrere analoge Eingänge und eine stabile 5-V-Umgebung bietet. Allerdings sind RAM und Flash im Vergleich zu modernen KI-freundlichen Mikrocontrollern begrenzt. Daraus folgt: Der Leonardo ist in den meisten KI-Gesten-Projekten der perfekte Ausführungsarm (HID-Ausgabe), während die Intelligenz oft auf einem anderen System läuft.

Grundarchitekturen: Wo läuft die KI wirklich?

Bevor Sie Sensoren kaufen oder Code schreiben, sollten Sie festlegen, wo die Gestenerkennung stattfindet. In der Praxis haben sich drei Architekturvarianten etabliert:

- KI auf dem PC, Leonardo als HID-Ausgabe: Kamera/IMU-Daten werden am PC verarbeitet, Gesten werden erkannt und als Befehl an den Leonardo gesendet. Der Leonardo emuliert Tastatur/Maus/Gamepad.

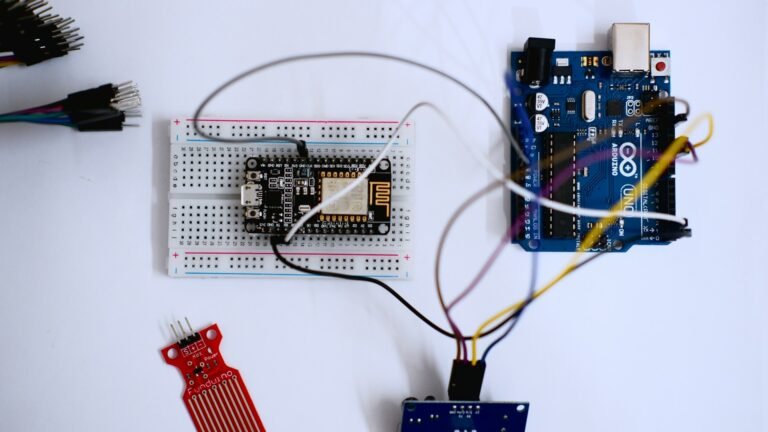

- KI auf einem zweiten Board, Leonardo als USB-HID: Ein leistungsfähigeres Board (z. B. ESP32-S3 oder ARM-basiert) erkennt Gesten lokal und sendet nur „Geste A/B/C“ an den Leonardo.

- TinyML direkt auf dem Leonardo: Nur für sehr kleine Modelle und einfache Sensorik (meist IMU/Analogwerte). Der Leonardo erkennt Gesten selbst und gibt HID direkt aus.

Die erste Variante ist für Einsteiger meist am einfachsten, weil PC-Frameworks für Computer Vision und Machine Learning sehr ausgereift sind. Die dritte Variante ist technisch reizvoll, erfordert aber striktes Ressourcenmanagement und ein bewusstes „kleines“ Problem (z. B. Wischgeste per Beschleunigungssensor statt komplexer Handpose aus Kamerabildern).

Sensorik für Gesten: Kamera, IMU oder „klassische“ Eingaben?

Die Qualität Ihrer Gestensteuerung steht und fällt mit der Sensorik. Typische Optionen sind:

- Kamera (Computer Vision): Erkennung von Handposen, Fingerstellungen, Armbewegungen oder Körperhaltung. Sehr intuitiv, aber licht- und umgebungsabhängig.

- IMU (Beschleunigung/Gyro): Gesten über Bewegung eines Controllers, Handschuhs oder Wearables. Robust, günstig, wenig Rechenlast.

- Entfernung/Proximity (IR/ToF/Ultraschall): Einfache „Winken“- oder „Annähern“-Gesten, eher grob, aber zuverlässig.

- Druck/Touch/Knöpfe als Hybrid: Eine Geste wird erst „scharf“, wenn ein Taster gedrückt wird. Das reduziert Fehltrigger erheblich.

Variante A: Handgesten per Kamera – KI auf dem PC, Leonardo macht HID

Wenn Sie echte Handgesten (z. B. „Daumen hoch“, „Pinch“, „Swipe“) erkennen wollen, ist ein PC-gestütztes Setup meist die beste Wahl. Der PC nutzt eine Webcam, verarbeitet die Frames und leitet erkannte Gesten als Befehle weiter. Für Handtracking und Gestenerkennung sind Frameworks wie MediaPipe sehr beliebt, weil sie Hand-Landmarks, Tracking und (je nach Modul) auch Gestenklassifikation liefern. Für eigene Computer-Vision-Pipelines ist zudem OpenCV eine etablierte Basis.

Kommunikation PC → Leonardo

Damit der Leonardo die erkannten Gesten in Tastendrücke oder Mausaktionen übersetzen kann, braucht der PC einen Kommunikationskanal zum Board. Üblich sind:

- Seriell über USB (virtueller COM-Port): Der PC sendet kurze Tokens wie G1, G2 oder JSON-Strings. Der Leonardo parst das und ruft Keyboard-/Mouse-Funktionen auf.

- HID direkt vom PC (ohne Leonardo): Möglich, aber der Leonardo ist dann überflüssig. Relevant, wenn Sie bewusst eine externe „Hardware-Taste“ möchten.

Praktisch ist die serielle Methode, weil sie robust und leicht zu debuggen ist. Wichtig ist ein sauberer Protokollrahmen: eindeutige Trennzeichen, Zeitouts und eine kleine Zustandsmaschine auf dem Leonardo, damit bei Paketverlust nicht „hängenbleibende“ Tasten entstehen.

Stabilität: Gesten entprellen und „Cool-down“ nutzen

KI-Ausgaben sind selten perfekt stabil. Um Fehlaktionen zu vermeiden, sollten Sie Gesten wie einen Hardware-Taster behandeln: mit Debouncing, Mindesthaltezeit und Cool-down. Ein typisches Muster ist:

- Geste muss n Frames hintereinander erkannt werden (z. B. 5–10 Frames).

- Aktion wird nur ausgelöst, wenn die Geste von „nicht aktiv“ zu „aktiv“ wechselt.

- Danach folgt eine kurze Sperrzeit (z. B. 300–800 ms), bevor erneut ausgelöst werden darf.

Dadurch wirkt das System „menschlich“ und kontrollierbar, statt nervös und zufällig.

Variante B: TinyML mit IMU – kleine Modelle, große Wirkung

Für viele Gestensteuerungen genügt es, Bewegungsmuster zu erkennen: ein kurzes „Schütteln“, ein „Drehen“, ein „Doppeltippen“, eine „Wisch“-Bewegung in der Luft. Solche Muster lassen sich mit einer IMU (Beschleunigung + Gyro) gut erfassen. Der große Vorteil: Die Datenrate ist überschaubar, und Modelle können klein bleiben.

Für den Workflow (Daten sammeln → Modell trainieren → auf Embedded deployen) wird häufig Edge Impulse als C++-Deployment genutzt, weil es den End-to-End-Prozess strukturiert und viele Sensor-Setups unterstützt. Auch wenn der Leonardo nicht immer das ideale Zielfeld ist, können Sie mit dem Ansatz arbeiten: Entweder läuft das Modell auf einem stärkerem Board, oder Sie reduzieren Features/Modellgröße so stark, dass es auf dem ATmega32U4 gerade noch praktikabel wird.

Warum IMU-Gesten oft besser funktionieren als man denkt

IMU-Gesten sind weniger „magisch“ als Handposen vor einer Kamera, aber im Alltag oft zuverlässiger. Lichtverhältnisse spielen keine Rolle, die Auswertung ist deterministischer, und die „Geste“ kann bewusst als Bewegung eines physischen Controllers ausgeführt werden. Typische Anwendungen:

- Präsentationssteuerung (nächste Folie / vorherige Folie) über definierte Handbewegungen

- Mediensteuerung (Play/Pause, Lautstärke) über Dreh- oder Kippgesten

- Shortcuts im Streaming (Szenenwechsel) über schnelle, klar unterscheidbare Muster

Variante C: KI direkt auf dem Leonardo – realistische Einsatzgrenzen

Der ATmega32U4 ist kein KI-Monster, aber „KI“ muss nicht immer ein großes neuronales Netz bedeuten. Unter TinyML versteht man Modelle, die auf Mikrocontrollern laufen – oft stark quantisiert und mit sehr wenigen Parametern. Dennoch gilt: Kamerabasierte Modelle sind auf dem Leonardo praktisch nicht sinnvoll, IMU-Modelle nur in stark vereinfachter Form.

Wenn Sie dennoch „on-device“ arbeiten möchten, planen Sie konservativ:

- Feature-Engineering statt riesiger Netze: Mittelwerte, Varianzen, Spitzenwerte, Zero-Crossings – oft reicht das für einfache Gesten.

- Kleine Klassifikatoren: Lineare Modelle oder sehr kleine Entscheidungsbäume können eine Alternative sein.

- Kurze Fenster: Weniger Samples pro Entscheidung reduziert RAM-Bedarf.

Die wichtigste Erkenntnis: Für die meisten Projekte ist es effizienter, KI „woanders“ laufen zu lassen und den Leonardo für das zu nutzen, was er hervorragend kann – zuverlässige USB-HID-Ausgaben.

Der Leonardo als HID-Brücke: Tastatur, Maus und Controller sauber abbilden

Wenn Gesten erkannt sind, müssen sie in eine Eingabeform übersetzt werden, die das Zielprogramm versteht. Hier lohnt es sich, vorab zu entscheiden, welche Art von HID am passendsten ist:

- Tastatur-Shortcuts: Universell, für Tools wie OBS, Office, Browser und viele Anwendungen geeignet. Modifier (Strg, Alt, Shift) sollten kontrolliert und kurz gesetzt werden.

- Mausbewegung und Klicks: Ideal für Cursorsteuerung, Menüs, Point-and-Click-Workflows. Erfordert gutes Rate-Limiting, damit Bewegungen nicht „springen“.

- Gamepad/Joystick: Für Spiele und Simulatoren sinnvoll, aber oft komplexer in der Umsetzung und im Mapping.

Saubere HID-Implementierung heißt: Kein „dauerhaft gedrückter“ Modifier, keine endlosen Wiederholungen, klare Zustandsübergänge. Bei Gestensteuerung ist es oft besser, einzelne, kurze Impulse zu senden (z. B. „Strg+Shift+M“ einmal), statt eine Taste über Sekunden zu halten.

Praxis-Design: So wird Gestensteuerung alltagstauglich

Damit Ihr System nicht nur im Demo-Video gut aussieht, sondern wirklich im Alltag funktioniert, sollten Sie diese Designprinzipien berücksichtigen:

- Aktivierungsschalter („Push-to-Gesture“): Gesten werden nur erkannt, wenn ein Button gedrückt ist. Das verhindert zufällige Trigger im Hintergrund.

- Kontext-Modi: Ein Modus für Präsentation, ein Modus für Streaming, ein Modus für Medien – umgestellbar per Taste oder Drehencoder.

- Feedback: Eine LED, ein kleiner Summer oder ein OLED-Icon zeigt an, ob eine Geste erkannt und ausgeführt wurde.

- Fehlertoleranz: Wenn der PC keine Daten sendet, darf der Leonardo nicht „spinnen“. Timeouts und sichere Default-Zustände sind Pflicht.

Kalibrierung und Training: Datenqualität schlägt Modellgröße

Ob Sie ein Framework wie MediaPipe nutzen oder selbst ein Modell trainieren: Die Datenqualität ist entscheidend. Bei IMU-Gesten bedeutet das: gleichbleibende Abtastrate, eindeutige Labels, genügend Variationen (schnell/langsam, links/rechts, unterschiedliche Hände). Bei Kamera-Gesten bedeutet das: unterschiedliche Lichtbedingungen, Hintergründe, Abstände zur Kamera und realistische Bewegungen.

Ein häufig unterschätzter Punkt ist die Trennung von „Geste“ und „Nicht-Geste“. Wenn Ihr Modell nur Gesten kennt, aber nicht den Normalzustand, steigt die Fehlalarmrate. Planen Sie daher immer eine Neutral-Klasse oder robuste Schwellenlogik ein.

Sicherheit und Verantwortung: Gestensteuerung ohne Missbrauchspotenzial planen

Weil der Leonardo als HID-Gerät prinzipiell Tastatureingaben auslösen kann, sollten Sie Projekte so konzipieren, dass sie ausschließlich legitime, vom Nutzer gewünschte Aktionen ausführen. Setzen Sie auf transparente Funktionen (z. B. Mediensteuerung, Präsentationsnavigation, programmbezogene Shortcuts) und vermeiden Sie Konzepte, die Zugangsdaten automatisiert eingeben oder heimlich Eingaben erzeugen. Seriöse Projekte haben immer eine klare Kontrolle: Aktivierungstaste, sichtbares Feedback und eine definierte, dokumentierte Tastenbelegung.

Nützliche Tools und Ressourcen für den Start

- MediaPipe für Handtracking und gestenbasierte Computer-Vision-Workflows

- OpenCV für Bildverarbeitung, Kamera-Pipelines und eigene Feature-Extraktion

- Edge Impulse C++-Deployment als strukturierter TinyML-Workflow

- Arduino Keyboard-Library als Grundlage für HID-Tastatureingaben

Checkliste: Von der Idee zum funktionierenden Prototyp

- Use-Case definieren: Welche 3–5 Aktionen sollen Gesten auslösen? Welche Software (OBS, PowerPoint, Browser, Spiele)?

- Sensorik wählen: Kamera für Handposen, IMU für Bewegungsmuster, Hybrid mit Aktivierungstaste für maximale Kontrolle.

- Architektur festlegen: KI auf dem PC, auf einem zweiten Board oder (nur sehr klein) direkt auf dem Leonardo.

- Protokoll planen: Kurze, robuste Nachrichten PC→Leonardo, klare Zustandslogik, Timeouts.

- HID-Mapping erstellen: Shortcuts dokumentieren, Modifier sauber setzen/lösen, Wiederholungen begrenzen.

- Fehltrigger reduzieren: Debounce, Mindesthaltezeit, Cool-down, Neutralzustand.

- Feedback integrieren: LED/OLED/Buzzer, damit erkennbar ist, wann eine Geste angenommen wurde.

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.