Eine Multi-Region-Architektur wird häufig als „Königsweg“ für Ausfallsicherheit und globale Performance verstanden. In der Praxis bringt sie jedoch nicht nur Vorteile, sondern auch neue Latenz- und Availability-Risiken, die in Single-Region-Designs kaum sichtbar sind. Sobald Anwendungen über mehrere Regionen verteilt werden, ändern sich die physikalischen Grenzen: Netzwerklatenz folgt der Geografie, Replikation kostet Zeit, Konsistenz wird teurer, und Fehlerbilder werden komplexer. Hinzu kommen operative Faktoren: DNS- und Traffic-Steuerung, Rollouts, Observability, Incident Response und Abhängigkeiten zu Cloud-Services, die selbst regional oder zonal unterschiedlich ausfallen können. Wer Multi-Region „einfach zusätzlich“ baut, riskiert eine Architektur, die im Normalbetrieb langsamer ist und im Störfall unvorhersehbar reagiert. Entscheidend ist deshalb, Multi-Region nicht als Feature zu betrachten, sondern als eigenständiges System mit klaren Zielen: Welche Nutzer profitieren? Welche Ausfälle sollen überstanden werden? Welche Daten dürfen wie repliziert werden? Und wie verhindern wir, dass ein regionaler Fehler zum globalen Problem eskaliert? Dieser Artikel zeigt die wichtigsten Risikoquellen für Latenz und Verfügbarkeit und gibt eine belastbare Struktur, um Multi-Region-Designs so zu planen, dass sie messbar, operativ beherrschbar und realistisch abgesichert sind.

Warum Multi-Region die Latenz fast immer erhöht

Multi-Region bedeutet, dass mindestens ein Teil der Systempfade über weite Distanzen läuft. Selbst bei perfekter Netzwerkanbindung ist die Laufzeit von Signalen physikalisch begrenzt. In verteilten Systemen sind nicht die Durchschnittswerte entscheidend, sondern die Tail Latency: p95/p99 steigt oft deutlich, sobald Requests inter-regionale Hops enthalten oder Replikationsbestätigungen abgewartet werden müssen.

- Physikalische Distanz: Je weiter Regionen auseinanderliegen, desto größer die RTT (Round Trip Time).

- Zusätzliche Hops: Global Load Balancing, Edge, WAF, Proxies und zentrale Security erhöhen den Pfad.

- Synchronisationskosten: Jede Form von Konsistenz über Regionen hat einen Preis in Latenz und Fehleranfälligkeit.

- Tail-Effekte: Kleine Degradationen (Jitter, Queueing) schlagen auf p95/p99 stärker durch als auf den Mittelwert.

Als Grundlage für die Denkweise „Latenz ist ein Budget“ lohnt sich die Perspektive aus SRE: Site Reliability Engineering (Google SRE Book).

Die drei klassischen Multi-Region-Muster und ihre Risikoprofile

Multi-Region ist nicht gleich Multi-Region. Die Risiken hängen stark davon ab, ob Sie aktiv/aktiv, aktiv/passiv oder eine Mischform betreiben.

- Active/Active: Mehrere Regionen bedienen gleichzeitig Nutzertraffic. Vorteile: schnellere lokale Antworten, bessere Lastverteilung. Risiken: Datenkonsistenz, Konflikte, komplexes Routing, höhere Anforderungen an Observability.

- Active/Passive: Eine Region ist primär, die andere ist Standby. Vorteile: einfachere Datenhoheit. Risiken: Failover-Zeit, Cold Start, „Drift“ zwischen Regionen, selten getesteter Ernstfall.

- Active/Active Read, Single-Writer: Lesen lokal, Schreiben zentral. Vorteile: bessere Lese-Latenz, klarere Konsistenz. Risiken: Write-Hotspot, regionale Abhängigkeit für Write-Pfade, inkonsistente Caches.

Warum „Active/Passive“ im Störfall oft langsamer ist als erwartet

Bei Active/Passive-Designs werden Standby-Komponenten häufig weniger genutzt, seltener skaliert, und reale Lastprofile werden nicht vollständig simuliert. Im Failover treten dann Verzögerungen durch DNS-TTLs, Warmup, Autoscaling und Cache-Repopulation auf. Ohne regelmäßige Failover-Übungen bleibt die tatsächliche Recovery-Zeit eine Vermutung.

Availability: Multi-Region kann sie erhöhen – oder global verschlechtern

Die zentrale Idee hinter Multi-Region ist Redundanz. Trotzdem kann die globale Verfügbarkeit sinken, wenn gemeinsame Abhängigkeiten (Shared Dependencies) beide Regionen gleichzeitig betreffen oder wenn das Failover selbst fehlerhaft ist. Typische gemeinsame Abhängigkeiten sind Identitätsdienste, zentrale Control Planes, globale DNS- oder Traffic-Manager, zentrale CI/CD-Pipelines, Observability-Backends oder überregionale Netzwerk-Hubs.

- Gemeinsame Control Plane: Wenn Automatisierung und Deployments von einem zentralen System abhängen, kann eine Störung die Wiederherstellung behindern.

- Globaler Traffic Manager: Ein Fehler in Routing-Policies kann beide Regionen „gleichzeitig“ unbenutzbar machen.

- Geteilte Datenebene: Wenn beide Regionen dieselbe Datenbank oder denselben Storage-Account benötigen, ist „Multi-Region“ nur scheinbar redundant.

- Shared Security: Zentrale Firewalls/Proxies können zum Single Point of Failure werden.

Verfügbarkeitsrechnung als grobe Orientierung

Wenn zwei Regionen wirklich unabhängig sind und jeweils eine Verfügbarkeit

Die Annahme „unabhängig“ ist jedoch selten vollständig erfüllt. Gemeinsame Abhängigkeiten erhöhen die Korrelation von Ausfällen – und damit sinkt der reale Gewinn. Genau deshalb ist Dependency-Mapping und die Reduktion gemeinsamer Engpässe so wichtig.

Routing- und DNS-Risiken: Wenn Traffic nicht dort landet, wo Sie es erwarten

Multi-Region setzt meist auf DNS oder Anycast-basiertes Global Load Balancing. Beide Mechanismen haben Eigenheiten, die direkt in Availability- und Latenzrisiken übersetzen. DNS ist cachebasiert: TTLs verhindern schnelle Umschaltungen, während zu niedrige TTLs die Resolver-Last erhöhen und DNS selbst zur kritischen Abhängigkeit machen. Anycast kann Traffic „intuitiv“ verteilen, aber bei Internet-Routing-Änderungen kann sich das Verhalten abrupt ändern.

- DNS-TTL: Failover ist oft „mindestens TTL“, zusätzlich beeinflusst durch Resolver-Caches.

- Split-Horizon: Interne und externe Nutzer können unterschiedliche Antworten erhalten, was Debugging erschwert.

- Health-Checks: Falsch konfigurierte Checks führen zu Flapping oder zu spät erkannten Ausfällen.

- Geo-Steuerung: Nutzer werden nicht immer zur „nächsten“ Region geroutet; Internetpfade entscheiden mit.

Für DNS-Grundlagen und Cache-Verhalten ist Cloudflare Learning: DNS eine gut lesbare Referenz.

Datenkonsistenz: Der versteckte Preis für globale Verfügbarkeit

Viele Multi-Region-Probleme entstehen nicht im Netzwerk, sondern in der Datenebene. Entscheidend ist, ob Ihre Anwendung starke Konsistenz (z. B. linearizable writes) benötigt oder ob sie mit Eventual Consistency umgehen kann. Je strenger die Konsistenz, desto höher die Latenz – und desto größer das Risiko, dass eine Region bei Degradation nicht mehr sauber arbeitet.

- Synchrones Replizieren: Schreibvorgänge warten auf Bestätigungen aus mehreren Regionen. Sehr robust, aber latent und empfindlich gegenüber Netzwerkdegradation.

- Asynchrones Replizieren: Schneller im Normalbetrieb, aber Risiko von Datenverlust/Replay bei Region-Ausfällen.

- Konfliktauflösung: Active/Active Writes erfordern Konfliktstrategien (Last-Writer-Wins, CRDTs, Domänenregeln).

- Read-Your-Writes: Nutzererwartung, die in Multi-Region ohne Session- oder Stickiness-Mechanismen brechen kann.

Wenn Sie Konsistenzkonzepte vertiefen möchten, ist die theoretische Basis des CAP-Trade-offs hilfreich: Brewer: CAP Theorem (Paper).

Tail Latency eskaliert durch Cross-Region-Abhängigkeiten

Ein häufiges Anti-Pattern ist ein scheinbar regionaler Service, der bei kritischen Operationen dennoch eine andere Region benötigt. Beispiele: Authentifizierung in Region A, aber Token-Introspection in Region B; Logging/Tracing, das synchron in eine zentrale Region schreibt; Feature-Flag-Reads aus einer zentralen Datenbank. Der Effekt: p95/p99 steigt, und im Degradationsfall kann ein lokaler Incident zum globalen Problem werden.

- Chatty-Protokolle: Viele kleine Roundtrips werden über Region-Grenzen besonders teuer.

- Synchrones Observability: Blockierende Telemetrie erzeugt Latenz und kann Kaskaden auslösen.

- Zentrale Policy-Services: AuthZ/AuthN als Single-Writer oder Single-Region wird zum globalen Bottleneck.

- Cross-Region Service Discovery: DNS/Registry-Lookups in einer anderen Region erhöhen die Tail.

Availability-Risiken durch „Failover, das funktioniert – aber zu spät“

Selbst wenn Failover technisch möglich ist, kann es operativ zu langsam sein. Nutzer erleben dann lange Ausfälle oder massive Degradation, obwohl eine zweite Region existiert. Typische Ursachen:

- Detection-Latenz: Health-Checks erkennen Ausfälle spät oder sind zu konservativ, um False Positives zu vermeiden.

- Decision-Latenz: Traffic-Manager benötigen Zeit, um Routing zu ändern, oder es gibt manuelle Freigaben.

- Propagation-Latenz: DNS-Caches, Anycast-Konvergenz, Client-Caches und Connection Reuse verzögern die Umstellung.

- Recovery-Latenz: Standby muss skalieren, Caches füllen, Daten nachziehen, Zertifikate/Secrets laden.

RTO/RPO realistisch modellieren

In Multi-Region-Designs sollten Sie Recovery Time Objective (RTO) und Recovery Point Objective (RPO) nicht nur definieren, sondern auch messen. Als Denkhilfe kann man RTO grob in Komponenten zerlegen:

Die zentrale Frage ist weniger „können wir failovern?“, sondern „wie schnell, unter realistischen Bedingungen, und ohne manuelle Überraschungen?“

Regionale Limits und Service-Charakteristika: Nicht jeder Cloud-Service ist gleich multi-region-fähig

Viele Cloud-Services sind regional, einige zonal, manche global. Eine Multi-Region-Architektur ist nur so stabil wie ihre schwächste Abhängigkeit. Typische Stolperfallen sind Service-Limits (Quotas), unterschiedliche Feature-Verfügbarkeit je Region, und Abhängigkeiten von regionalen Control Planes. Es ist deshalb wichtig, vor dem Design zu prüfen, wie die relevanten Services funktionieren.

- Quotas pro Region: Ressourcenlimits können in der Failover-Region einen Scale-up verhindern.

- Feature-Parität: Nicht jede Region unterstützt jeden Dienst oder jede Option (z. B. bestimmte Instanztypen).

- Control-Plane-Engpässe: Autoscaling, Deployment, DNS-Updates oder Zertifikatsrotation können bei regionaler Degradation stocken.

Als Einstieg in provider-spezifische Architekturhinweise eignen sich offizielle Well-Architected-Ansätze: AWS Well-Architected: Reliability und Microsoft Azure Architecture Framework: Resiliency.

Operative Risiken: Observability, Rollouts und Incident Response über Regionen

Multi-Region erhöht nicht nur technische Komplexität, sondern auch die Anforderungen an Betrieb und Prozesse. Ein häufiges Risiko ist eine Observability-Architektur, die selbst nicht multi-region resilient ist: Wenn Logs/Traces zentral gesammelt werden und diese zentrale Plattform ausfällt, verlieren Teams im Incident die Sichtbarkeit. Ebenso kritisch sind Rollouts: Wenn ein Deployment gleichzeitig in mehreren Regionen ausgerollt wird, kann ein Fehler global wirken.

- Observability-Backbone: Telemetrie sollte nicht synchron blockieren und idealerweise pro Region degradierbar sein.

- Deployment-Strategien: Region-by-Region Rollout, Canary, klare Stop-Kriterien und automatische Rollbacks.

- Runbooks pro Region: Gleiche Störung kann je Region andere Symptome haben (Limits, Traffic, Abhängigkeiten).

- GameDays: Geplante Failure-Übungen sind der schnellste Weg, versteckte Korrelationen aufzudecken.

Sicherheits- und Netzwerk-Risiken: Zentralisierung kann den Blast Radius erhöhen

Viele Organisationen zentralisieren Security (Inspection, Proxies, egress control) in einer Region oder in einem globalen Hub. Das kann Governance vereinfachen, erhöht aber den Blast Radius, wenn zentrale Komponenten dekompensieren oder wenn asymmetrische Pfade entstehen. Besonders in Multi-Region-Setups ist es wichtig, Security so zu gestalten, dass regionale Ausfälle nicht die globale Erreichbarkeit zerstören.

- Zentrale Firewalls als Single Point: Wenn alle Regionen über denselben Inspection-Pfad müssen, führt eine Degradation zu globaler Latenz.

- Asymmetrisches Routing: Rückwege über andere Regionen oder Hubs führen zu stillen Drops an stateful Komponenten.

- Regionale Egress-IPs: Partner-APIs können IP-Whitelists nutzen; Failover ändert Egress-IPs und bricht Zugriff.

- Secrets/Identity: Zentraler Identity-Dienst ohne regionale Kopie wird zum globalen Bottleneck.

Bewährte Designmuster zur Reduktion von Latenz- und Availability-Risiken

Ein robustes Multi-Region-Design setzt auf klare Domänen, gezielte Redundanz und bewusste Trade-offs. Die folgenden Muster sind in vielen Plattformteams praxistauglich, weil sie Risiken nicht „wegdiskutieren“, sondern messbar begrenzen.

- Regionale Autonomie: Jede Region kann Kernfunktionen ohne Cross-Region-Abhängigkeit ausführen (mindestens für Degradationsbetrieb).

- Single-Writer mit lokalem Read: Wenn Konflikte schwer sind, writes zentral halten und reads regional optimieren.

- Asynchroner Event-Backbone: Replikation über Events/Queues statt synchroner Cross-Region-Calls.

- Failover-Playbook und Tests: Regelmäßige Übungen inkl. DNS/Traffic-Manager, Datenrecovery, Quota-Checks.

- Observability pro Region: Lokale Dashboards/Logs, die auch bei zentraler Störung minimal funktionieren.

- Traffic-Steuerung mit klaren Regeln: Kein „magisches“ Geo-Routing ohne messbare SLOs und nachvollziehbare Policies.

Messstrategie: Welche SLIs in Multi-Region wirklich aussagekräftig sind

Damit Multi-Region nicht zur Glaubensfrage wird, brauchen Sie Metriken, die Latenz- und Availability-Risiken direkt abbilden. Wichtig ist eine strikte Segmentierung: pro Region, pro Pfad (intra-region vs. inter-region), und pro Nutzergruppe.

- End-to-End Latenz (p95/p99): getrennt nach „regionaler Request“ vs. „cross-region Request“.

- Failover-Zeit (gemessen): Zeit von „Störung beginnt“ bis „Nutzer erhalten wieder erfolgreiche Antworten“.

- Error Budget pro Region: Welche Region verbraucht wie viel Budget, und wie wirkt sich das global aus?

- Dependency-Latenz: Auth, DB, Queue, DNS, Token-Services – jeweils regionaler vs. überregionaler Anteil.

- Consistency-Indikatoren: Replikationslag, Konfliktrate, Read-Your-Writes-Verletzungen (wo relevant).

Outbound-Links für vertiefende Referenzen

- Google SRE Book: Grundlagen zu Verfügbarkeit, SLOs und Fehlerbudgets

- AWS Well-Architected: Reliability Pillar

- Azure Architecture Framework: Resiliency

- RFC 4271: BGP-4 – dynamisches Routing und Pfadwahl

- RFC 793: TCP – Verbindungsmodell und Auswirkungen auf Tail Latency

- Cloudflare: DNS, Resolver und Cache-Verhalten

- Brewer: CAP Theorem (Paper)

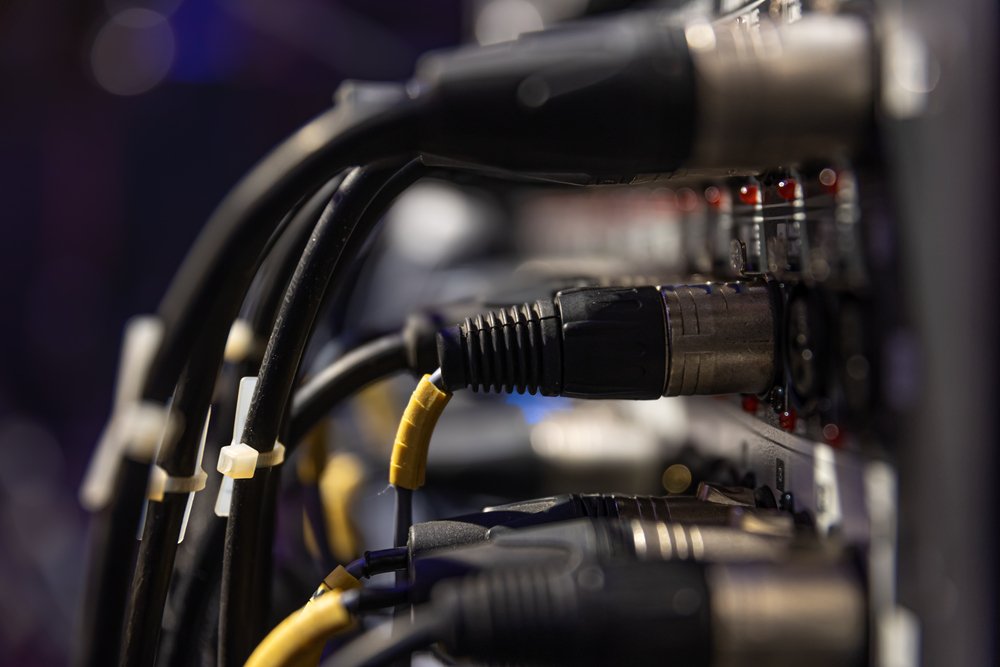

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.