SLA/SLO Vertragsdesign: Metriken, Messpunkte und Reporting ist ein kritischer Erfolgsfaktor, wenn Netzwerkservices, Cloud-Connectivity, Managed Services oder Security-Services verlässlich geliefert und fair bewertet werden sollen. In vielen Organisationen sind SLAs (Service Level Agreements) historisch gewachsen: Sie enthalten Uptime-Prozente, kurze Definitionen und ein Reporting, das zwar regelmäßig verschickt wird, aber wenig über die tatsächliche Nutzererfahrung oder über die Ursachen von Störungen aussagt. Gleichzeitig steigt die Komplexität: Services verlaufen über mehrere Domänen (On-Prem, Provider, Cloud), und die Frage „Wer ist verantwortlich?“ lässt sich ohne saubere Messpunkte und eindeutige Metriken kaum beantworten. Ein modernes SLA/SLO Vertragsdesign verbindet daher drei Ebenen: erstens präzise Metriken (SLIs) mit klaren Zielwerten (SLOs), zweitens eindeutig definierte Messpunkte (wo und wie wird gemessen), und drittens ein Reporting, das sowohl Steuerung (Verbesserung) als auch Nachweis (Audit/Vertrag) ermöglicht. Dieser Beitrag zeigt, wie Sie SLAs und SLOs so formulieren, dass sie technisch belastbar, juristisch interpretierbar und operativ nutzbar sind – ohne dass das Vertragswerk in Formalismus erstarrt oder Anreize für KPI-Gaming schafft.

SLA, SLO, SLI: Begriffe und Verantwortungslogik sauber trennen

Ein solides Vertragsdesign beginnt mit klaren Definitionen. Häufige Missverständnisse entstehen, wenn SLA, SLO und SLI vermischt werden. Dadurch werden Erwartungen unklar und Streitfälle wahrscheinlicher.

- SLI (Service Level Indicator): Messgröße, die eine Serviceeigenschaft quantifiziert, z. B. „DNS-Query-Erfolgsrate“, „p95 Latenz“ oder „Packet Loss“.

- SLO (Service Level Objective): Zielwert für einen SLI in einem definierten Zeitraum, z. B. „p95 RTT < 40 ms im Monatsfenster“ oder „VPN-Login-Erfolgsrate ≥ 99,5 %“.

- SLA (Service Level Agreement): Vertragliche Vereinbarung, die SLOs, Messmethoden, Reporting, Geltungsbereiche, Ausnahmen, Eskalationen und ggf. Service Credits regelt.

Praktisch bedeutet das: SLOs sind das technische Herz, SLAs sind die vertragliche Hülle. Ein SLA ohne klare SLIs und Messpunkte ist in Streitfällen schwer durchsetzbar. Ein SLO ohne Reporting und Governance bleibt ein internes Ziel ohne Vertragswirkung.

Warum SLA/SLO-Design in der Praxis oft scheitert

Viele SLAs scheitern nicht an der Absicht, sondern an typischen Designfehlern. Diese Fehler führen dazu, dass Verträge zwar existieren, aber operativ nicht helfen oder juristisch nicht sauber auslegbar sind.

- Komponentenmetriken statt Service-Metriken: „Link up“ ist nicht gleich „Service nutzbar“.

- Unklare Messpunkte: Provider misst an der Übergabe, Kunde misst am Client – beide haben „recht“.

- Fehlende Degradation-Definition: Nur „Down“ wird gezählt, nicht „schlecht“ (hoher Loss, hohe Latenz).

- Ausnahmen ohne Struktur: Wartungsfenster, Force Majeure oder Kundenfehler werden zu pauschalen Escape-Klauseln.

- Reporting ohne Handlungswert: Monatsreport enthält Zahlen, aber keine Ursachen, keine Trends, keine Maßnahmen.

- Falsche Anreize: SLA belohnt „nicht melden“ oder fördert Workarounds, die Metriken verschönern statt Service zu verbessern.

Ein gutes Vertragsdesign vermeidet diese Fallen, indem es Messbarkeit, Interpretierbarkeit und Anreize gemeinsam betrachtet.

Servicebeschreibung: Ohne klare Servicegrenze keine fairen Metriken

Der wichtigste Schritt vor jeder Metrik ist die Servicegrenze. Sie entscheidet, wofür der Provider verantwortlich ist und wofür nicht. Gerade bei Netzwerken und Hybrid-Services muss die Grenze sehr konkret sein.

- Was ist der Service? z. B. „Standort-Konnektivität“, „Internet Egress“, „Remote Access VPN“, „Cloud Interconnect“.

- Welche Komponenten gehören dazu? CPE, Underlay, Overlay, Firewall/Proxy, DNS, AAA (je nach Service).

- Welche Übergabepunkte gelten? Demarcation Point, Cloud Gateway, Tunnel-Endpunkt, Ingress/Proxy.

- Welche Abhängigkeiten sind extern? z. B. Identity Provider, Kunden-LAN, Endgeräte, SaaS-Anbieter.

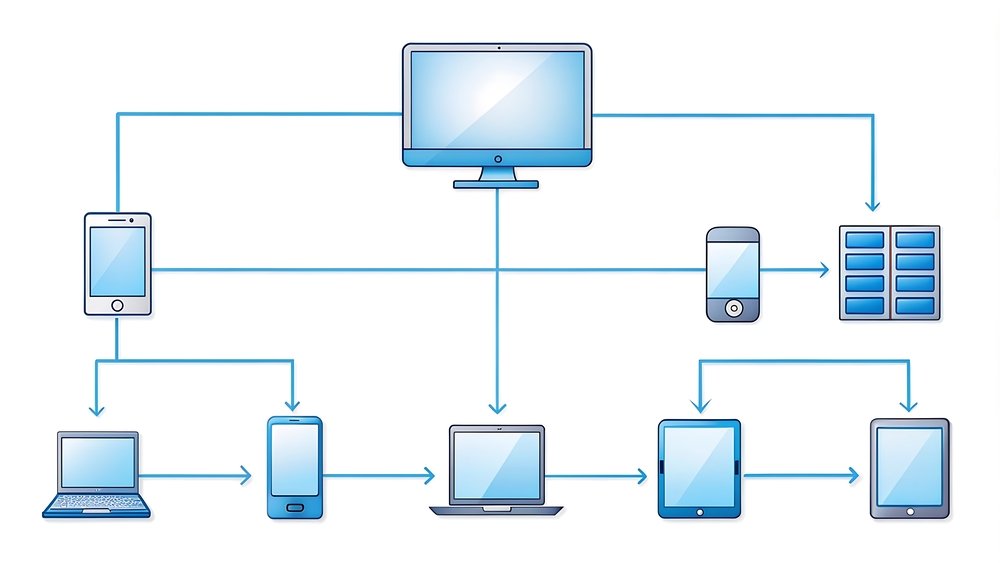

Ein hilfreiches Muster ist eine kurze, präzise „Service Definition“, ergänzt durch ein Diagramm mit Messpunkten. Dadurch werden später Metriken leichter zuordnungsfähig.

Metriken auswählen: Was vertraglich sinnvoll und wirklich messbar ist

Für SLAs gilt: Weniger ist oft mehr. Ein kleiner Satz hochwertiger Metriken ist besser als ein großes KPI-Set, das niemand interpretiert. Bewährt haben sich drei Metrikklassen:

- Verfügbarkeit: „Kann der Service genutzt werden?“

- Qualität/Performance: „Wie gut ist der Service?“

- Reaktions- und Wiederherstellungsfähigkeit: „Wie schnell wird reagiert und wiederhergestellt?“

Verfügbarkeit messbar definieren

Verfügbarkeit ist nur belastbar, wenn „Down“ eindeutig definiert ist. Typische Definitionen:

- Hard Down: Service-Probe schlägt fehl (z. B. keine DNS-Antwort, VPN-Login nicht möglich, Tunnel down).

- Soft Down / Degradation: Service ist erreichbar, aber unter definierter Qualitätsgrenze (z. B. Loss > X %, p95 Latenz > Y ms).

Ein moderner Ansatz berücksichtigt Degradation explizit, weil Nutzerimpact häufig durch „brownouts“ entsteht.

Performance-Metriken pragmatisch formulieren

Performance sollte nicht über Durchschnittswerte gemessen werden, sondern über Perzentile und klare Messfenster. Beispiele:

- Latenz: p95/p99 RTT zwischen definierten Messpunkten (z. B. Site→Hub, Client→Edge).

- Packet Loss: p95 Loss oder Loss-Minuten pro Zeitfenster; optional Burst-Indikatoren.

- Jitter: relevant für Voice/Video; ebenfalls als Perzentil und Zeitfenster.

Für SLO-orientiertes Denken und Fehlerbudgets ist die SRE-Literatur ein guter Referenzrahmen: Google SRE Bücher.

Reaktions- und Wiederherstellungsmetriken

Gerade bei Managed Services sind nicht nur technische Werte wichtig, sondern Prozessmetriken:

- Time to Acknowledge: Zeit bis zur Annahme eines Tickets/Incidents.

- Time to Mitigate: Zeit bis zu einer wirksamen Stabilisierung (Workaround).

- MTTR: Mean Time to Restore für definierte Incident-Klassen.

Solche Metriken sind nur fair, wenn Eskalation, Ticketkanäle und Verantwortlichkeiten klar geregelt sind.

Messpunkte: Der entscheidende Unterschied zwischen „fair“ und „streitbar“

In Verträgen ist nicht nur wichtig, was gemessen wird, sondern wo gemessen wird. Messpunkte bestimmen, ob ein Provider für End-to-End-Probleme haftet oder nur bis zur Übergabe. Ein gutes SLA/SLO-Design definiert Messpunkte explizit:

- Demarcation Point: Übergabepunkt Provider ↔ Kunde (z. B. Carrier-Demarc, CPE-Port).

- Service Edge: z. B. Proxy/Firewall-Egress, VPN-Gateway, Cloud-Interconnect-Endpunkt.

- Client/Branch: Messung nahe am Nutzer (z. B. Probe in der Filiale, Agent auf Client).

- Third-party Targets: definierte Referenzziele im Internet oder in Cloud-Regionen.

Der Schlüssel ist die Messpunkt-Matrix: Für jede Metrik wird festgelegt, an welchem Punkt sie gemessen wird, mit welchem Tool, und wie Datenquellen im Streitfall gewichtet werden.

Messpunkt-Hierarchie als Konfliktlöser

Ein praktisches Vertragsmuster ist eine Priorisierung der Datenquellen, zum Beispiel:

- Primär: synthetische Probes an vereinbarten Messpunkten (gemeinsam betrieben oder transparent bereitgestellt).

- Sekundär: Provider-Telemetrie (Link-Status, Tunnel-Status, Controller-Events).

- Tertiär: Kundensysteme (Client-Logs, App-Monitoring) als ergänzende Evidenz, aber nicht alleiniger SLA-Messer.

Diese Hierarchie reduziert Streit, weil vorab klar ist, welche Messung „vertraglich zählt“.

Messmethoden: synthetisch, passiv, agentbasiert – und ihre Vertragsrisiken

Jede Messmethode hat Stärken und Risiken. Ein gutes SLA/SLO-Design nutzt meist einen Mix, aber definiert klar, was wofür verwendet wird.

- Synthetische Messung: Aktivtests (DNS/TLS/HTTP/ICMP). Vorteil: reproduzierbar; Risiko: Probe-Standorte können Bias haben.

- Passive Messung: Interface Counters, NetFlow/IPFIX, Logs. Vorteil: Ursachenanalyse; Risiko: schwer direkt als Verfügbarkeit zu definieren.

- Agentbasiert: Client-/Branch-Agent. Vorteil: echte Nutzerperspektive; Risiko: Endgeräteprobleme verfälschen SLA.

Ein robustes Vertragsdesign legt fest, welche Messung als „SLA-relevant“ gilt und welche als „diagnostisch“ gilt.

Messfenster, Aggregation und Statistik: Damit Zahlen vergleichbar bleiben

Viele SLA-Reports werden unbrauchbar, weil Aggregationsregeln fehlen oder uneinheitlich sind. Ein solides Design definiert:

- Zeitraum: Monat, Quartal, 28 Tage; inkl./exkl. Wartungsfenster.

- Granularität: Messintervalle (z. B. 1 Minute/5 Minuten) und wie Ausfälle gezählt werden.

- Perzentile: p95/p99 für Latenz; Mean nur ergänzend.

- Degradation-Definition: ab welcher Schwelle gilt eine Minute als degradierend?

- Datenlücken: Was passiert bei fehlenden Messdaten (z. B. Probe offline)?

Gerade bei Datenlücken ist Klarheit wichtig. Wenn Messdaten fehlen, sollten Vertragsregeln definieren, ob dies als „unknown“ (neutral), als „fail“ oder als „exclude“ zählt – und unter welchen Bedingungen.

SLOs sinnvoll setzen: Realistisch, differenziert, mit Fehlerbudget

Ein häufiger Fehler ist das Setzen von SLOs ohne Blick auf Machbarkeit, Kosten und Betrieb. SLOs sollten an Serviceklassen gekoppelt sein (Gold/Silver/Bronze) und ein Fehlerbudget enthalten, das Change-Prozesse steuert.

- Serviceklassen: unterschiedliche Ziele je Standorttyp, Nutzergruppe oder Kritikalität.

- Fehlerbudget: erlaubt geplante Changes, wenn genügend Budget vorhanden ist; erzwingt Stabilitätsmaßnahmen, wenn Budget schnell verbraucht wird.

- Burn-Rate-Logik: frühe Eskalation, wenn SLO-Verbrauch zu schnell steigt.

Fehlerbudgets und Burn Rates sind ein wirksames Bindeglied zwischen Technik und Governance, weil sie eine klare Entscheidungsgrundlage liefern.

Reporting: Was ein SLA-Report enthalten muss, damit er steuerungsfähig ist

Ein SLA-Report ist mehr als eine Zahl. Er muss drei Ziele erfüllen: Nachweis, Transparenz und Verbesserung. Ein guter Report enthält:

- Executive Summary: Erfüllung/Nichterfüllung je SLO, kurze Bewertung.

- Messmethodik: Messpunkte, Tools, Intervalle, Datenlückenbehandlung.

- Trend: Vergleich zu Vormonaten, Saisonalität, Top-Treiber.

- Incident-Analyse: Anzahl, Dauer, Root-Cause-Kategorien, MTTR, Wiederholungsrate.

- Degradation: nicht nur „Down“, sondern Qualitätsverletzungen mit Minuten und betroffenen Standorten.

- Maßnahmenplan: konkrete Verbesserungen, Owner, ETA, erwartete KPI-Wirkung.

Wichtig ist, dass Reporting nicht nur retrospektiv ist. Es sollte eine Brücke zum Betrieb schlagen: Welche Changes werden priorisiert, welche Risiken sind offen, welche Provider- oder Architekturmaßnahmen sind geplant?

Service Credits und Vertragsmechanik: Anreize richtig setzen

Service Credits können sinnvoll sein, aber sie sind kein Ersatz für gute Servicequalität. Falsch designte Credits erzeugen Fehlanreize: Provider optimiert auf Messwerte statt auf Nutzerimpact. Ein gutes Vertragsdesign achtet auf:

- Fairness: Credits beziehen sich auf SLA-relevante Messpunkte und klar definierte Fehlerursachen.

- Cap: Obergrenzen verhindern, dass Credits zum Geschäftsmodell werden.

- Degradation berücksichtigen: Nicht nur Totalausfall, sondern auch starke Qualitätsverletzung.

- Wiederholungsmechanik: Wiederkehrende Probleme können Eskalationsstufen triggern (z. B. Root-Cause-Review, Maßnahmenpflicht).

In vielen Fällen ist ein Maßnahmenplan mit verpflichtendem Improvement-Backlog wertvoller als hohe Credits, weil er systemische Ursachen adressiert.

Multi-Provider und geteilte Verantwortung: SLAs ohne „Fingerpointing“

Netzwerkservices sind oft zusammengesetzt: Carrier, SD-WAN, Security Edge, Cloud Interconnect, DNS. Wenn jeder nur an seinem Übergabepunkt misst, bleibt End-to-End-Qualität ungesteuert. Ein modernes Vertragsdesign nutzt daher eine zweistufige Struktur:

- Component SLAs: pro Provider/Komponente klar definierte Übergabemetriken (z. B. Link Availability am Demarc).

- End-to-End SLOs: serviceorientierte Ziele aus Nutzerperspektive (z. B. Site→Hub p95 RTT), mit klarer Diagnose- und Eskalationslogik.

Wichtig ist, dass End-to-End-SLOs nicht zwangsläufig als „Schuld“ einem Provider zugerechnet werden, sondern als Steuerungsziel für das Gesamtservice-Management dienen.

Security und Compliance im SLA/SLO-Design

Für viele Netzwerkservices sind Security Controls und Nachweise Teil der Leistung. Beispiele sind Logging, Zugriffskontrollen, Rezertifizierung von Ausnahmen oder DDoS-Response-Prozesse. Damit solche Anforderungen nicht „weich“ bleiben, sollten sie als überprüfbare Vertragsbestandteile formuliert werden:

- Logging/Telemetry: definierte Targets, Aufbewahrungsdauer, Integrität, Zugriffskontrolle.

- Change Governance: Review Gates, Notfallprozesse (Break Glass) und Audit Trails.

- Security Response: Reaktionszeiten bei Security Incidents, Kommunikationspflichten, Post-Incident Reviews.

Als gemeinsame Sprache für Service-Management und Betriebsprozesse kann ITIL hilfreich sein, insbesondere wenn Verträge an operative Practices gekoppelt werden sollen: ITIL Practices (AXELOS).

Praktische Muster für häufige Netzwerk-SLAs

Ein solides Vertragsdesign nutzt wiederholbare Muster je Serviceklasse. Einige praxistaugliche Beispiele:

Standort-Konnektivität (WAN/SD-WAN)

- Verfügbarkeit: Tunnel/Overlay verfügbar (synthetisch + Controller-Status) im Monatsfenster

- Qualität: p95 RTT Site→Hub und p95 Loss (profilbasiert)

- Failover: maximale Failover-Time bei N-1 Link Failure (messbar in Game Days oder synthetisch)

- Reporting: Degradation Minutes + Top 5 Root-Cause-Kategorien

Remote Access (VPN/ZTNA)

- Login Success Rate (inkl. IdP/MFA) als SLI, klarer Messpunkt am Gateway/Portal

- p95 Tunnel Establishment Time

- Session Stability (Disconnect Rate)

- Support-Metriken: Time to Acknowledge und MTTR für kritische Login-Ausfälle

DNS-Service

- DNS Query Success Rate (synthetisch, regional verteilt)

- p95 Resolution Time

- Degradation-Definition: z. B. p95 > Schwelle für X Minuten

- Reporting: Korrelation von Spike-Events mit Changes (Change Impact)

Governance: Review, Rezertifizierung und Streitfall-Mechanik

Ein Vertrag lebt nicht nur von Zahlen, sondern von Mechanismen, die dauerhaft funktionieren. Bewährt haben sich:

- Quarterly Service Review: Trends, Ursachen, Maßnahmenplan, SLO-Anpassungen bei geänderter Realität.

- Methodik-Review: Validierung der Messpunkte, Tools, Datenqualität und Zeit-Synchronisation.

- Exception Register: Ausnahmen mit Owner und Ablaufdatum, um KPI-/SLO-Drift zu vermeiden.

- Dispute Window: definierter Zeitraum, in dem Messdaten angefochten werden können, inklusive Evidenzanforderungen.

Damit wird SLA/SLO-Design zu einem steuerbaren System statt zu einem statischen PDF.

Typische Anti-Patterns im SLA/SLO Vertragsdesign

- Uptime-only: Verfügbarkeit ohne Qualitätsmetriken ignoriert Degradation.

- Messpunkt nicht vereinbart: Provider und Kunde messen Unterschiedliches, Streit ist vorprogrammiert.

- Keine Datenlückenregel: Ausfälle werden „unsichtbar“, wenn Messsysteme ausfallen.

- Zu viele Metriken: Reporting wird komplex, niemand steuert danach.

- Service Credits ohne Improvement: Geld fließt, aber Ursachen bleiben.

- Keine Governance: SLOs werden nie angepasst, obwohl Service sich verändert.

Praxis-Blueprint: SLA/SLO Vertragsdesign mit Metriken, Messpunkten und Reporting

- Definieren Sie den Service klar: Scope, Übergabepunkte, Abhängigkeiten, Zielgruppen und Serviceklassen.

- Wählen Sie wenige, hochwertige SLIs: Verfügbarkeit (inkl. Degradation), Qualität (p95/p99 Latenz/Loss/Jitter) und Prozessmetriken (Ack/MTTR) nur dort, wo sie relevant sind.

- Vereinbaren Sie Messpunkte explizit und definieren Sie eine Datenquellen-Hierarchie für Streitfälle.

- Fixieren Sie Messmethodik: Intervalle, Aggregation, Perzentile, Datenlückenbehandlung, Wartungsfensterregeln.

- Formulieren Sie SLOs profilbasiert (Gold/Silver/Bronze) und nutzen Sie Fehlerbudget-Denken zur Steuerung von Changes; orientieren Sie sich an SRE-Prinzipien für Messbarkeit: Google SRE Bücher.

- Gestalten Sie Reporting steuerungsfähig: Executive Summary, Trends, Degradation Minutes, Root-Cause-Kategorien, Maßnahmenplan mit Owner und ETA.

- Setzen Sie Anreize richtig: Service Credits nur mit klaren Definitionen, Caps und verpflichtenden Improvement-Mechanismen.

- Verankern Sie Governance: regelmäßige Service Reviews, Methodik-Reviews, Exception Register mit Ablaufdatum und Dispute Window.

- Nutzen Sie Service-Management-Practices als gemeinsame Sprache, wenn nötig, z. B. über ITIL: ITIL Practices (AXELOS).

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.