Network Security Monitoring ist nur dann wirklich wirksam, wenn Sie mehrere Datenquellen zusammenführen: klassische Logs (Firewall, VPN, DNS, Proxy), Flow-Daten wie NetFlow/IPFIX und moderne Telemetrie (Streaming Telemetry, SNMP-Alternativen, Cloud Flow Logs). Jede einzelne Quelle liefert nur einen Ausschnitt: Logs sind detailreich, aber selektiv; NetFlow/IPFIX ist skalierbar, aber eher „wer spricht mit wem“; Telemetry zeigt Zustand und Performance, aber nicht automatisch den Security-Kontext. Erst die Kombination macht aus Rohdaten eine belastbare Detektion: Sie können Beaconing erkennen (Flow), den Domain-Kontext prüfen (DNS), die Policy-Entscheidung nachvollziehen (Firewall-Log) und gleichzeitig sehen, ob ein Link oder eine Session Table unter Druck gerät (Telemetry). Genau darin liegt der praktische Wert von Network Security Monitoring: bessere Erkennung, schnellere Triage, weniger False Positives und eine forensische Kette, die in Incident Response wirklich hilft. Dieser Artikel zeigt, wie Sie Logs, NetFlow/IPFIX und Telemetry sinnvoll kombinieren, welche Architekturpatterns sich bewährt haben und wie Sie das Ganze so aufbauen, dass es skalierbar, auditierbar und nicht „nur mehr Daten“, sondern bessere Entscheidungen liefert.

Warum eine einzelne Datenquelle nie reicht

Viele Monitoring-Projekte scheitern nicht an fehlenden Tools, sondern an falschen Erwartungen: Ein SIEM mit Firewall-Logs allein erkennt zwar Policy-Drops und einige IOCs, aber keine lateral movement Muster. NetFlow allein erkennt Kommunikationsmuster, aber oft nicht, warum ein Flow stattfindet oder welcher User dahintersteht. Telemetry allein erkennt Engpässe, aber nicht, ob ein Spike ein Angriff oder eine geplante Batch-Operation ist. Deshalb ist die Kombination der Datenquellen der entscheidende Hebel.

- Logs liefern Kontext: User/Device-Informationen, Policy-IDs, NAT-Mappings, Auth-Events, Reason Codes.

- NetFlow/IPFIX liefert Muster: Kommunikation über Zeit, Häufigkeit, Bytes/Pakete, Ports, Gesprächspartner.

- Telemetry liefert Zustand: Interface-Auslastung, Drops, CPU, Session Tables, BGP/OSPF-Flaps, Latenzindikatoren.

Ein gutes Network Security Monitoring baut daher eine „Korrelationsebene“, die alle drei Perspektiven zusammenbringt: Ereignis, Verhalten und Zustand.

Baustein 1: Logs – detailreich, aber nur so gut wie ihre Struktur

Logs sind die wichtigste Quelle für Beweisbarkeit (Evidence) und für konkrete Entscheidungen im Incident: Was wurde erlaubt, was geblockt, welcher User war betroffen, welche Policy griff? Gleichzeitig können Logs teuer werden (Volumen) und ohne Normalisierung schnell unbrauchbar sein. Typische Logquellen im Netzwerk-Sicherheitskontext:

- Firewall/NGFW: Allow/Deny, App-ID, Threat Logs, NAT, User-ID, TLS-Inspection-Events.

- VPN/ZTNA: Login/Logout, MFA-Ergebnisse, zugewiesene IPs, Split-Tunnel-Status.

- DNS: Queries, Antworten, NXDOMAIN, sinkhole hits, DoH-Umgehungsindikatoren.

- Proxy/SWG/SSE: URL-Kategorien, Uploads, block reasons, cloud app control.

- IDS/IPS/NDR: Alerts, signatures, severity, evidence fields.

- Routing/Edge: BGP/OSPF Events, route changes, RTBH/Flowspec-Aktionen (falls relevant).

Best Practice ist, Logs nicht „roh“ zu sammeln, sondern früh zu normalisieren: einheitliche Felder (src/dst, ports, action, policy, user, device), konsistente Zeitzone (UTC) und saubere Identitätszuordnung (IP↔User/Host).

Baustein 2: NetFlow/IPFIX – Skalierung und Verhaltenserkennung

NetFlow und IPFIX liefern eine hochskalierbare Sicht auf Kommunikationsbeziehungen. Statt jedes Paket zu speichern, werden Flows als Datensätze exportiert: Quelle, Ziel, Ports, Protokoll, Dauer, Bytes, Pakete und ggf. zusätzliche Felder. Das macht Flow-Daten ideal für Baselines, Anomalien, Lateralmovement und Exfil-Muster.

- NetFlow: Ursprünglich Cisco-Formate, weit verbreitet.

- IPFIX: Standardisierter Flow-Export (IETF), flexibler durch Templates/Information Elements.

Für IPFIX als Standard ist RFC 7011 eine solide Referenz; es beschreibt Architektur und Exportmechanismen.

Was Flow-Daten besonders gut erkennen

- Beaconing: periodische Verbindungen zu seltenen Zielen (C2-Indikator).

- Lateralmovement: ein Host kontaktiert viele interne Ziele auf Admin-Ports (SMB/RDP/WinRM).

- Exfiltration: ungewöhnliche Upload-Volumen oder neue, seltene Ziele.

- Scan-Verhalten: viele kurze Flows zu vielen Zielen/Ports.

Grenzen von Flow-Daten

- Kein Payload: Sie sehen nicht den Inhalt, sondern nur Metadaten (für viele Use Cases reicht das).

- NAT-Effekte: Ohne NAT-Logs kann die Attribution schwer sein (wer war hinter der NAT-IP?).

- Sampling: In manchen Netzen wird Flow-Sampling genutzt; das reduziert Genauigkeit bei kleinen Flows.

Deshalb ist die Kombination mit Logs (NAT, User, Policy) essenziell.

Baustein 3: Telemetry – Zustand, Performance und Frühwarnsignale

Unter Telemetry versteht man Messwerte und Zustandsdaten aus Netzwerkgeräten und Plattformen. Klassisch ist SNMP, moderner sind Streaming Telemetry (gRPC, dial-out), Syslog-ähnliche Eventstreams oder Cloud-native Metriken. Für Security Monitoring ist Telemetry besonders wertvoll, weil viele Angriffe und Incidents zuerst als Ressourcenproblem sichtbar werden: PPS-Spikes, Drops, CPU-Last, Session-Table-Druck, BGP-Flaps oder Interface-Errors.

- Interface- und Queue-Metriken: Auslastung, Drops, errors, microbursts (je nach Plattform).

- Control Plane: CPU, Memory, Routing Neighbor Flaps, reconvergence events.

- Stateful Ressourcen: Session Table Utilization, NAT Allocation, CPS, TLS Handshake Rate.

- Health Events: HA-Failover, link up/down, policy commit, config drift.

Telemetry beantwortet im Incident oft die wichtigste Frage: „Ist das Problem Security (Angriff) oder Stability (Fehler/Überlast)?“ – und häufig ist es beides.

Die Kombination: Korrelationsmuster, die in der Praxis funktionieren

Die Stärke entsteht in Korrelationen, die einzelne Quellen nicht leisten können. Einige praxiserprobte Muster:

Pattern: Beaconing + DNS + Proxy/Firewall

- Flow: Host A spricht alle 60 Sekunden zu Ziel X auf 443.

- DNS: Kurz vor dem ersten Flow wurde Domain Y aufgelöst, die zu X führt.

- Proxy/Firewall: Verbindung läuft nicht über den vorgesehenen Proxy oder trifft auf ungewöhnliche Kategorie.

- Ergebnis: High-Confidence C2-Verdacht mit klarer Evidence-Kette.

Pattern: Exfiltration + DLP/SWG + Telemetry

- Flow: ungewöhnlich hohe Bytes von einem Server ins Internet.

- SWG/CASB: Uploads zu unbekanntem Cloud-Storage oder „unsanctioned app“.

- Telemetry: Uplink-Utilization steigt, ggf. Queue-Drops; Risiko für Service-Degradation.

- Ergebnis: Incident + Stabilitätsrisiko, klare Containment-Pfade (Block/Rate Limit).

Pattern: Lateralmovement + Auth-Logs

- Flow: Client spricht viele interne Hosts auf SMB/RDP.

- Auth: Kerberos/LDAP Fehlerraten steigen, neue Auth-Ziele für denselben User/Host.

- Firewall: Denies zu No-Go-Zonen (z. B. Client→DB) nehmen zu.

- Ergebnis: Frühe Erkennung von Credential Abuse oder Malware-Worming.

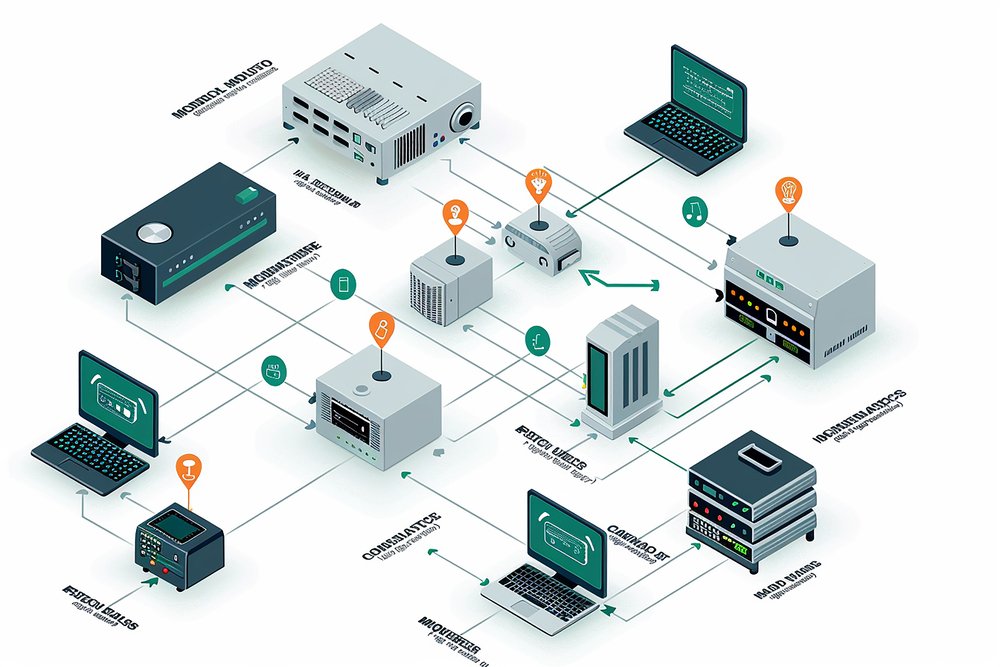

Architektur: Pipeline für Logs, Flows und Telemetry

Ein skalierbares Network Security Monitoring braucht eine Architektur, die Daten zuverlässig einsammelt, normalisiert und korreliert. Ein bewährtes Referenzmuster:

- Ingestion Layer: Syslog/HTTPS Collector für Logs, Flow Collector für NetFlow/IPFIX, Telemetry Collector (gRPC/SNMP/Cloud APIs).

- Normalization Layer: Parsing, Field Mapping, Zeitsynchronisation, Deduplizierung, Enrichment (Asset, User, Geo/ASN).

- Storage Layer: Hot Storage für schnelle Suche, Cold Storage für Retention und Forensik.

- Detection Layer: Regeln, Anomalie-Modelle, Korrelation, Thresholds, Baselines.

- Response Layer: Tickets/SOAR, Playbooks, automatisierte Containment-Aktionen (DNS sinkhole, EDR isolate, FW block).

Wichtig ist „No Silent Drops“: Wenn Ingestion oder Parsing scheitert, verlieren Sie Monitoringfähigkeit. Pipeline-Health (Lag, drop rate, parser errors) gehört selbst ins Monitoring.

Normalisierung und Enrichment: Ohne Kontext entsteht Alert-Fatigue

Die größte operative Gefahr ist Alarmmüdigkeit. Sie entsteht, wenn Datenquellen nicht zusammenpassen: IPs ohne User, NAT ohne Mapping, Flows ohne DNS, Telemetry ohne Service-Kontext. Ein gutes Enrichment-Set umfasst:

- Asset Context: Kritikalität (Prod/Dev), Owner, Rolle (DC, DB, Web), Segment/Zone/VRF.

- Identity Context: IP↔User↔Device (DHCP, VPN, NAC, IdP), besonders für Clients.

- NAT Context: Pre-/Post-NAT Mapping, damit externe Ziele wieder intern zugeordnet werden können.

- Network Context: Zone-Pfade, Policy-IDs, Routing-Domänen (VRF), HA-Status.

- Threat Context: IOC-Labels als Kontext, nicht als alleiniger Trigger.

Ein praxistaugliches Prinzip ist „Enrich first, alert second“: Erst Kontext hinzufügen, dann entscheiden, ob ein Case entsteht.

Use-Case-Katalog: Was Sie zuerst bauen sollten

Statt „alles auf einmal“ empfiehlt sich ein priorisierter Use-Case-Katalog. Gute Starter-Use-Cases sind robust und liefern schnell Wert:

- C2 Beaconing Detection: Flow-basierte Periodizität + DNS-Korrelation.

- DNS Tunneling Heuristiken: NXDOMAIN-Spikes, lange Labels, ungewöhnliche Query-Typen.

- East-West Scanning: viele Ziele/Ports, besonders aus Client-Segmenten in Richtung Server.

- Exfiltration Anomalien: Bytes-out pro Host, neue Ziele, ungewöhnliche Upload-Ziele.

- Policy Violations: Wiederholte Denies an No-Go-Zonen, korreliert mit Auth-Anomalien.

- DDoS/Resource Pressure: PPS/CPS-Spikes + Interface drops + firewall session pressure.

Für die Strukturierung von Detektionen entlang realer Angreifertechniken eignet sich MITRE ATT&CK.

Sampling, Timing und Genauigkeit: Die technischen Fallstricke

Beim Kombinieren der Quellen entstehen typische technische Probleme, die die Detektionsqualität stark beeinflussen:

- Zeitsynchronisation: Wenn Logs und Flows nicht sauber in UTC und NTP-synchron sind, scheitert Korrelation.

- Flow-Sampling: Sampling reduziert Genauigkeit; kleine Flows und kurze Scans können unsichtbar werden.

- Export-Intervalle: Flows werden oft nach Zeitfenstern exportiert; Near-Real-Time braucht passende Settings.

- SPAN/TAP Drops: Packet-basierte Telemetrie kann unter Last droppen; Feed-Health muss überwacht werden.

- NAT und Proxies: Ohne Mapping sind externe Ziele nicht einem Host zuzuordnen; das erhöht False Positives.

Datenschutz und Governance: Monitoring braucht klare Leitplanken

Network Security Monitoring verarbeitet oft personenbezogene oder zumindest personenbeziehbare Daten (User-IP-Mappings, DNS-Queries, Proxy-URLs). Ein professionelles Setup regelt daher:

- Zweckbindung: Security Detection, Incident Response, Betriebsstabilität.

- Retention: Aufbewahrungsdauer nach Datentyp (Flows oft länger als Full URL Logs).

- Access Control: Rollenbasiert, Audit-Logs für Abfragen, besonders bei sensiblen Daten.

- Transparenz: Interne Policies, insbesondere wenn User-Aktivität sichtbar wird.

Für auditierbare Prozesse kann ISO/IEC 27001 als Rahmen dienen.

Operationalisierung: Runbooks, KPIs und kontinuierliches Tuning

Die Qualität eines NSM-Programms zeigt sich im Betrieb. Ohne Runbooks und KPIs wird Monitoring zu einem Log-Friedhof. Bewährte Betriebsbausteine:

- Runbooks pro Use Case: Triage-Schritte, Evidenz, Containment-Optionen, Eskalation.

- Pipeline KPIs: Ingestion lag, drop rate, parser error rate, collector health.

- Detection KPIs: True-positive rate, false-positive rate, MTTD/MTTR, case volume pro Use Case.

- Coverage KPIs: Welche Segmente liefern Flows? Welche Firewalls loggen? Welche Standorte fehlen?

- Rezertifizierung: Ausnahmen, Whitelists, Thresholds regelmäßig prüfen, um Drift zu vermeiden.

Typische Fehlerbilder und wie Sie sie vermeiden

- „Wir sammeln alles, aber finden nichts“: Gegenmaßnahme: Use-Case-Katalog, Korrelationen definieren, nicht nur Storage.

- Alert-Fatigue: Gegenmaßnahme: Enrichment, Scoring, „enrich first“, Timeboxing von Ausnahmen.

- Flow ohne Kontext: Gegenmaßnahme: NAT-, DNS- und Identity-Mappings integrieren.

- Telemetry nur für Ops: Gegenmaßnahme: Security-Use-Cases für Session Pressure, DDoS-Indikatoren, Routing-Anomalien definieren.

- Silent Drops: Gegenmaßnahme: Pipeline-Health überwachen, Alarme auf Ingestion-Ausfälle.

Praktische Checkliste: Logs, NetFlow/IPFIX und Telemetry kombinieren

- 1) Quellen priorisieren: Firewall + DNS + Proxy + VPN als Log-Basis; NetFlow/IPFIX für Baselines; Telemetry für Health.

- 2) Placement planen: Edge + East-West + Identity Core; Flow-Exporter an kritischen Übergängen.

- 3) Zeitdisziplin: NTP überall, UTC-Logging, eindeutige Zeitzonen in allen Systemen.

- 4) Normalisieren: Einheitliches Schema (src/dst/user/device/policy/action), Deduplizierung, Parser-Tests.

- 5) Enrichment integrieren: Asset-Kritikalität, User/IP, NAT-Mappings, DNS-Korrelation, Threat Labels.

- 6) Use Cases implementieren: Beaconing, East-West Scan, Exfil-Anomalien, DNS Tunneling, Policy Violations.

- 7) Response anbinden: SOAR/Tickets, DNS sinkhole, EDR isolation, FW/SWG blocks mit Timeboxing.

- 8) Betrieb messen: Pipeline KPIs, FP/TP-Raten, Coverage, regelmäßige Rezertifizierung.

Outbound-Quellen für Standards und Vertiefung

- RFC 7011 (IPFIX) als Standardgrundlage für Flow-Export und Information Elements.

- MITRE ATT&CK zur Strukturierung von Detektions-Use-Cases entlang realer Angreifertechniken.

- CIS Controls für praxisnahe Kontrollen zu Monitoring, Logging, Incident-Prozessen und kontinuierlicher Verbesserung.

- ISO/IEC 27001 Überblick für Governance, Verantwortlichkeiten und auditierbare Nachweisführung.

- RFC 8484 (DNS over HTTPS) als Kontext, warum DNS-Telemetrie und Enforcement in NSM-Architekturen zunehmend wichtiger werden.

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.