Das Hauptkeyword Backpressure vs. Retry Storm beschreibt einen der wichtigsten Hebel in der Zuverlässigkeitsarbeit moderner verteilten Systeme: Sie müssen verhindern, dass Fehler und Überlast nicht nur auftreten, sondern sich durch automatische Wiederholungen, Timeouts und Warteschlangen kaskadieren und dadurch massiv verstärken. In Microservices-Architekturen, bei Event-Streaming und in API-getriebenen Plattformen wirkt eine kleine Störung selten lokal. Ein langsam werdender Downstream, eine kurzzeitige Datenbank-Degradation oder eine Rate-Limit-Änderung kann innerhalb weniger Minuten in einen „Retry Storm“ kippen: Clients senden denselben Request mehrfach, Worker-Pools füllen sich, Queues wachsen, CPU und I/O steigen, und die Gesamt-Latenz explodiert. Backpressure verfolgt das entgegengesetzte Prinzip: Statt Last ungezügelt weiterzureichen, wird sie aktiv gedrosselt, verlangsamt oder abgewiesen – möglichst früh und mit klarer Semantik. Damit wird nicht „mehr Leistung“ erzeugt, sondern Stabilität: Das System bleibt kontrollierbar, und kritische Pfade behalten Priorität. Dieser Artikel erklärt, wie sich Backpressure und Retry Storm unterscheiden, warum Retries oft unabsichtlich Fehler-Amplifikation erzeugen, welche Muster im Betrieb besonders gefährlich sind und wie Sie mit klaren Strategien (Timeout-Budgets, Jitter, Rate Limiting, Circuit Breaker, Load Shedding) die Zuverlässigkeit erhöhen, ohne Nutzer unnötig zu frustrieren.

Begriffe sauber trennen: Backpressure, Retries und Fehler-Amplifikation

In der Praxis werden „Retry“, „Backoff“ und „Backpressure“ häufig in einen Topf geworfen. Dabei verfolgen sie unterschiedliche Ziele:

- Retry: Ein Client versucht eine fehlgeschlagene Operation erneut, um transiente Fehler zu überbrücken (z. B. kurzer Netzwerk-Hiccup, kurzzeitige Überlast).

- Retry Storm: Viele Clients oder Worker wiederholen gleichzeitig und aggressiv, wodurch die Last steigt und die ursprüngliche Störung verschärft wird.

- Backpressure: Ein System signalisiert oder erzwingt, dass es weniger oder langsamer belastet werden kann, um Stabilität zu sichern (z. B. durch Flow Control, Queue-Limits, Rate Limits oder 429/503).

- Fehler-Amplifikation: Ein Problem verursacht Folgeeffekte, die größer sind als der Auslöser, etwa durch Retries, Kaskaden-Timeouts oder Warteschlangen, die wiederum weitere Fehler erzeugen.

Der Kernkonflikt: Retries können Verfügbarkeit verbessern – aber nur, wenn sie dosiert sind und das System einen stabilen Zustand erreicht. Backpressure schafft genau diese Stabilität, indem es Last in kontrollierte Bahnen lenkt.

Warum Retry Storms so häufig entstehen

Retry Storms sind selten das Ergebnis einer einzelnen Fehlentscheidung. Meist ist es eine Kombination aus „vernünftigen Defaults“, die in Summe gefährlich werden:

- Gleichzeitige Clients: Viele Instanzen starten oder skalieren hoch und treffen denselben Downstream (z. B. nach Deployment oder Incident).

- Zu kurze Timeouts: Wenn Timeouts zu aggressiv sind, werden Requests abgebrochen, obwohl der Server noch arbeitet; der Client retryt – die Serverlast steigt.

- Synchronisierte Retries: Ohne Jitter retryen Clients nach identischem Backoff (z. B. exakt 100 ms, 200 ms, 400 ms), wodurch Lastwellen entstehen.

- Retries auf nicht-idempotenten Operationen: Wiederholungen können Nebenwirkungen erzeugen (doppelte Buchung, doppelte Jobs), was Reparaturtraffic und manuelle Korrekturen auslöst.

- Fehlende Obergrenzen: Kein Cap für parallele Requests, keine Queue-Limits, keine per-Client Rate Limits – Last kann unendlich steigen.

Eine prägnante Einführung zu Retries, Timeouts und deren Risiken finden Sie im Google-SRE-Kontext, z. B. über das frei verfügbare Online-Buch Site Reliability Engineering.

Fehler-Amplifikation mathematisch greifbar machen

Damit Teams das Risiko nicht nur „gefühlt“ verstehen, hilft ein einfaches Modell: Wenn ein Anteil der Requests fehlschlägt und jeder Fehler im Schnitt zu weiteren Versuchen führt, wächst das effektive Anfragevolumen. Eine vereinfachte Näherung:

Reff = R × ( 1 + aretry )

Hier steht R für das ursprüngliche Request-Volumen und aretry für die durchschnittliche zusätzliche Retry-Last pro Request (z. B. 0,3 bedeutet: 30 % Zusatztraffic). In realen Systemen ist aretry jedoch nicht konstant: Unter Last steigen Timeouts, wodurch Retries zunehmen, wodurch Last weiter steigt – ein klassischer positiver Feedback-Loop.

Backpressure als Stabilitätsmechanismus: Prinzip und Ziel

Backpressure bedeutet nicht, „Nutzer abzuweisen, weil es einfacher ist“, sondern das System so zu steuern, dass es in einem stabilen Arbeitsbereich bleibt. Das Ziel ist ein kontrollierter Durchsatz mit vorhersagbarer Latenz, statt maximalem Durchsatz mit unkontrollierbaren Tail-Latenzen. Backpressure kann an mehreren Stellen greifen:

- Client-seitig: Begrenzung paralleler Requests, adaptive Concurrency, respektierte Retry-After-Header.

- Server-seitig: Rate Limits, Queue-Limits, Load Shedding, Priorisierung kritischer Endpoints.

- Zwischenschichten: API Gateway, Service Mesh, Load Balancer, Message Broker.

- Protokollebene: Flow Control (z. B. HTTP/2), Window-Mechanismen, Streaming Backpressure.

Besonders klar formuliert ist der Backpressure-Gedanke in der Spezifikation zu reaktiven Streams, die explizit „Demand“ signalisiert, statt unbegrenzt zu pushen: Reactive Streams.

Backpressure-Mechanismen in der Praxis

Rate Limiting und faire Verteilung

Rate Limiting ist oft die erste Linie: pro Client, pro Token, pro Tenant oder pro Endpoint. Wichtig ist die Semantik: Ein klarer 429 (Too Many Requests) oder 503 (Service Unavailable) mit Retry-After kann Clients dazu bringen, Last zu reduzieren, statt im Blindflug zu retryen. Entscheidend sind Fairness und Schutz kritischer Flows: Ein „lauter“ Tenant darf nicht alle anderen verdrängen.

Queue-Limits und Load Shedding

Queues kaschieren Probleme nur kurzfristig. Wird die Warteschlange zu groß, steigt die Latenz; Clients timeouten und retryen – die Amplifikation beginnt. Daher sollten Queues explizite Obergrenzen haben. Wird das Limit erreicht, ist ein kontrolliertes Abweisen besser als unendliches Anstauen. Load Shedding kann dabei nach Regeln erfolgen, z. B. zuerst Low-Priority-Requests abweisen oder teure Endpoints drosseln.

Adaptive Concurrency

Statt fixen Parallelitätswerten kann ein Client (oder ein Gateway) die gleichzeitigen Requests dynamisch an die beobachtete Latenz anpassen. Das Prinzip: Wenn Latenz steigt, wird Concurrency reduziert; wenn Latenz stabil sinkt, wird vorsichtig erhöht. So vermeiden Sie, dass ein einzelner Downstream unter Last „umkippt“.

Circuit Breaker und Bulkheads

Circuit Breaker verhindern, dass ein Downstream dauerhaft mit sinnlosen Versuchen überflutet wird. Bulkheads (Isolation) sorgen dafür, dass ein Problem in einer Abhängigkeit nicht alle Ressourcen frisst. Für JVM- und Cloud-native Umgebungen ist Resilience4j eine verbreitete Referenz für Circuit Breaker, Rate Limiter und Bulkheads, unabhängig davon, ob Sie die Bibliothek direkt nutzen oder das Konzept übertragen.

Retry Storm vermeiden: Retry-Design, das wirklich robust ist

Retries sind nicht grundsätzlich schlecht. Das Ziel ist „nützliche Retries“ statt „ungezähmter Retries“. Die wichtigsten Designregeln:

- Idempotency zuerst: Retries nur dort, wo die Operation sicher wiederholt werden kann (GET, idempotente PUTs) oder wo ein Idempotency-Key verwendet wird.

- Begrenzte Versuche: Harte Obergrenze (z. B. max 2–3) und danach kontrolliertes Failover oder Fehler an den Nutzer.

- Exponential Backoff + Jitter: Backoff ohne Jitter synchronisiert Clients; Jitter glättet Lastspitzen.

- Retry nur bei transienten Fehlern: Nicht bei 4xx, Validierungsfehlern oder „hard failures“. Timeouts und 5xx brauchen Differenzierung.

- Retry-Budget: Begrenzen Sie die Retry-Last pro Zeiteinheit, damit Retries nicht den Primärtraffic verdrängen.

- Hedged Requests vorsichtig: Parallele „Sicherheitsrequests“ können Tail Latency reduzieren, erhöhen aber Last; nur in klaren Grenzen einsetzen.

Ein praktischer Leitfaden zu Timeouts, Retries und Jitter findet sich auch in Cloud-Architektur-Empfehlungen, z. B. im AWS-Umfeld zum Thema Exponential Backoff und Jitter: Timeouts, retries and backoff with jitter.

Backpressure vs. Retry Storm in typischen Incident-Patterns

Pattern: Downstream wird langsam, aber nicht „down“

Das gefährlichste Szenario: Ein Service antwortet noch, aber langsamer. Clients sehen Timeouts, retryen, und der Downstream bekommt mehr Last genau dann, wenn er weniger verträgt. Backpressure würde hier bedeuten: Frühes Drosseln (429/503), Concurrency reduzieren, Queue begrenzen, Circuit Breaker öffnen, bevor alle Worker blockieren.

Pattern: Datenbank-Degradation mit langen Locks

Lange Locks verlängern Requests. Ohne Queue-Limit sammeln sich Requests an, die alle auf denselben Engpass warten. Das führt zu „Thread Pool Starvation“: Das System ist formal verfügbar, aber praktisch handlungsunfähig. Backpressure schützt, indem neue Requests früh abgewiesen werden, damit bestehende abschließen können.

Pattern: External API Rate Limit oder Teilausfall

Externe Abhängigkeiten sind prädestiniert für Retry Storms, weil Teams „einfach mehr versuchen“. Hier ist ein Circuit Breaker plus Bulkhead essenziell, kombiniert mit Caching oder Degradationspfaden (z. B. „best effort“ statt „hard requirement“).

Pattern: Deployment/Autoscaling und Cold Starts

Wenn viele Instanzen gleichzeitig starten, kann es zu Lastspitzen auf Auth, Config, DNS, DB oder Cache kommen. Ohne Jitter und ohne gestaffelte Warmups retryen Instanzen synchron. Backpressure auf Plattformebene (z. B. Ratenbegrenzung für Init-Calls) verhindert, dass Bootstrapping die Plattform destabilisiert.

Die OSI-/Layer-Perspektive: Warum das Problem meist Layer 7 ist, obwohl es wie „Netzwerk“ wirkt

Retry Storms werden im Incident häufig als „Netzwerkproblem“ wahrgenommen, weil Timeouts, Verbindungsabbrüche und erhöhte Latenz auftreten. In vielen Fällen ist die Root Cause jedoch Layer 7: zu aggressive Timeouts, falsche Retry-Logik, fehlende Limits, ungünstige Priorisierung. Das Netzwerk zeigt dann nur die Symptome: mehr Verbindungen, mehr SYNs, mehr Retransmits, mehr Queueing im LB. Die Gegenmaßnahme ist selten „mehr Bandbreite“, sondern „weniger unnötige Wiederholung“ und „früher kontrolliert drosseln“.

Observability: Welche Signale Backpressure und Retry Storm eindeutig unterscheiden

Damit Sie nicht im Nebel operieren, sollten Sie Telemetrie gezielt auf „Amplifikation“ ausrichten. Sinnvolle Signale:

- Retry-Rate: Anteil der Requests mit attempt>1 (aus Tracing oder Client-Metriken).

- Timeout-Rate: Timeouts pro Endpoint und pro Downstream-Abhängigkeit.

- Queue-Länge und Queue-Wartezeit: nicht nur Durchsatz, sondern Wartezeit vor Verarbeitung.

- Concurrency/Inflight: gleichzeitige Requests pro Service und pro Abhängigkeit.

- Fehlerklassifizierung: 429/503 mit Retry-After (Backpressure) vs. 5xx/Timeouts (Degradation/Outage).

- Tail Latency: p95/p99/p999, getrennt nach Endpoint und Tenant – Retry Storms zeigen oft starke Tail-Ausreißer.

Distributed Tracing ist besonders wertvoll, weil Sie Retries, Zeitanteile (Self Time vs. Downstream) und Kaskaden sichtbar machen. Für einheitliche Instrumentierung ist OpenTelemetry eine solide Grundlage.

Konkrete Schutzmaßnahmen als Runbook: So verhindern Sie Amplifikation im Betrieb

- Timeout-Budgets definieren: Verteilen Sie ein End-to-End-Latenzbudget auf Downstream-Calls, statt überall denselben Default zu setzen.

- Retry-Policy standardisieren: Max Attempts, Backoff, Jitter, Fehlerklassen, Idempotency-Key-Strategie.

- Backpressure-Semantik etablieren: 429/503 gezielt einsetzen, Retry-After korrekt setzen, Clients verpflichten, das zu respektieren.

- Queue-Limits hart machen: Keine unendlichen Queues; lieber kontrolliert abweisen als unkontrolliert warten lassen.

- Bulkheads pro kritischem Pfad: Separate Pools/Threads/Worker für „Checkout“, „Login“, „Core API“, damit Nebenpfade nicht alles blockieren.

- Circuit Breaker mit klaren Schwellen: Öffnen bei hoher Fehler-/Timeout-Rate, Half-Open-Tests begrenzen, nicht „alle gleichzeitig“.

- Fail Fast statt Fail Slow: Wenn eine Abhängigkeit krank ist, schnell und sauber degradieren, statt lange zu warten und dann zu retryen.

- Lasttests mit Retries an: Prüfen Sie nicht nur „Happy Path“, sondern realistische Client-Policies und Incident-ähnliche Szenarien.

Häufige Missverständnisse, die Teams teuer bezahlen

- „Mehr Retries erhöht Verfügbarkeit“: Kurzfristig manchmal, langfristig oft nicht – Retries können Verfügbarkeit senken, wenn sie Last verstärken.

- „Queues sind Puffer“: Queues sind Verzögerer. Ohne Limits verschieben Sie das Problem in die Zukunft und erhöhen Tail Latency.

- „Timeouts so klein wie möglich“: Zu kleine Timeouts erhöhen Abbrüche und Retries; besser sind abgestimmte Timeouts pro Abhängigkeit.

- „Backpressure ist Nutzer-unfreundlich“: Kontrolliertes Drosseln ist häufig nutzerfreundlicher als minutenlange Hänger und wiederholte Fehler.

Praktische Entscheidungshilfe: Wann Backpressure – wann Retry?

Eine robuste Heuristik für den Alltag:

- Transiente, kurze Störung (sporadischer 503, kurzer Netz-Jitter): begrenzter Retry mit Jitter ist sinnvoll.

- Anhaltende Überlast oder steigende Latenz: Backpressure priorisieren (Rate Limit, Queue-Limit, adaptive Concurrency).

- Externe Abhängigkeit mit Rate Limits: Backpressure + Circuit Breaker und ggf. Caching/Degradation.

- Nicht-idempotente Operation: kein automatischer Retry ohne Idempotency-Key und klare Semantik.

Wenn Sie diese Leitplanken konsequent umsetzen, reduzieren Sie nicht nur Incidents, sondern auch die „unsichtbaren“ Kosten: unnötigen Traffic, überdimensionierte Infrastruktur, frustrierte Nutzer durch instabile Latenzen und den operativen Aufwand, der entsteht, wenn ein kleiner Fehler zum Flächenbrand wird.

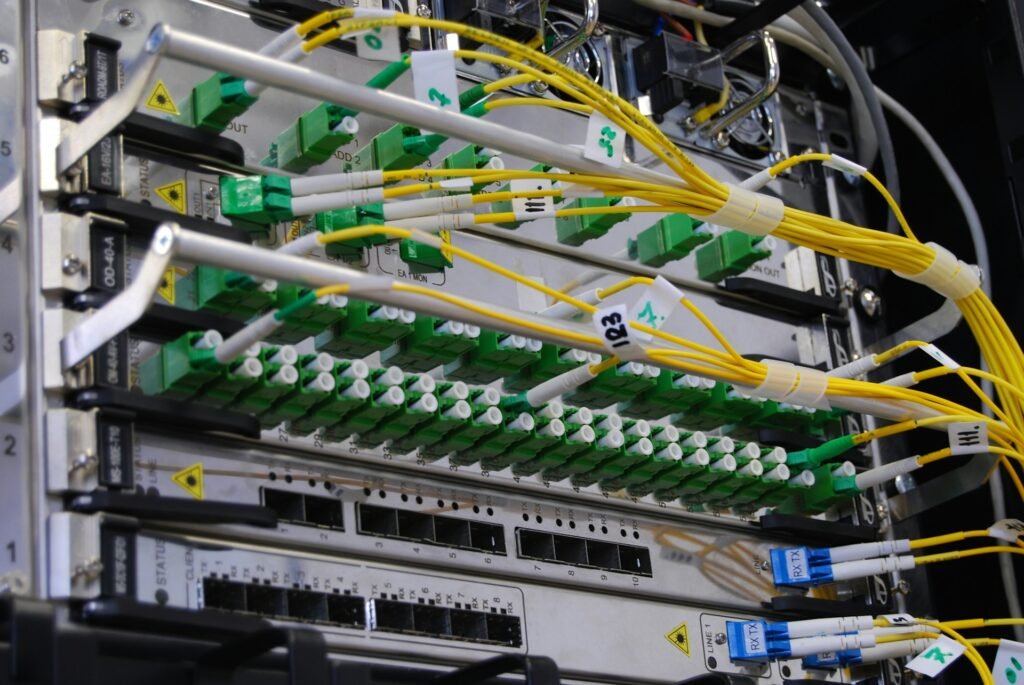

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.