Edge Computing Networking: Standorte, Latenzbudgets und Betrieb ist eine Architekturdisziplin, die klassische Netzwerkplanung deutlich verschärft. Während zentrale Rechenzentren und Cloud-Regionen vor allem über Skalierung und Standardisierung überzeugen, entsteht Edge Computing aus einem harten Bedarf: bestimmte Workloads müssen näher an Geräte, Maschinen, Kameras, Filialen, Produktionslinien oder Nutzer gebracht werden. Die Gründe sind meist eindeutig: strenge Latenzanforderungen, lokale Datenverarbeitung (Datenschutz, Bandbreite, Kosten), höhere Resilienz bei WAN-Ausfällen oder die Notwendigkeit, auch ohne Cloud-Konnektivität weiterarbeiten zu können. Genau hier wird Networking zum kritischen Erfolgsfaktor. Denn Edge-Standorte sind häufig klein, verteilt, heterogen und operativ schwierig: begrenzte IT-Präsenz vor Ort, wechselnde Providerqualität, eingeschränkte Stromversorgung, wenig Platz, plus Security- und Compliance-Druck. Gleichzeitig ist das Erwartungsniveau hoch: „Es muss immer laufen, und es muss schnell sein.“ Ein professionelles Edge Computing Networking übersetzt diese Anforderungen in ein klares Standortmodell, in Latenzbudgets entlang kompletter Datenpfade und in ein Operating Model, das Automatisierung, Observability, Incident Response und Lifecycle konsequent berücksichtigt. Dieser Beitrag zeigt, wie Sie Edge-Standorte netzwerkseitig sauber designen, wie Sie Latenzbudgets realistisch planen und wie Sie den Betrieb so aufsetzen, dass Edge nicht zur unbeherrschbaren Inselwelt wird.

Edge ist nicht gleich Edge: Standorttypen und Einsatzmuster

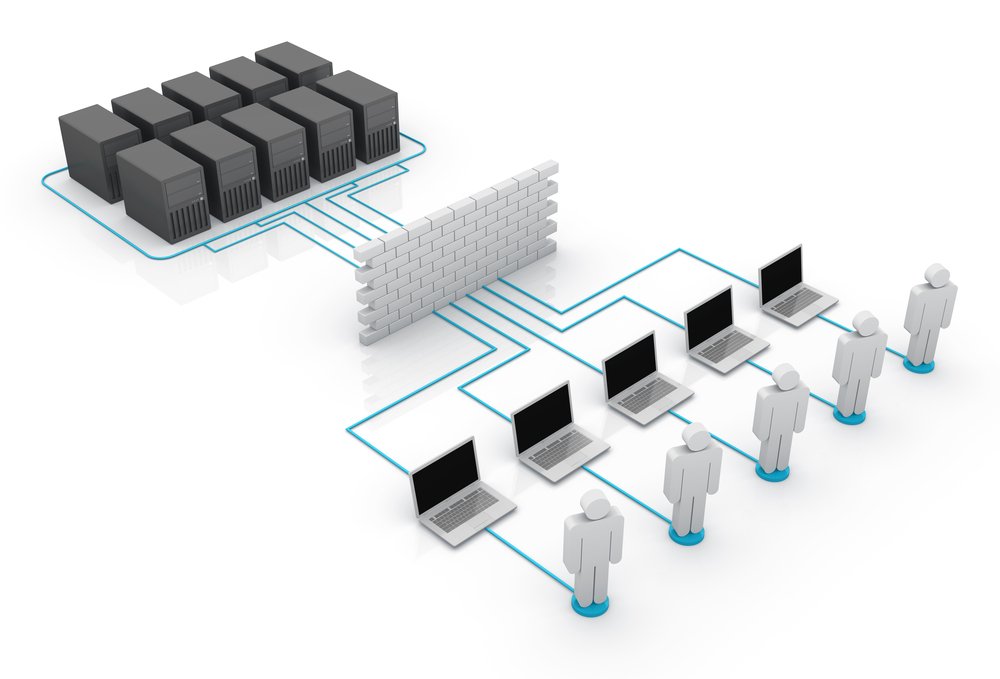

Der Begriff „Edge“ wird sehr breit verwendet. Für das Networking ist es wichtig, Standorttypen zu unterscheiden, weil sich daraus Redundanz, Kapazität, Sicherheitskontrollen und Betriebsprozesse ableiten.

- Industrial Edge (OT): Produktionsumgebungen, Sensorik, Steuerung, Echtzeitnähe. Hohe Anforderungen an deterministisches Verhalten und Segmentierung zwischen IT und OT.

- Retail/Branch Edge: Filialen, Kassen, Video, lokale Services, oft stark abhängig von SaaS und zentralen Plattformen.

- Telco/MEC Edge: Edge-Knoten nahe Mobilfunk-PoPs für latenzkritische Dienste. Konzepte aus Multi-access Edge Computing (MEC) sind hier relevant: ETSI MEC.

- Content/Service Edge: CDN-nahe Services, API-Edges, Anycast-Patterns; Fokus auf Performance und globale Verfügbarkeit.

- On-Prem Micro-DC: kleine „Mini-Rechenzentren“ in Standorten, oft mit lokaler Virtualisierung oder Kubernetes.

Ein gutes Standortmodell definiert pro Edge-Typ klare Profile (Bandbreite, Redundanz, Security Controls, Monitoring), statt jede Location individuell zu designen.

Das wichtigste Konzept: Latenzbudgets statt „Ping-Ziele“

Edge-Projekte scheitern häufig, weil Latenz als einzelne Zahl betrachtet wird („unter 20 ms“), ohne den gesamten Pfad zu budgetieren. In der Realität ist Latenz ein End-to-End-Produkt aus Netzwerk, Compute, Storage, Queues und Security Inspection. Ein Latenzbudget verteilt die erlaubte Zeit auf Teilstrecken und macht Designentscheidungen überprüfbar.

Latenzbudget als Kette von Teilbudgets

- Device/Access: Sensor/Client bis Edge-Switch/Access Point (inkl. WLAN-Overhead, Roaming, Funkbedingungen).

- Local Edge Fabric: Switching/Routing innerhalb des Standorts, inklusive Queueing und Mikrobursts.

- Security Path: Firewall/Proxy/Inspection, mTLS, Auth-Checks; kann je nach Policy signifikant sein.

- WAN/Backhaul: Providerpfad zum regionalen Hub, zur Cloud oder zu einem zentralen Datacenter.

- Service Layer: Applikationsverarbeitung, Datenbankzugriff, Cache, Message Broker.

Ein praktischer Ansatz ist, nicht nur „Durchschnittslatenz“ zu messen, sondern Perzentile (p95/p99) und „Degradation Minutes“ zu betrachten, weil Edge-Qualität oft schwankt.

Standortdesign: Profile, Redundanz und Failure Domains

Edge-Standorte müssen wie Produkte behandelt werden: ein definiertes Design, vielfach reproduzierbar, mit klaren SLOs. Das gelingt über Standortprofile, die technische Erwartungen an Konnektivität und Resilienz festlegen.

Typische Standortprofile

- Bronze: ein Underlay-Link (z. B. Internet), optional Mobilfunk-Fallback, begrenzte lokale Redundanz, definierte Degradationsfähigkeit.

- Silver: zwei Underlays (z. B. Internet + LTE/5G oder Internet + MPLS), Baseline-HA für kritische CPE-Komponenten.

- Gold: zwei unabhängige Provider/Last-Mile-Zuführungen, N-1-fähig bei Peak für kritische Klassen, saubere Power-Redundanz, strengere Monitoring- und Wartungsanforderungen.

Wichtig ist „Diversity“: Zwei Links sind nur dann redundant, wenn sie nicht dieselbe Ausfallursache teilen (gleicher Provider-PoP, gleicher Baugraben, gleiche Stromversorgung).

Underlay und Transport: Internet, MPLS, Mobilfunk und die harte Realität

Edge-Netzwerke hängen oft an Providerqualität. Ein professionelles Design akzeptiert diese Realität und baut Mechanismen ein, um Degradation zu erkennen und Pfade dynamisch zu steuern.

- Internet: gut verfügbar und günstig, aber mit variabler Latenz, Jitter und Peering-Abhängigkeiten.

- MPLS: häufig stabiler und mit QoS-Klassen, aber teurer und weniger flexibel.

- LTE/5G: wertvoll als Backup oder für temporäre Standorte; allerdings variabel und mit eigenen Security-/NAT-Charakteristiken.

In vielen Edge-Programmen wird ein SD-WAN- oder SASE-Ansatz genutzt, um Underlay-Variabilität zu abstrahieren. Entscheidend bleibt aber: Underlay muss gemessen werden (Loss/Jitter/Latenz), nicht nur „Link up“. Für methodische Steuerung über SLIs/SLOs sind SRE-Prinzipien ein hilfreicher Rahmen: Google SRE Bücher.

Overlay und Segmentierung: VRFs, Zonen und Mikrosegmentierung am Edge

Edge-Standorte bringen oft mehrere Sicherheitsdomänen zusammen: Corporate IT, OT/IoT, Gastnetz, Kameras, Payment, Management. Ohne saubere Segmentierung entsteht laterales Risiko. Moderne Muster kombinieren grobe Isolation (VRF/Zonen) mit feineren Policies (Mikrosegmentierung, tags).

- VRF-/Zonenmodell: wenige stabile VRFs (z. B. Corp, OT, Guest, Mgmt) mit klaren Inter-VRF-Policy Points.

- Shared Services: DNS/NTP/Logging in einem kontrollierten Service-Segment, statt „überall erreichbar“.

- Identity am Edge: NAC/802.1X, Device Posture, Rollenmodelle; wichtig für „Zero Trust“ im Zugriff.

Für Zero-Trust-Architekturprinzipien ist NIST SP 800-207 eine robuste Referenz: NIST SP 800-207.

Edge Security Controls: Schutz ohne Performance-Kollaps

Am Edge ist Security besonders schwierig, weil der Standort oft wenig „Puffer“ hat: begrenzte Bandbreite, kleine CPE, wenig IT-Personal. Gleichzeitig ist das Risiko hoch: physischer Zugriff, heterogene Geräte, IoT/OT-Komponenten, wechselnde Nutzer.

- Minimum Controls: Segmentierung, Management-Isolation, Audit Logs, zentrale Authentisierung, Hardening.

- Egress-Kontrolle: DNS-Filter/SWG/Proxy je nach Profil; besonders wichtig gegen C2- und Exfiltration.

- Local survivability: Sicherheitsfunktionen dürfen kritische lokale Prozesse nicht blockieren, wenn WAN weg ist.

- Ausnahmen mit Ablaufdatum: temporäre Öffnungen müssen rezertifizierbar sein, sonst erodiert das Design.

Als Sicherheitsbaseline für organisatorische und technische Mindestpraktiken können die CIS Controls als gemeinsame Sprache dienen: CIS Controls.

Lokale Resilienz: Was passiert, wenn WAN oder Cloud ausfällt?

Edge ist häufig gerade deshalb da, weil „nicht alles von der Cloud abhängen darf“. Daher muss das Netzwerkdesign definieren, welche Funktionen lokal weiterlaufen und welche degradiert werden dürfen.

- Local-first: kritische Prozesse laufen lokal, synchronisieren später (Store-and-forward, lokale Queue).

- Degraded mode: reduzierte Funktionalität ohne WAN (z. B. lokale Auth-Caches, lokale DNS-Resolver, lokale Control Loops).

- Fail-safe: klare Regeln, welche Verbindungen im Zweifel blockiert werden (Security) und welche erlaubt bleiben (Safety/Operations).

Diese Entscheidungen müssen als „Invariants“ dokumentiert und getestet werden (Failure Scenario Workshops). Sonst entsteht im Ernstfall improvisierte Betriebslogik.

Observability am Edge: Telemetry, Logs und echte Service-Signale

Edge-Observability scheitert oft daran, dass Standorte „klein“ sind und Monitoring als optional gilt. In der Praxis sind Edge-Standorte schwer zu erreichen und deshalb besonders observability-lastig: Sie brauchen Messbarkeit, weil Sie nicht „mal kurz hinfahren“ können.

- Service-Probes: DNS/TLS-Checks, Site-to-Hub RTT, SaaS-Endpunkte, lokale App-Health.

- Netztelemetrie: Loss/Jitter/Latenz, Interface Errors, Queue Drops, CPU/Memory, Tunnel-Health.

- Flow-Visibility: NetFlow/IPFIX oder ähnliche Mechanismen, um Exposures und Anomalien zu erkennen.

- Time Sync: NTP/PTP sauber designen, weil Forensik und Korrelation sonst wertlos sind.

Als Referenzrahmen für saubere Signalmodelle (Logs/Metriken/Traces) ist OpenTelemetry hilfreich: OpenTelemetry.

Betrieb am Edge: Runbooks, RACI und „Remote Hands“-Realität

Edge-Standorte scheitern selten an Architektur allein, sondern am Betrieb: Wer macht was, wenn ein Standort degrade’t? Wer darf remote eingreifen? Welche Aktionen sind „safe“, welche brauchen Freigaben? Ein tragfähiges Operating Model umfasst:

- Runbooks: Path Degradation, Tunnel Flaps, lokale Switch-Probleme, Zertifikats-/Identity-Failures, Failover-Tests.

- RACI: Netzwerk, Security, Workplace/Field Services, Provider – Verantwortlichkeiten müssen klar sein.

- Remote Access & OOB: Out-of-Band-Management, Break-Glass-Accounts, MFA, Audit Logging.

- Eskalation: klare War-Room-Struktur und Stop-Kriterien bei riskanten Changes.

Wenn ITSM-Prozesse etabliert sind, kann ITIL als gemeinsame Sprache für Incident/Change/Problem Management helfen: ITIL Practices (AXELOS).

Standardisierung und Automation: Edge skaliert nur mit Templates

Edge Computing ist per Definition verteilt. Jeder manuelle Sonderfall skaliert daher schlecht. Erfolgreiche Edge-Programme setzen auf Standardisierung:

- Templates: Standortprofile, Segmentierung, Routing, QoS, Security Baselines als wiederverwendbare Bausteine.

- Source of Truth: Inventar, Standortdaten, IP- und Policy-Modelle als verlässliche Datenbasis.

- CI/CD für Netzwerkänderungen: Reviews, Validierungen, Canary-Rollouts, automatisierte Post-Checks.

- Drift Prevention: Abweichungen erkennen und kontrolliert zurückführen.

Für Policy-as-Code und Guardrails ist Open Policy Agent ein verbreiteter Referenzpunkt: Open Policy Agent.

Testing und Failure Scenarios: Edge-Qualität beweisen statt hoffen

Edge ist besonders anfällig für „Brownouts“: Degradation statt kompletter Ausfall. Deshalb müssen Tests Link degrade, Packet Loss, Jitter-Spikes und DNS/Identity-Abhängigkeiten enthalten. Sinnvolle Testszenarien:

- Underlay degrade: 1–3 % Loss oder erhöhtes Jitter, um Real-Time-Sensitivität zu prüfen.

- Link down: Failover-Zeiten und Headroom (N-1) überprüfen.

- Provider blackhole: Link bleibt „up“, aber Traffic verschwindet; Monitoring muss das erkennen.

- Identity/DNS failure: lokale Caches und Fallbacks validieren.

- Security Enforcement: Can/Can’t-Flows testen, damit Segmentierung nicht bei Failover bricht.

Latenzbudgets in der Praxis: Ein Vorgehen, das Teams nutzen

Damit Latenzbudgets nicht theoretisch bleiben, sollten Sie sie in Arbeitsabläufe integrieren:

- Pro Serviceklasse: Real-Time vs. Business-Critical vs. Best-Effort erhalten eigene Budgets.

- Pro Standortprofil: Bronze/Silver/Gold haben unterschiedliche SLOs; das ist ehrlich und steuerbar.

- Messpunkte festlegen: Wo messen Sie p95/p99? Edge-to-Edge, Device-to-Edge, Edge-to-Cloud?

- Stop-Kriterien: Wartung und Changes werden abgebrochen, wenn Budgets verletzt werden.

So wird Latenzbudgeting zu einem operativen Werkzeug statt zu einem Architekturdiagramm.

Typische Anti-Patterns im Edge Computing Networking

- Jeder Standort einzigartig: fehlende Templates und Profile führen zu unbeherrschbarer Varianz.

- Uptime statt Qualität: Link ist „up“, aber Loss/Jitter zerstören Nutzererfahrung; Monitoring sieht es zu spät.

- Keine lokale Resilienz: WAN-Ausfall legt lokale Prozesse lahm, obwohl Edge genau das verhindern sollte.

- Segmentierung nur „auf dem Papier“: VLANs ohne klare Trust Boundaries und Enforcement erzeugen Scheinsicherheit.

- Kein OOB/Break-Glass: im Incident ist der Standort nicht erreichbar, Recovery dauert zu lange.

- Security als Big Bang: Kontrollen werden ohne Visibility und Prozess eingeführt, Produktion bricht.

Blueprint: Edge Computing Networking stabil und skalierbar aufbauen

- Definieren Sie Standorttypen und Profile (Bronze/Silver/Gold) mit klaren Anforderungen an Diversity, Kapazität und lokale Resilienz.

- Planen Sie Latenzbudgets end-to-end: verteilen Sie Budgets auf Access, lokale Fabric, Security Path, WAN und Service Layer; messen Sie p95/p99 statt Durchschnitt.

- Designen Sie Underlay realistisch: Provider-Diversity, Last-Mile-Diversity, Mobilfunk als Fallback; prüfen Sie N-1 Headroom für kritische Klassen.

- Setzen Sie auf saubere Segmentierung: wenige stabile VRFs/Zonen (Corp/OT/Guest/Mgmt), kontrollierte Inter-Zone-Policies, Shared Services sauber anbinden.

- Verankern Sie Security Controls operativ: Egress-Kontrolle, DNS/Proxy-Policies, Audit Logs, Hardening; nutzen Sie Baselines als gemeinsame Sprache (z. B. CIS Controls).

- Implementieren Sie Observability als Pflicht: Service-Probes, Underlay-Qualitätsmetriken, Flow-Visibility, Time Sync; orientieren Sie sich an OpenTelemetry.

- Standardisieren und automatisieren Sie Changes: Templates, Source of Truth, CI/CD-Gates, Drift Prevention; nutzen Sie Guardrails via Policy-as-Code (z. B. OPA).

- Üben Sie Failure Scenarios regelmäßig: Link degrade/blackhole, WAN down, DNS/Identity-Ausfall, Segmentierungschecks; koppeln Sie Ergebnisse an Runbook- und Design-Updates.

- Verankern Sie ein Operating Model: Runbooks, RACI, OOB/Break-Glass, klare Eskalation und ITSM-Integration (z. B. ITIL), damit Edge im Incident beherrschbar bleibt.

- Steuern Sie Verbesserungen über SLOs und Fehlerbudgets, um Wartung und Innovation mit Stabilität zu balancieren (SRE Bücher).

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.