Ein Firewall Regelwerk skalieren ist eine der anspruchsvollsten Aufgaben im Network Security Engineering: Von 500 zu 50.000 Regeln zu wachsen, ohne Chaos zu erzeugen, erfordert mehr als zusätzliche Hardware oder „mehr Leute“. Ab einer bestimmten Größe kippt ein Regelwerk, wenn Struktur, Objektmodell, Governance und Automatisierung nicht mitwachsen. Dann entstehen typische Symptome: doppelte Regeln, Schattenregeln, unklare Ownership, zu breite Freigaben, endlose Ausnahmen und ein Change-Prozess, der entweder gefährlich schnell oder lähmend langsam ist. Wer das Hauptkeyword „Firewall Regelwerk skalieren“ ernsthaft umsetzt, denkt deshalb systemisch: Regeln werden nicht einzeln verwaltet, sondern als standardisierte Policy-Patterns; Objekte und Tags werden zur Quelle der Wahrheit; Reviews und Audit-Trails sind eingebaut; und Automatisierung ist kontrolliert statt blind. Dieser Artikel zeigt praxisnah, wie Sie Regelwerke in den fünfstelligen Bereich führen, ohne Sicherheitslücken, Betriebsrisiken und organisatorische Reibung zu verstärken – inklusive Architekturprinzipien, Datenmodellen, Change-Design und Messgrößen, die wirklich helfen.

Warum große Regelwerke scheitern: Skalierung ist ein Prozessproblem

Ein Firewall-Regelwerk wächst selten „sauber“. Es wächst durch Projekte, Migrationen, Notfälle, Lieferantenanforderungen, Cloud-Anbindungen und kurzfristige Ausnahmen. Solange das Regelwerk klein ist, kann ein erfahrener Engineer vieles mit Überblick kompensieren. Bei 50.000 Regeln funktioniert dieses „Heldentum“ nicht mehr. Die häufigsten Ursachen für Chaos sind:

- Fehlende Standards: Jede Regel sieht anders aus, Namen und Kommentare sind inkonsistent.

- Kein sauberes Objektmodell: IPs werden direkt in Regeln genutzt, Gruppen sind zu groß, Duplikate entstehen.

- Unklare Verantwortlichkeiten: Niemand kann sicher sagen, warum eine Regel existiert und wer sie benötigt.

- Keine Rezertifizierung: Regeln werden hinzugefügt, aber nicht systematisch entfernt oder verengt.

- Tool-/Domänen-Silos: On-Prem-Firewall, Cloud Security Groups, SASE/Proxy – alles getrennt, ohne gemeinsame Governance.

Skalierung bedeutet daher: Sie bauen ein Betriebssystem für Policies. Als strukturierender Rahmen für Schutz, Detektion und Reaktion kann das NIST Cybersecurity Framework dienen, weil es Security nicht als „Konfiguration“, sondern als kontinuierlichen Prozess begreift.

Grundprinzip: Von Regeln zu Modellen – Policy Engineering statt Rule Crafting

Im kleinen Maßstab „baut“ man Regeln. Im großen Maßstab „modelliert“ man Kommunikation. Der zentrale Wechsel ist: Sie definieren wiederverwendbare Patterns und lassen daraus Regeln entstehen. Das entkoppelt Fachanforderungen (wer muss mit wem sprechen?) von technischer Implementierung (welche Objekte, welche Reihenfolge, welche Plattform?).

- Rule Crafting: Einzelregel wird manuell entworfen, geprüft, eingespielt, dokumentiert.

- Policy Engineering: Standardpattern + Parameter (App, Env, Tier, Owner, Zone) → konsistente Regeln.

So reduzieren Sie nicht die Anzahl der Regeln, aber Sie reduzieren Variabilität und Fehlerwahrscheinlichkeit. Das ist der Kern, um 50.000 Regeln beherrschbar zu halten.

Architektur zuerst: Zonenmodell und Trust Boundaries als Skalierungsgerüst

Ein großes Regelwerk ohne Zonenmodell ist wie ein Städteplan ohne Straßennamen. Zonen und Trust Boundaries schaffen Ordnung und ermöglichen eine natürliche Gliederung der Policy in Segmente. Typische Zonenpfade, die als „Policy-Blöcke“ strukturiert werden:

- User → Internet: Webzugriff, idealerweise über Proxy/SASE; Ausnahmen streng kontrolliert.

- Internet → DMZ: Ingress, Reverse Proxy/WAF, restriktive Freigaben.

- DMZ → App: Nur definierte Dienste, keine „Durchreich“-DMZ.

- App → DB: Tiered Segmentation, minimaler Service-Scope.

- Admin → Management: Jump Hosts, MFA, striktes Logging.

- Partner → Intern: Dedizierte Partnerzonen, minimaler Zugriff, timeboxed.

Für Zero-Trust-nahe Designs hilft die NIST Zero Trust Architecture, weil sie Trust als kontextabhängig versteht und damit die Begründung für interne Trust Boundaries liefert.

Objektmodell skalieren: Ohne saubere Objekte ist 50.000 Regeln nicht auditierbar

In großen Rulebases entscheidet das Objektmodell über Wartbarkeit, Performance und Review-Fähigkeit. Ziel ist, Regeln möglichst selten an IPs zu binden, sondern an stabile Identitäten: Objekte, Gruppen, Tags, Labels. Mindeststandards:

- Adressobjekte statt IPs in Regeln: IPs nur im Notfall, danach sofort in Objekte überführen.

- Umgebungen trennen: DEV/TEST/PROD strikt getrennt, sonst wird jede Policy zu breit.

- Funktionale Gruppen: Gruppen nach App/Tier/Service, nicht nach „alles in VLAN X“.

- Duplikatkontrolle: Regelmäßige Erkennung und Konsolidierung identischer Objekte.

- Ownership als Metadatum: Owner-Tag ist Pflicht, sonst keine Dauerfreigabe.

Ab dieser Größe sind Tags nicht „nice to have“, sondern Voraussetzung: Sie ermöglichen Filter, Reports, Rezertifizierung und Automatisierung. Als praxisnahe Orientierung für saubere Konfiguration und kontrollierte Änderungen eignen sich die CIS Controls.

Tagging und Taxonomie: Die geheime Waffe gegen Policy-Sprawl

Tags machen Regeln maschinenlesbar und steuerbar. Eine gute Taxonomie ist klein, aber konsequent. Ein praxistaugliches Mindestset:

- Owner: Verantwortliches Team oder Service Owner

- App: Applikationsdomäne (z. B. CRM, ERP, Payments)

- Env: DEV / TST / PRD

- Zone: USER / DMZ / APP / DB / MGMT / CORE

- Criticality: High / Medium / Low

- ReviewDate oder Expiry: verpflichtender Review-/Ablaufzeitpunkt

- Exception: Kennzeichnung von Abweichungen, inklusive Ticket/Begründung

Mit dieser Taxonomie können Sie 50.000 Regeln nicht nur verwalten, sondern gezielt steuern: „Zeige alle Expired-Regeln“, „rezertifiziere alle Exception-Regeln“, „prüfe alle High-Criticality-Policies in der DMZ“.

Regelwerk strukturieren: Sections, Prioritäten und standardisierte Reihenfolge

Ein großes Regelwerk braucht eine klare, wiederholbare Struktur. Ziel ist, dass Teams sofort wissen, wo eine Regel hingehört und welche Reihenfolge gilt. Bewährte Prinzipien:

- Section-Design: Regelwerk nach Zonenpfaden (User→Internet, DMZ→App, App→DB, Admin→Mgmt) gliedern.

- „Deny-first“ selektiv: Explizite Blockregeln für bekannte No-Go-Pfade (z. B. User→DB direkt) können früh im Regelwerk stehen.

- Standard-Logging pro Section: Kritische Boundaries loggen immer; in weniger kritischen Bereichen selektiv.

- Catch-all vermeiden: „Any“-Regeln sind die Hauptquelle für Shadowing, Redundanz und spätere Audit-Probleme.

Skalierung bedeutet hier auch: Regeln werden nicht „oben eingefügt, weil es schneller ist“, sondern nach Struktur einsortiert. Das reduziert Shadowing und macht Reviews deutlich effizienter.

Policy-Patterns: Wie Sie tausende Regeln standardisiert erzeugen

Der sicherste Weg zu 50.000 Regeln ohne Chaos ist, dass die Regeln sich „gleich“ anfühlen: gleiche Felder, gleiche Namenslogik, gleiche Tags, gleiche Logging-Profile, gleiche Review-Pflichten. Dafür definieren Sie Patterns, die parametrisiert werden.

Beispiel-Pattern: Web/API → App

- Quelle: GRP-{App}-WEB-{Env}

- Ziel: GRP-{App}-APP-{Env}

- Service: definierte Ports oder App-ID

- Security-Profile: Mindestprofil pro Zone

- Tags: Owner, App, Env, Zone, Criticality, ReviewDate

Beispiel-Pattern: App → DB

- Quelle: GRP-{App}-APP-{Env}

- Ziel: GRP-{App}-DB-{Env}

- Service: DB-Port (z. B. 5432/1433/1521), keine „Service Any“

- Zusatz: Direkter Zugriff aus USER/DMZ ist explizit blockiert

Beispiel-Pattern: Admin → Management

- Quelle: GRP-ADMIN-MGMT

- Ziel: GRP-{Scope}-MGMT

- Service: SSH/RDP/WinRM/HTTPS nach Bedarf

- Logging: strikt, ggf. Session Recording außerhalb der Firewall

Der Pattern-Ansatz ist auch auditfreundlich: Auditoren prüfen nicht 50.000 Einzelentscheidungen, sondern ein kontrolliertes System aus standardisierten Vorlagen plus dokumentierten Ausnahmen.

Change-Prozess skalieren: Von „Ticket“ zu „Policy Supply Chain“

Mit wachsendem Regelwerk wächst die Anzahl der Changes. Wenn jeder Change ein individuelles Kunstwerk ist, wird der Betrieb unskalierbar. Ein skalierbarer Change-Prozess setzt auf Standardisierung und risikobasierte Klassen:

- Standard Changes: Vordefinierte Patterns, automatisierbar, schnelle Freigabe.

- Normal Changes: Individuelle Anforderungen, technische Prüfung, Freigabe durch Owner + Security.

- Emergency Changes: Sofortmaßnahmen, aber verpflichtender Post-Review und ggf. Rückbau.

Entscheidend sind Pflichtfelder: Zweck, Owner, Quelle, Ziel, Service, Richtung, Umgebung, Ablaufdatum/ReviewDate. Ohne diese Daten ist Rezertifizierung später kaum möglich.

Rezertifizierung und Reviews: Ohne Rückbau wächst jedes Regelwerk ins Unendliche

Bei 50.000 Regeln ist „wir räumen einmal im Jahr auf“ nicht ausreichend. Sie brauchen eine kontinuierliche Rezertifizierung, die nach Risiko priorisiert ist. Ein praktikabler Ansatz:

- Monatlich: Ausnahmen, neue Regeln, internetnahe Policies, Partnerzugänge, Admin-Pfade.

- Quartalsweise: High-Criticality-Zonenpfade (DMZ, Management, Core Services), große Objektgruppen.

- Halbjährlich/Jährlich: Baseline-Review, Zonenmodell, Pattern-Qualität, KPI-Review.

Die wichtigste technische Technik für sicheren Rückbau ist Quarantäne: Regeln erst deaktivieren oder in eine Quarantäne-Sektion verschieben, beobachten, dann endgültig löschen. Das reduziert Betriebsrisiko und erzeugt automatisch einen Audit-Trail.

Automatisierung richtig einsetzen: Guardrails statt „Auto-Deploy ins Risiko“

Automatisierung ist bei 50.000 Regeln unvermeidlich, aber sie muss kontrolliert sein. Gute Automatisierung folgt Guardrails:

- Validierungschecks vor Deploy: Keine any-any ohne Ausnahmeprozess, ReviewDate Pflicht, Owner Pflicht, Naming/Tagging korrekt.

- Staging/Canary: Neue Policies zunächst in monitor-only oder begrenztem Scope, bevor global enforced wird.

- Rollback-Automation: Jede Änderung braucht eine Rückfalloption (Konfigurationssnapshot, Versionsdiff).

- Change-Limits: Begrenzung, wie viele Regeln pro Zeitfenster automatisiert geändert werden dürfen.

Das Ziel ist nicht maximale Automation, sondern maximale Verlässlichkeit. In größeren Programmen wird dies oft über ein ISMS und klare Nachweisführung unterstützt, etwa angelehnt an ISO/IEC 27001.

Performance und Plattformgrenzen: Skalierung ist auch eine Kapazitätsfrage

Ein großes Regelwerk stellt nicht nur organisatorische, sondern auch technische Anforderungen. Je nach Plattform sind Limits relevant: maximale Rulebase-Größe, Objektanzahl, Sessionrate, Logging-Durchsatz, Update-/Commit-Zeiten. Ohne produktbezogene Zahlen zu nennen, sind die typischen Engpässe:

- Commit/Publish-Zeiten: Je größer die Policy, desto wichtiger sind inkrementelle Changes und Wartungsfenster.

- Lookup-Performance: Objekte und Gruppen müssen effizient modelliert sein; Mega-Gruppen können Performance und Verständlichkeit ruinieren.

- Logging-Volumen: Mehr Regeln und mehr Segmentierung erzeugen mehr Events; SIEM-Ingestion und Retention müssen mitwachsen.

- HA/Failover: Große State-Tabellen, Synchronisation und Upgrade-Prozesse werden kritischer.

Ein skalierbares Design plant daher Kapazität zusammen mit Governance: welche Bereiche loggen immer, welche selektiv, welche in Sampling, und wie werden Log-Pipelines überwacht (Drops, Lag, Parser-Fehler).

Observability und Messbarkeit: KPIs, die bei großen Rulebases wirklich helfen

Bei 50.000 Regeln brauchen Sie Kennzahlen, die Steuerungswirkung haben. Gute KPIs sind nicht „mehr Daten“, sondern bessere Entscheidungen. Bewährte Messgrößen:

- Owner Coverage: Anteil Regeln/Objekte mit Owner-Tag.

- Review Compliance: Anteil Regeln/Exceptions, die fristgerecht rezertifiziert wurden.

- Exception Rate: Anteil Ausnahmen und deren durchschnittliche Laufzeit (Timeboxing-Qualität).

- Any-Rate: Anteil „any service“ oder „any destination“ in kritischen Zonen.

- Unused Rules: Anzahl Regeln ohne Hits im definierten Zeitraum (mit Quarantäne-Backlog).

- Change Failure Rate: Anteil Changes, die zurückgerollt werden mussten oder Incidents auslösten.

Für jede KPI sollte es eine konkrete Maßnahme geben, wenn Grenzwerte überschritten werden. Nur so wird das KPI-Set zum Steuerungsinstrument statt zum Reporting.

Audit-Trails: Nachweisbarkeit als Nebenprodukt guter Prozesse

Mit zunehmender Regelanzahl wird Auditierbarkeit wichtiger, nicht unwichtiger. Ein skalierbares System beantwortet jederzeit: Was wurde wann warum geändert, von wem genehmigt, wie getestet, wie lange gültig? Dazu brauchen Sie konsistente Evidence-Artefakte:

- Ticket/Change-ID: Verknüpft Business-Zweck, Owner, Risiko, Freigaben.

- Konfigurationssnapshot: Vorher/Nachher oder versionsicherer Diff.

- Implementierungsnachweis: Wer hat deployed, wann, mit welchem Job/Commit.

- Validierungsnachweis: Connectivity-/Policy-Test, Logbeispiel, Monitoring-Check.

- Rezertifizierungsprotokoll: Behalten, verengen, entfernen, neues ReviewDate.

Wichtig ist die Zentralisierung: Audit-Trails dürfen nicht in E-Mail-Threads verschwinden, sondern müssen in einem Ticket-/Change-System und einer Versionierung/Export-Strategie zusammenlaufen.

Typische Anti-Patterns bei großen Rulebases

- „Catch-all unten“: Eine breite Allow-Regel als Sicherheitsnetz bleibt ewig und macht Segmentierung wirkungslos.

- Copy-&-Paste ohne Standard: Regeln duplizieren sich, Unterschiede sind zufällig, Reviews werden unmöglich.

- Kein Ablaufdatum: Temporäre Regeln werden dauerhaft, Ausnahmequoten steigen stetig.

- Objekt-Müllhalden: Gruppen werden zu groß, Duplikate und verwaiste Objekte explodieren.

- Automatisierung ohne Guardrails: Schnelle Deploys, aber kein Review, keine Validierung, kein Rollback.

Praxis-Blueprint: Schrittfolge von 500 zu 50.000 Regeln

- 1) Zonenmodell und Policy-Sections definieren: Regelwerk in klare Pfade gliedern, Default-Deny an Trust Boundaries.

- 2) Objektmodell standardisieren: Naming, Gruppenprinzipien, Dev/Test/Prod-Trennung, Duplikatkontrolle.

- 3) Tag-Taxonomie einführen: Owner, App, Env, Zone, Criticality, ReviewDate, Exception.

- 4) Policy-Patterns bauen: Standardpfade als Templates, inkl. Logging- und Security-Profilen.

- 5) Change-Klassen etablieren: Standard/Normal/Emergency mit klaren Pflichtfeldern und Post-Review.

- 6) Rezertifizierung aufsetzen: Risiko-basiert, mit Quarantäne-Prozess für Rückbau.

- 7) Automatisierung mit Guardrails: Pre-Checks, Staging, Rollback, Change-Limits.

- 8) KPIs und Telemetrie stabilisieren: Owner Coverage, Review Compliance, Any-Rate, Unused Rules, Log-Health.

- 9) Hybrid-Konsistenz herstellen: On-Prem, Cloud und SASE mit gleicher Taxonomie und Evidence-Logik.

Outbound-Quellen für Standards und Rahmenwerke

- NIST Cybersecurity Framework für die Einordnung von Schutz, Erkennung und Reaktion als Prozess.

- NIST Zero Trust Architecture für Trust Boundaries und verteiltes Policy-Enforcement.

- CIS Controls für praxisnahe Mindestkontrollen rund um Konfiguration, Governance und Monitoring.

- ISO/IEC 27001 Überblick für auditierbare Prozesse, Verantwortlichkeiten und kontinuierliche Verbesserung.

- MITRE ATT&CK zur Strukturierung von Bedrohungen und zur Ableitung von Detektionen für East-West-Risiken.

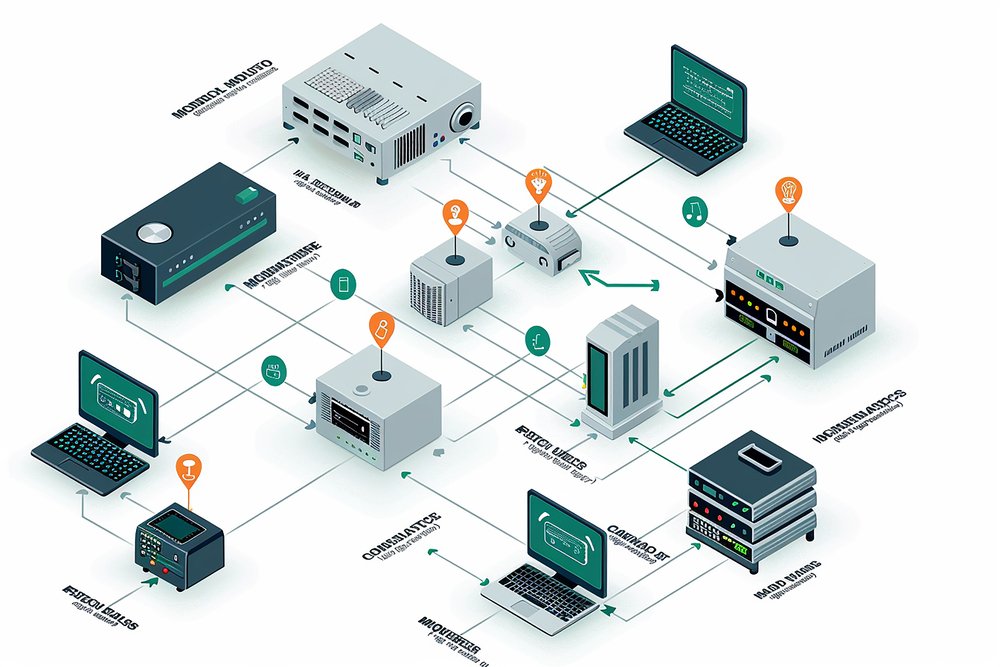

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.