Interaktive Handschuhe: Gestensteuerung für Musik oder Licht gehören zu den spannendsten DIY- und Prototyping-Projekten im Bereich Wearables. Sie verbinden Elektronik, Sensorik, Signalverarbeitung und kreatives Interface-Design in einem einzigen, direkt erfahrbaren System. Statt Knöpfe zu drücken oder Menüs zu bedienen, steuerst du Funktionen über natürliche Handbewegungen – etwa für Live-Musik, Bühnenlicht, Medienkunst, Performance oder smarte Installationen. Genau deshalb sind interaktive Handschuhe sowohl für Einsteiger als auch für fortgeschrittene Maker interessant: Das Projekt ist modular, schnell testbar und lässt sich von einer einfachen Demo bis zur robusten Echtzeitsteuerung ausbauen. Gleichzeitig ist die Herausforderung größer, als sie zunächst wirkt. Hände bewegen sich schnell, ungleichmäßig und in wechselnden Positionen; dazu kommen Störeinflüsse durch Vibration, Schweiß, Funklatenz und mechanische Belastung am Textil. Wenn du ein zuverlässiges Ergebnis willst, brauchst du eine saubere Systemarchitektur aus Sensorwahl, Kalibrierung, Gestenerkennung, Sicherheitslogik und ergonomischem Aufbau. In diesem Leitfaden lernst du Schritt für Schritt, wie du Gestensteuerung für Musik oder Licht praxisnah umsetzt – mit stabiler Technik, klarem Mapping und alltagstauglicher Tragequalität.

Was interaktive Handschuhe in der Praxis leisten sollen

Bevor du Hardware auswählst, definiere den Einsatzzweck. Ein Show-Glove für die Bühne braucht andere Prioritäten als ein Workshop-Projekt oder eine Studio-Controller-Lösung.

- Kurze Reaktionszeit bei Gesten (niedrige wahrgenommene Latenz)

- Hohe Erkennungsstabilität trotz variierender Bewegung

- Ergonomisches Tragegefühl über längere Sessions

- Verlässliche Funk- oder Kabelkommunikation

- Sichere Failover-Logik bei Verbindungsabbrüchen

Ein gutes Zielbild lautet: lieber wenige Gesten mit hoher Zuverlässigkeit als viele Gesten mit häufigen Fehltriggern.

Typische Anwendungsfälle: Musiksteuerung und Lichtsteuerung

Interaktive Handschuhe können unterschiedliche Rollen übernehmen. Die Systemgestaltung hängt stark davon ab, ob du kontinuierliche Parameter oder diskrete Trigger senden möchtest.

Musiksteuerung

- Filterfahrten, Lautstärke, Effektintensität über Handneigung

- Sample-Trigger durch Fingertipp oder Faustgeste

- Tempo-nahe Aktionen mit klarer Entprelllogik

Lichtsteuerung

- Farbwechsel durch Gestenrichtung

- Dimmerwerte über kontinuierliche Handhaltung

- Szenenwechsel per definierter Aktivierungsgeste

Für Live-Umgebungen ist ein zweistufiges Bedienkonzept sinnvoll: „Armierung“ (bewusst aktivieren) und dann „Steuern“ (Parameter ändern).

Systemarchitektur: vom Handschuh zur Steuerzentrale

Ein belastbares Setup besteht aus fünf Kernschichten: Sensorik, Mikrocontroller, Erkennungslogik, Kommunikationsprotokoll und Zielsystem (DAW, Lichtsoftware, Controller-Hub).

- Sensorik: IMU, Biegesensoren, Druck-/Touchpunkte

- Controller: Verarbeitung, Filterung, Gestenklassifikation

- Mapping: Geste zu MIDI/OSC/DMX-Parameter

- Kommunikation: BLE, WLAN, seriell oder Funkdongle

- Output: Audio- oder Lichtsoftware mit Szenenlogik

Je klarer diese Schichten getrennt sind, desto leichter lassen sich Fehler diagnostizieren und Features erweitern.

Sensorik auswählen: welche Daten du wirklich brauchst

Nicht jeder Handschuh braucht Vollausstattung. Wähle Sensoren nach Steuerziel und nicht nach maximaler Featureliste.

IMU-Sensoren (Beschleunigung + Gyro)

- Ideal für Orientierung, Neigung, dynamische Bewegungen

- Gut für kontinuierliche Parametersteuerung

- Benötigen Filterung gegen Drift und Rauschen

Biegesensoren an Fingern

- Geeignet für Fingerhaltungen und diskrete Gesten

- Intuitiv für Trigger und Moduswechsel

- Mechanisch empfindlicher bei starker Knickbelastung

Kapazitive oder druckbasierte Touchpunkte

- Saubere Auslösung für „Klick“-ähnliche Aktionen

- Hilfreich als Armierungs- oder Sicherheitsfunktion

Für Einsteiger reicht oft eine IMU plus ein bis zwei Touchpunkte, um ein sehr brauchbares Steuerkonzept aufzubauen.

Ergonomie und textile Integration

Ein interaktiver Handschuh muss Bewegungsfreiheit erhalten. Komponenten dürfen weder die Fingerbeugung einschränken noch Druckstellen verursachen.

- Leichte, elastische Handschuhbasis mit stabilem Sitz

- Elektronik auf Handrücken statt in Greifzonen platzieren

- Leitungsführung entlang natürlicher Bewegungsachsen

- Zugentlastung an allen Übergängen zu Fingern

- Abnehmbares Modul für Pflege und Service

Mechanische Qualität ist entscheidend: Viele Erkennungsprobleme sind in Wahrheit Integrationsprobleme.

Signalverarbeitung: Rohdaten in stabile Steuerdaten verwandeln

Rohwerte aus IMU und Biegesensoren schwanken. Ohne Filterung und Normalisierung wird die Steuerung hektisch oder unpräzise.

Typische Verarbeitungsschritte

- Abtastung mit konstanter Frequenz

- Tiefpassfilter für ruhige Parameterverläufe

- Offset-Korrektur und Kalibrierung pro Nutzer

- Schwellwertlogik mit Hysterese für Trigger

- Zeitfensterbasierte Erkennung für komplexe Gesten

Ein einfacher gleitender Mittelwert kann als Startpunkt dienen:

Damit werden Messspitzen geglättet, was bei Musik- und Lichtsteuerung sofort zu mehr Stabilität führt.

Gestenerkennung sinnvoll aufbauen

Die beste Erkennung entsteht nicht durch maximale Komplexität, sondern durch klare Gestendefinitionen. Jede Geste sollte eindeutig, reproduzierbar und körperlich angenehm sein.

- Maximal 5 bis 8 Kern-Gesten für den Anfang

- Unterscheide zwischen kontinuierlichen und diskreten Gesten

- Vermeide zu ähnliche Bewegungsmuster

- Lege Dead-Zones fest, um unbeabsichtigte Auslösung zu verhindern

- Nutze Bestätigungsgesten für kritische Aktionen

Für Live-Setups ist „robust vor clever“ die wichtigste Regel.

Mapping: Gesten auf MIDI, OSC oder Lichtprotokolle

Ein gutes Mapping entscheidet über Spielbarkeit und Ausdruck. Technisch korrekte Daten nützen wenig, wenn das Interface musikalisch oder visuell nicht intuitiv ist.

Für Musik

- Neigungswinkel auf Filter-Cutoff oder Reverb-Mix

- Fingertipp auf Sample-Trigger oder Mute

- Drehgeste auf Effekt-Intensität

Für Licht

- Handhöhe auf Dimmerwert

- Rotation auf Farbton

- Faust-/Open-Hand auf Szenenwechsel

Linearer Wertebereich als Basis-Mapping:

Mit Kurven (exponentiell/logarithmisch) kannst du das Spielgefühl später fein abstimmen.

Latenz und Stabilität in Echtzeit-Setups

Bei Performance-Projekten zählt die wahrgenommene Reaktionszeit. Neben Funkprotokoll und Software spielen auch Filtertiefe und Paketstrategie eine Rolle.

- Abtastrate und Paketintervall auf Anwendung abstimmen

- Nur relevante Daten senden, nicht jeden Rohwert

- Heartbeat-Mechanismus für Verbindungsüberwachung

- Fallback-Status bei Signalverlust definieren

Ein stabiles System mit minimal höherer Latenz wirkt oft besser als ein schnelles, aber instabiles Setup.

Energieversorgung für interaktive Handschuhe

Gewicht und Laufzeit müssen balanciert werden. Zu großer Akku stört die Ergonomie, zu kleiner Akku reduziert die Praxistauglichkeit.

- Leichte Akkulösung mit Schutzschaltung

- Positionierung nahe Handgelenk oder Unterarmmodul

- Klare Lade- und Wechselroutine für Sessions

- Energiesparmodi bei Inaktivität nutzen

Die Laufzeit kann näherungsweise so abgeschätzt werden:

Mit optimierter Firmware sinkt

Sicherheits- und Zuverlässigkeitsregeln

Gerade auf Bühne oder im öffentlichen Raum muss das System fehlertolerant sein. Unerwartete Zustände sollten kontrolliert abgefangen werden.

- Fail-Safe-Zustand bei Verbindungsabbruch

- Debounce- und Anti-Trigger-Logik für Touch/Gesten

- Mechanisch geschützte Kontaktstellen

- Schnelle manuelle Deaktivierung vorsehen

So verhinderst du ungewollte Lichtwechsel oder Audio-Spitzen im Live-Betrieb.

Schritt-für-Schritt-Projektablauf

1) Use-Case und Gestenset definieren

- Drei bis fünf Hauptfunktionen festlegen

- Eindeutige Gesten ohne Überschneidung auswählen

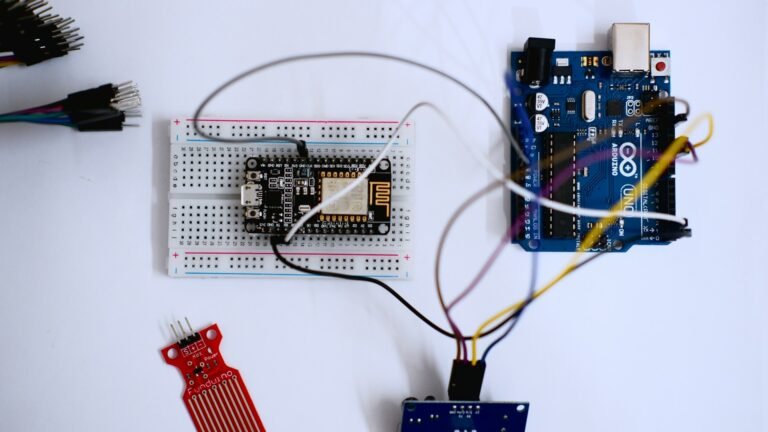

2) Hardware-Prototyp aufbauen

- Sensorik und Controller zunächst extern testen

- Baseline-Daten erfassen

3) Handschuhintegration

- Leitungen fixieren, Zug entlasten, Bewegungszonen testen

- Modulzugang für Service sicherstellen

4) Kalibrierung und Filterung

- Ruhe- und Bewegungsprofile pro Nutzer erfassen

- Thresholds und Hysterese anpassen

5) Mapping und Live-Test

- MIDI/OSC/DMX-Zuordnung optimieren

- Mehrere Sessions mit realer Nutzung simulieren

Typische Fehler und schnelle Lösungen

- Fehltrigger: Schwellenwerte erhöhen, Armierungsgeste einführen, Hysterese vergrößern.

- Zittrige Werte: Filterfenster anpassen, mechanische Fixierung verbessern, Sensorlage prüfen.

- Aussetzer im Funk: Paketlast reduzieren, Intervall anpassen, Antennenposition optimieren.

- Unbequemer Sitz: Modulposition versetzen, Gewicht umverteilen, Handschuhmaterial ändern.

- Kurze Laufzeit: Sleep-Modi nutzen, Sendehäufigkeit reduzieren, LED-Feedback minimieren.

Ein Diagnoseprotokoll pro Testsession hilft, technische und ergonomische Ursachen sauber zu trennen.

Ausbauideen für Mittelstufe und Profis

- Bimanuale Steuerung mit zwei Handschuhen

- Kontextabhängige Gestenmodi (Studio, Bühne, Probe)

- Adaptive Filterparameter je nach Bewegungsklasse

- Haptisches Feedback zur Bestätigung von Triggern

- Preset-System mit schnellem Szenenwechsel

So entwickelst du aus einem DIY-Projekt ein performantes Human-Interface für kreative Echtzeitanwendungen.

Nützliche Ressourcen für Umsetzung und Vertiefung

- Arduino Dokumentation für Mikrocontroller- und Sensorintegration

- SparkFun Learn: Wearables, IMU-Grundlagen und Prototyping

- Adafruit Learning System: Interaktive Wearables und MIDI/OSC-Praxis

- W3C MathML-Spezifikation für HTML-kompatible Formeldarstellung

- Kobakant: E-Textiles Material- und Verarbeitungstechniken

Interaktive Handschuhe mit Gestensteuerung für Musik oder Licht funktionieren dann überzeugend, wenn Technik, Ergonomie und künstlerisches Mapping als ein gemeinsames System entwickelt werden. Mit klarer Sensorstrategie, robuster Signalverarbeitung, durchdachtem Live-Workflow und wartungsfreundlicher Integration entsteht ein Wearable-Controller, der nicht nur beeindruckt, sondern in realen Performances verlässlich arbeitet.

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.