Ein Raspberry Pi AI Kit Test beantwortet eine sehr praktische Frage: Bringt ein KI-Beschleuniger auf dem Raspberry Pi wirklich spürbare Vorteile – oder bleibt es bei schönen Diagrammen? Gerade beim Raspberry Pi 5 ist der Wunsch groß, Computer-Vision und Edge-AI lokal auszuführen, ohne Daten in die Cloud zu schicken. Genau hier setzt das Raspberry Pi AI Kit an: Es kombiniert den Raspberry Pi 5 mit einem Hailo-basierten NPU-Modul (Neural Processing Unit), das für typische Inferenzaufgaben wie Objekterkennung, Segmentierung oder Pose Estimation optimiert ist. In der Praxis geht es weniger um „Künstliche Intelligenz um jeden Preis“, sondern um konkrete Projekte: eine smarte Kamera, ein lokaler Sicherheitsdienst, Zähl- und Erkennungsfunktionen in der Werkstatt, oder die Automation im Smart Home. Dieser Artikel führt strukturiert durch Hardware, Einrichtung, typische Workloads, Messkriterien (FPS, Latenz, CPU-Last) sowie Grenzen – damit Sie nach dem Lesen klar einschätzen können, ob sich das AI Kit für Ihr Vorhaben lohnt.

Was ist das Raspberry Pi AI Kit und wie unterscheidet es sich von „AI HAT+“?

Der Begriff „AI Kit“ wird im Raspberry-Pi-Umfeld häufig für ein Bundle aus Raspberry Pi 5 und einem passenden KI-Add-on genutzt. Technisch basiert es auf der Plattform rund um das Raspberry Pi AI HAT+, einem Aufsteckmodul mit integriertem Hailo-AI-Beschleuniger. Der entscheidende Punkt: Die NPU übernimmt rechenintensive Inferenzläufe, während CPU und GPU des Pi sich um Betriebssystem, I/O und Applikationslogik kümmern. Laut offiziellem Produktbrief ist das AI HAT+ in Varianten mit 13 TOPS (Hailo-8L) und 26 TOPS (Hailo-8) verfügbar und kommuniziert über die PCIe-Gen3-Schnittstelle des Raspberry Pi 5. Außerdem erkennt ein aktuelles Raspberry Pi OS den Beschleuniger automatisch und stellt ihn für KI-Aufgaben bereit; die Kamera-Tools (rpicam-apps) können kompatible Post-Processing-Schritte nativ über die NPU ausführen. Für Details eignet sich der offizielle Produktbrief zum Raspberry Pi AI HAT+ als primäre Referenz.

Für wen lohnt sich ein AI Kit?

Ein KI-Beschleuniger ist kein „Mehr Leistung“-Schalter für alles. Er lohnt sich vor allem dann, wenn Sie regelmäßig neuronale Netze ausführen möchten und dabei Wert auf geringe CPU-Last, stabile Latenzen und lokale Verarbeitung legen. Typische Zielgruppen:

- Einsteiger, die ein funktionierendes Setup für Objekt- oder Personenerkennung suchen, ohne in komplexe GPU-Stacks einzutauchen.

- Mittelstufe, die bereits Docker, MQTT, Home Assistant oder NVR-Systeme nutzen und Inferenz lokal beschleunigen wollen.

- Profis, die reproduzierbare Edge-AI-Pipelines (z. B. in Prototyping, Labor, Industrie) benötigen und Ressourcen sauber trennen möchten.

Weniger sinnvoll ist das AI Kit, wenn Ihr Projekt primär CPU-lastig ist (Datenbanken, Kompilieren, klassische Serverdienste) oder wenn Sie nur gelegentlich ein Modell testen. Dann reichen CPU/GPU oft aus – oder ein externer Rechner erledigt die Inferenz schneller.

Hardware-Basics: Voraussetzungen und typische Komponenten

Für ein stabiles Setup sollten Sie das AI Kit nicht isoliert betrachten. Entscheidend ist das Zusammenspiel aus Stromversorgung, Kühlung, Storage und Kamera- bzw. Sensoranbindung. Bewährt hat sich:

- Raspberry Pi 5 (mindestens 4 GB RAM, besser 8 GB bei Docker-Stacks und mehreren Services).

- Stabiles Netzteil mit ausreichender Reserve, besonders wenn zusätzlich SSDs, Kameras oder USB-Geräte betrieben werden.

- Aktive Kühlung (Lüfter/Heatsink), da dauerhafte Inferenz zu konstanten Lastprofilen führt – auch wenn die NPU die CPU entlastet.

- Schneller Massenspeicher (SSD statt microSD), wenn große Modelle, Videostreams oder Container-Images genutzt werden.

- Kamera (z. B. offizielles Kamera-Modul) oder RTSP/IP-Kameras, je nach Anwendungsfall.

Planen Sie außerdem Platz im Gehäuse ein: Aufsteckmodule benötigen Höhe, und sauberes Kabelmanagement zahlt sich später in Betriebssicherheit aus.

Einrichtung: Von Raspberry Pi OS bis NPU-Treiber

Die saubere Basis ist ein aktuelles Raspberry Pi OS (Bookworm) mit allen Updates. Bei KI-Add-ons ist Aktualität besonders wichtig, weil Kernel-Module, PCIe-Treiber und User-Space-Bibliotheken zusammenspielen. Sinnvolle Reihenfolge:

- Raspberry Pi OS installieren und vollständig aktualisieren.

- Firmware/Bootloader des Raspberry Pi 5 aktuell halten.

- AI-Hardware montieren und auf festen Sitz achten (keine mechanische Spannung, keine wackeligen Standoffs).

- Nach dem Boot prüfen, ob das Gerät erkannt wird (PCIe-Device-Listing, Kernel-Logs).

Für offizielle, laufend gepflegte Einstiegspunkte empfiehlt sich ein Blick in die Raspberry-Pi-Dokumentation und Produktseiten, etwa auf Raspberry Pi AI HAT+ (Produktübersicht) sowie die Herstellerinformationen zum Accelerator-Ökosystem von Hailo.

Wie Sie einen praxisnahen „Test“ durchführen: Kriterien statt Bauchgefühl

Ein Raspberry Pi AI Kit Test ist dann belastbar, wenn Sie nachvollziehbare Messgrößen definieren. In der Praxis haben sich diese Kennzahlen bewährt:

- FPS (Frames per Second): Wie viele Bilder pro Sekunde werden mit Ihrem Modell tatsächlich verarbeitet?

- End-to-End-Latenz: Wie lange dauert es vom Kameraframe bis zum Ergebnis (Bounding Boxes, Labels, Segmentation Mask)?

- CPU-Last: Sinkt die CPU-Auslastung deutlich, wenn die NPU die Inferenz übernimmt?

- Stabilität: Läuft die Pipeline über Stunden/Tage ohne Speicherlecks, Drops oder Treiberprobleme?

- Strom und Temperatur: Bleibt das System im Dauerbetrieb thermisch stabil, ohne Takt-Drosselung?

Wenn Sie Stromkosten grob abschätzen möchten, reicht eine einfache Rechnung: Leistung in Kilowatt mal Betriebszeit in Stunden. In MathML sieht das so aus:

Damit können Sie realistisch vergleichen, ob ein 24/7-Dienst auf dem Pi für Ihr Budget passt.

Typische Workloads: Wo die NPU wirklich hilft

Der größte Mehrwert entsteht bei visuellen KI-Aufgaben, bei denen die CPU allein schnell an Grenzen stößt. Der offizielle Produktbrief nennt als Beispiele Objekterkennung sowie semantische und instanzbasierte Segmentierung und Pose Estimation. In der Praxis sind das die häufigsten Szenarien:

Objekterkennung für Kamera- und Sicherheitsprojekte

Bei der Objekterkennung geht es um Bounding Boxes und Klassen (z. B. Person, Fahrzeug, Tier). Der Vorteil einer NPU zeigt sich, wenn Sie mehrere Streams oder höhere Auflösungen nutzen möchten, ohne dass die CPU dauerhaft auf 100% läuft. Typisch ist auch der Wunsch nach „lokal statt Cloud“ – besonders bei privaten Kameras. Als NVR-Umfeld wird oft Frigate diskutiert, das je nach Hardware-Setup unterschiedliche Beschleuniger nutzen kann.

Segmentierung für präzisere Entscheidungen

Segmentierung liefert Pixelmasken statt grober Boxen. Das ist nützlich, wenn Sie Flächen genauer bestimmen möchten (z. B. „Ist dieser Bereich belegt?“) oder wenn Objekte sich überlappen. Segmentierung ist rechenintensiver als einfache Erkennung – ein gutes Feld, um den Nutzen eines Beschleunigers zu prüfen.

Pose Estimation für Interaktion und Robotik

Pose Estimation erkennt Körper- oder Gelenkpunkte. Das ist spannend für Interaktion (Gesten), Sportanalyse oder Robotik. Auf dem Raspberry Pi ist es ohne Beschleuniger häufig möglich, aber nicht in stabilen Echtzeit-Setups. Genau hier ist ein AI Kit besonders interessant.

Kamera-Integration und „rpicam-apps“: Der unterschätzte Vorteil

Viele Anwender starten mit einer offiziellen Pi-Kamera. Wichtig ist dabei weniger die Kamera selbst, sondern die Pipeline: Aufnahme, Preprocessing, Inferenz, Postprocessing, Ausgabe. Wenn Teile davon nativ unterstützt werden, sinkt die Komplexität erheblich. Laut Produktbrief kann der Pi bei aktueller Software den Accelerator automatisch bereitstellen, und die Kamera-Tools unterstützen das AI-Modul für kompatible Post-Processing-Aufgaben. Das ist besonders relevant, wenn Sie ein schlankes, „appliance-artiges“ System bauen möchten, das ohne große Bastelarbeit stabil läuft.

Performance-Realität: Warum TOPS nicht automatisch „schnell“ heißt

TOPS (Tera Operations per Second) ist eine grobe Kennzahl für Rechenleistung, aber kein Garant für Ihre konkrete Anwendung. Entscheidend sind:

- Modellarchitektur: Ein leichtes Modell (z. B. mobile-optimiert) skaliert oft besser als ein sehr großes Netzwerk.

- Eingangsauflösung: Höhere Auflösung erhöht Rechenaufwand und Speicherbandbreite.

- Pre-/Postprocessing: Wenn diese Schritte CPU-lastig bleiben, limitiert weiterhin die CPU.

- I/O und Speicher: Videodecoding, Netzwerkstreams und Speicherzugriffe können zum Engpass werden.

Ein sinnvoller Test setzt daher auf reale Szenarien: den echten Kamerastream, Ihre Zielauflösung und ein Modell, das Sie auch produktiv verwenden möchten. Nur so sehen Sie, ob der Engpass tatsächlich die Inferenz war – oder ob Decoding, Container-Overhead oder Netzwerkprobleme die eigentliche Bremse sind.

Stromverbrauch, Wärme und Dauerbetrieb

Ein AI Kit ist prädestiniert für 24/7-Dienste. Damit steigen aber auch die Anforderungen an Thermik und Versorgung. Ein sauber gekühlter Raspberry Pi 5 arbeitet stabiler und vermeidet Takt-Drosselungen, die Leistungsschwankungen verursachen. Im Testbetrieb sollten Sie deshalb nicht nur „kurz FPS messen“, sondern mindestens ein längeres Laufzeitfenster einplanen (mehrere Stunden), um folgende Fragen zu klären:

- Bleibt die CPU-Temperatur im grünen Bereich, auch bei dauerhaften KI-Tasks?

- Gibt es Spannungseinbrüche, wenn zusätzliche USB-Geräte aktiv sind?

- Verhält sich das System stabil nach Reboots und Updates?

Gerade bei Kameraprojekten ist Stabilität häufig wichtiger als ein theoretisch maximaler Durchsatz.

Software-Ökosystem: Docker, Home Assistant und typische Integrationen

In vielen Haushalten und Maker-Setups läuft die Smart-Home-Logik in Containern oder über Home Assistant. Ein AI Kit ist dabei meist nicht „die App“, sondern ein Baustein: Inferenz als Dienst, Events über MQTT, Automationen über Home Assistant. Wer tiefer in Home Assistant einsteigen möchte, findet den offiziellen Einstieg unter Home Assistant; für Messaging/IoT ist Eclipse Mosquitto ein etablierter MQTT-Broker. Wichtig ist, die Ressourcenplanung ernst zu nehmen: KI-Dienste, Datenbanken, Logs und Dashboards konkurrieren sonst um CPU, RAM und Storage – auch wenn die Inferenz selbst auf der NPU läuft.

Alternativen und Vergleich: Wann andere Beschleuniger besser passen

Ein Raspberry Pi AI Kit ist nicht die einzige Option. Je nach Projekt können Alternativen sinnvoll sein:

- Google Coral TPU: In vielen Computer-Vision-Projekten verbreitet, aber Verfügbarkeit und Software-Support hängen stark vom konkreten Setup ab. Einstieg: Coral AI.

- CPU-only: Für leichte Modelle, geringe FPS-Anforderungen oder sporadische Analysen oft ausreichend.

- Stärkeres SBC oder Mini-PC: Wenn Sie mehrere Streams, schwere Modelle oder zusätzliche Services betreiben, kann ein x86-System wirtschaftlicher sein.

Das AI Kit spielt seine Stärken aus, wenn Sie lokal, leise und stromsparend arbeiten möchten und dabei eine klar definierte Inferenzaufgabe haben.

Typische Stolpersteine und wie Sie sie vermeiden

- Unrealistische Erwartungen: TOPS-Werte sind nicht gleichbedeutend mit „läuft jedes Modell in Echtzeit“.

- Flaschenhals im Decoding: RTSP-Streams und Videodecoding können limitieren, bevor die Inferenz überhaupt startet.

- Wackelige Stromversorgung: Unter Last treten Instabilitäten häufig zuerst bei Netzteilen oder langen USB-Kabeln auf.

- Thermik unterschätzt: Ohne Kühlung sinkt die Taktfrequenz; Messwerte werden unzuverlässig.

- Zu viele Services parallel: Container-Orchestrierung, Datenbanken und Dashboards benötigen ebenfalls Ressourcen.

Kauf- und Praxischeck: Welche Fragen Sie vor dem Kauf beantworten sollten

Bevor Sie Geld in ein Raspberry Pi AI Kit investieren, lohnt eine kurze Projektprüfung:

- Welche konkrete Aufgabe soll beschleunigt werden (Objekterkennung, Segmentierung, Pose)?

- Wie viele Streams oder Sensoren laufen gleichzeitig?

- Wie wichtig sind Datenschutz und lokale Verarbeitung gegenüber Cloud-Diensten?

- Soll das System 24/7 laufen – und ist Kühlung/USV/SSD eingeplant?

- Ist Ihr Modell-Stack kompatibel und langfristig wartbar?

Wenn Sie diese Punkte sauber beantworten können, wird ein AI Kit planbar: Sie testen nicht „KI auf dem Pi“, sondern eine konkrete Edge-AI-Lösung mit messbaren Ergebnissen. Und genau dann ist der Raspberry Pi als KI-Plattform in der Praxis am stärksten.

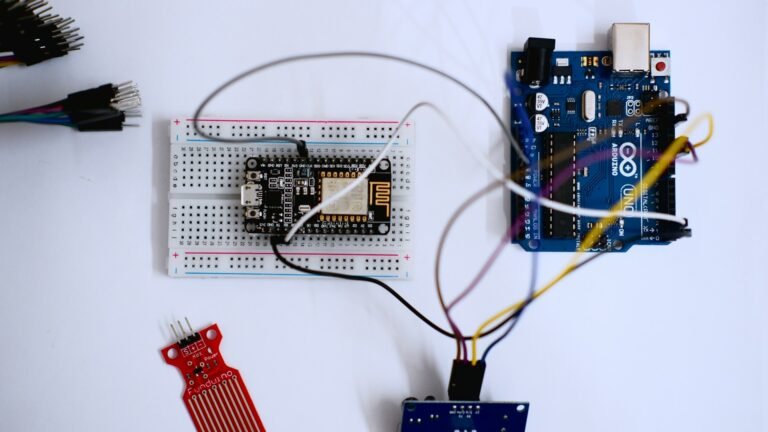

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.