Wer Künstliche Intelligenz (TinyML) auf dem ESP32 S3: Spracherkennung lokal umsetzen möchte, sucht meist nach einer Lösung, die ohne Cloud auskommt: keine Audio-Uploads, keine laufenden Serverkosten und trotzdem eine schnelle Reaktion auf Sprachbefehle. Genau dafür ist der ESP32-S3 besonders interessant. Er kombiniert WLAN/Bluetooth für optionale Konnektivität mit einer Mikrocontroller-Architektur, die explizit auf Signalverarbeitung und neuronale Netze optimiert werden kann – unter anderem durch zusätzliche Vektor-Instruktionen, die typische DSP- und NN-Operationen beschleunigen. Das macht ihn zu einer beliebten Plattform für „Wake Word“-Erkennung (z. B. ein Aktivierungswort) und kleine Befehlssets („Licht an“, „Stopp“, „Leiser“) direkt auf dem Gerät. Dieser Artikel zeigt praxisnah, wie lokale Spracherkennung auf dem ESP32-S3 in TinyML-Projekten funktioniert: von der Audio-Erfassung über Vorverarbeitung (Spektrogramm/MFCC) und Modellwahl bis zur Integration in Firmware und zur robusten Inbetriebnahme. Dabei geht es nicht um Marketing-Versprechen, sondern um eine saubere, umsetzbare Vorgehensweise – inklusive typischer Stolpersteine rund um Mikrofon, I2S, Speicher und Latenz.

Warum lokale Spracherkennung nachhaltiger, schneller und datenschutzfreundlicher ist

Lokale Spracherkennung („on-device“) bedeutet, dass Audio auf dem ESP32-S3 verarbeitet wird, ohne dass Rohdaten in eine Cloud gesendet werden müssen. Das hat mehrere Vorteile: kurze Reaktionszeiten, geringere Abhängigkeit vom Internet und mehr Datenschutz, weil sensible Sprachdaten das Gerät nicht verlassen. Gleichzeitig lassen sich Systeme stabiler betreiben, weil ein kurzer WLAN-Ausfall keine Grundfunktion blockiert. Selbst wenn Sie optional Telemetrie übertragen (z. B. Erkennungsstatistiken), bleibt die Kernentscheidung lokal.

- Privatsphäre: Kein Streaming von Mikrofondaten in externe Dienste.

- Latenz: Erkennung in Millisekunden bis wenigen hundert Millisekunden, je nach Pipeline.

- Robustheit: Funktioniert offline, auch in abgeschirmten oder instabilen Netzumgebungen.

- Kostenkontrolle: Keine laufenden Cloud-Gebühren pro Gerät oder pro Minute Audio.

ESP32-S3 als TinyML-Plattform: Was ihn für Audio-KI besonders macht

Der ESP32-S3 wird häufig empfohlen, weil er zusätzliche Vektor-Instruktionen bietet, die NN- und DSP-Workloads beschleunigen können. Espressif verweist darauf, dass sich diese Fähigkeiten über Bibliotheken wie ESP-DSP und ESP-NN nutzen lassen. Das ist relevant, weil Spracherkennung auf Mikrocontrollern typischerweise zwei rechenintensive Schritte kombiniert: Audio-Preprocessing (Spektrogramm/MFCC) und die Inferenz des neuronalen Netzes. Auf der offiziellen Produktseite wird die AI-Beschleunigung durch Vektor-Instruktionen explizit genannt.

- Vektor-Instruktionen: Beschleunigung für Signalverarbeitung und NN-Operationen. ESP32-S3 Produktübersicht

- Peripherie: I2S für digitale Mikrofone/Audio, mehrere Interfaces für Sensorik und Steuerung.

- Speicheroptionen: Unterstützung für externes Flash/PSRAM je nach Modul/Board – wichtig für größere Modelle und Audiopuffer.

Wenn Sie Details zu den Instruction Extensions suchen, hilft ein Blick ins Datenblatt: Dort werden die Vektor-Operationen und Registererweiterungen beschrieben, die speziell auf AI/DSP-Anwendungen zielen. ESP32-S3 Datasheet (PDF)

Grundprinzip der lokalen Spracherkennung: Pipeline statt „Magie“

Unabhängig vom Framework ist die typische Pipeline ähnlich. Sie besteht aus Audio-Erfassung, Vorverarbeitung, Modellinferenz und Postprocessing (z. B. Schwellenwerte, Glättung, Mehrheitsentscheid).

- Audio Capture: Mikrofon liefert PCM-Daten (z. B. 16 kHz, 16 Bit).

- Feature Extraction: Aus Roh-Audio werden Merkmale berechnet (Spektrogramm oder MFCC).

- Inference: Ein kleines NN klassifiziert das Fenster (z. B. „Wake Word“, „Ja/Nein“, „Unbekannt“).

- Decision Logic: Hysterese, Mindestdauer, „Debounce“ gegen Fehltrigger.

Gerade im Schul- oder Maker-Kontext ist es wichtig, diesen Ablauf zu erklären: Eine lokale Spracherkennung erkennt nicht „beliebige Sprache“, sondern meist Keyword Spotting (KWS) für kurze Befehle. Das macht TinyML erst praktikabel.

Framework-Auswahl: ESP-SR vs. TensorFlow Lite Micro

Für den ESP32-S3 haben sich zwei Wege etabliert: Espressifs eigene Speech-Recognition-Frameworks (ESP-SR) und ein generischer TinyML-Ansatz mit TensorFlow Lite Micro (TFLM). Beide sind valide – die Wahl hängt davon ab, ob Sie möglichst schnell zu einer fertigen Voice-Pipeline kommen oder maximale Kontrolle über Training und Modellarchitektur wünschen.

ESP-SR: Fertige Bausteine für Wake Word und Sprachbefehle

ESP-SR ist eine von Espressif bereitgestellte Sammlung aus Audio Front End (AFE) und Modellen für Wake-Word-Detection und Command Recognition, die explizit für ESP32/ESP32-S3 gedacht ist. Das Ziel: eine praxistaugliche, lokale Sprachlösung ohne dass Sie das gesamte Training selbst bauen müssen. In der Dokumentation werden Beispiele und die enthaltenen Algorithmen/Modelle beschrieben. ESP-SR Getting Started

- Vorteil: Schneller Einstieg, viele Voice-Details (AFE, Wake/Command) sind bereits integriert.

- Gut für: Lokale Aktivierungswörter, definierte Befehlssätze, produktnahe Prototypen.

- Hinweis: Bei Wake-Words sind Markenrechte relevant; Espressif weist im Repository auf rechtliche Aspekte hin. ESP-SR GitHub

TensorFlow Lite Micro: Maximale Kontrolle über Training und Modell

Wenn Sie ein eigenes KWS-Modell trainieren oder sehr spezifische Schlüsselwörter/Sprachen abdecken wollen, ist TFLM eine häufige Wahl. Das offizielle Micro Speech Example zeigt ein typisches Setup: Ein Audio-Preprocessor erzeugt Spektrogramm-Daten, und ein kleines Modell erkennt einfache Keywords. Für das Training existiert ein begleitendes Notebook, das demonstriert, wie ein sehr kleines Modell erstellt wird. Training Notebook (Micro Speech)

- Vorteil: Eigene Datensätze, eigene Labels, eigene Architektur – gute didaktische und technische Kontrolle.

- Gut für: Forschungs-/Unterrichtsszenarien, Spezialvokabular, domänenspezifische Befehle.

- Aufwand: Datenaufbereitung, Training, Quantisierung und Validierung müssen sauber geplant werden.

Audio-Hardware: Mikrofonwahl, I2S und typische Fehlerquellen

Die Qualität der Spracherkennung steht und fällt mit der Audio-Erfassung. Für den ESP32-S3 werden häufig digitale I2S-Mikrofone genutzt, weil sie ein sauberes digitales Signal liefern und sich gut in Echtzeit verarbeiten lassen. Der ESP32-S3 verfügt über I2S-Peripherie, die über den ESP-IDF-Treiber konfiguriert wird. ESP-IDF I2S (ESP32-S3)

- I2S-Mikrofone: Häufige Wahl für KWS; stabile Abtastraten und weniger analoges Rauschen.

- Abtastrate: Typisch 16 kHz für KWS; zu hohe Raten erhöhen Rechenlast und Speicherbedarf.

- Pegel/Format: Achten Sie auf 16/24/32-bit-Frames und die tatsächliche Datenbreite des Mikrofons.

- Clocking: Falsche BCLK/LRCLK-Konfiguration führt zu „hochfrequentem Pfeifen“ oder unbrauchbaren WAVs.

Wer Audio zusätzlich ausgeben oder einen Codec nutzen möchte, findet in ESP-IDF Beispielprojekte für I2S-Setups, etwa mit einem ES8311-Codec. ESP-IDF I2S Codec Example

Feature Extraction: Spektrogramm/MFCC als Schlüssel zum TinyML-Erfolg

Sprach-KI auf Mikrocontrollern arbeitet selten direkt auf Roh-Audio. Stattdessen werden Merkmale berechnet, die das Modell effizient auswerten kann. Sehr verbreitet sind Mel-Frequency Cepstral Coefficients (MFCC) oder Mel-Spektrogramme. Sie reduzieren Datenmenge, betonen sprachrelevante Frequenzbereiche und sind robust gegenüber kleinen Variationen.

- Fensterung: Audio wird in kurze Frames (z. B. 20–40 ms) aufgeteilt.

- FFT: Frequenzanalyse pro Frame; ergibt ein Spektrum.

- Mel-Filterbank: Gewichtung/Kompression auf mel-skalierten Bändern.

- Log/Normierung: Stabilisiert Dynamik und erleichtert dem Modell die Klassifikation.

In der Praxis gilt: Eine saubere Vorverarbeitung ist oft wichtiger als ein „größeres“ Modell. Viele Fehlklassifikationen entstehen nicht, weil das NN zu klein ist, sondern weil das Audio-Frontend falsch parametriert ist (Abtastrate, Gain, Rauschunterdrückung, falsches Fenster).

Modelltypen für Keyword Spotting: Klein, quantisiert, robust

Für lokale Spracherkennung auf dem ESP32-S3 werden meist kompakte CNN- oder DS-CNN-Architekturen eingesetzt. Entscheidend sind Modellgröße und Rechenaufwand. Typische Strategien sind:

- Int8-Quantisierung: Reduziert Speicher und beschleunigt Inferenz; Standard in vielen TFLM-Setups.

- „Unknown“-Klasse: Ein Modell braucht Beispiele für „nicht relevante“ Sprache, sonst triggert es zu oft.

- Noise Augmentation: Trainingsdaten mit Hintergrundgeräuschen erhöhen Robustheit im Alltag.

- Sliding Window + Smoothing: Mehrere Inferenzfenster werden kombiniert (Mehrheitsentscheid), um Fehltrigger zu senken.

Das Micro Speech Example ist ein guter Referenzpunkt, weil es die Architektur „Audio-Preprocessor + KWS-Modell“ klar trennt und damit gut erweiterbar ist.

Training eigener Sprachbefehle: Datensatz, Labels und Praxisregeln

Wer eigene Keywords („Start“, „Stop“, „Licht“, „Leise“) trainieren will, sollte den Datensatz nicht unterschätzen. Für schul- oder prototypische Lösungen reichen oft einige hundert Beispiele pro Klasse, wenn Augmentation genutzt wird. Für robuste Produkte sind deutlich mehr Daten sinnvoll. Die wichtigste Regel: Training muss die Realität abbilden (Raumhall, Hintergrundgeräusche, verschiedene Stimmen, verschiedene Abstände zum Mikrofon).

- Variabilität: Mehrere Sprecher, unterschiedliche Sprechgeschwindigkeiten, Mikrofonabstände.

- Umgebungen: Küche, Wohnzimmer, Werkstatt – nicht nur ruhige Laborsituation.

- Negativdaten: „Unknown“ und „Silence“ sind Pflicht, sonst steigt die False-Positive-Rate.

- Balance: Klassen sollten ähnlich viele Beispiele haben, sonst lernt das Modell Schieflagen.

Das TFLM-Training-Notebook zeigt anschaulich, wie ein sehr kleines Modell für Mikrocontroller trainiert werden kann und welche Schritte typischerweise dazugehören (Training, Konvertierung, Quantisierung). Train Micro Speech Model (Colab)

Integration in Firmware: Speicher, Latenz und Echtzeit-Aspekte

Bei lokalem KWS auf dem ESP32-S3 müssen Sie Ressourcen bewusst planen. Audio erfordert Puffer, Feature Extraction erfordert temporäre Arrays, und das Modell braucht Tensor-Arena-Speicher. Typische Optimierungshebel sind Modellgröße, Feature-Dimensionen, Fensterlänge und die Frequenz, mit der Sie Inferenz ausführen.

- RAM-Planung: Audio-Ringbuffer + Feature-Buffer + Tensor-Arena getrennt dimensionieren.

- PSRAM nutzen: Für größere Puffer oder Modelle, wenn das Board/Modul PSRAM bietet.

- Task-Aufteilung: Audio-Capture in einem Task/ISR-nah, Inferenz in einem separaten Task.

- Prioritäten: Audio darf nicht „verhungern“, sonst entstehen Artefakte und Erkennung bricht ein.

Wenn Sie im ESP-IDF arbeiten, ist die I2S-Konfiguration ein Kernbaustein für stabile Audio-Frames. Die offizielle API-Referenz beschreibt Treiber und Konfigurationsmöglichkeiten für ESP32-S3. I2S Programming Guide (ESP32-S3)

ESP-SR in der Praxis: AFE, WakeNet, MultiNet und typische Einsatzmuster

ESP-SR wird oft als „Voice-Baukasten“ genutzt: Ein Audio Front End (AFE) übernimmt Vorverarbeitung (z. B. Rauschunterdrückung, Beamforming je nach Setup), danach folgen Wake-Word-Detection und ggf. Befehls-Erkennung. In der Übersichtsdokumentation wird ESP-SR als Framework beschrieben, das genau diese Komponenten bündelt. ESP-SR Dokumentation

- Wake Word: Aktiviert das System nur bei Erkennung – spart Energie und reduziert Fehlaktionen.

- Command Recognition: Nach Aktivierung wird ein begrenztes Befehlsset erkannt.

- Lokales Feedback: LED, Ton oder Display bestätigt Status („gehört“, „verstanden“, „unklar“).

Für viele Haushalts- und Gerätesteuerungen ist das genau der richtige Umfang: wenige klare Befehle, dafür sehr zuverlässig und datenschutzfreundlich.

Typische Qualitätsprobleme: False Positives, Raumhall und Mikrofonposition

In der Realität ist Spracherkennung auf kleinen Geräten vor allem eine Qualitäts- und Tuning-Aufgabe. Die häufigsten Probleme sind Fehltrigger (False Positives) und Nicht-Erkennung (False Negatives). Beides lässt sich systematisch adressieren:

- False Positives: Mehr „Unknown“-Daten, höhere Schwellenwerte, Smoothing über mehrere Fenster.

- False Negatives: Mehr Variabilität im Training, Mikrofon-Gain prüfen, Feature-Parameter anpassen.

- Raumhall: Positionierung ändern, ggf. AFE/Noise Reduction nutzen, Training mit Hall/Noise augmentieren.

- Störquellen: Lüfter, TV, Küchenmaschine – als Trainingsnoise berücksichtigen.

Ein praktischer Tipp für Lehrkräfte und Teams: Führen Sie ein kleines Testprotokoll ein (10 Wiederholungen pro Keyword, drei Sprecher, drei Entfernungen). So werden Verbesserungen messbar, statt „gefühlt“.

Energie und Nachhaltigkeit: Lokale Erkennung effizient betreiben

Auch wenn der ESP32-S3 KI kann, sollten Sie Stromverbrauch aktiv managen – insbesondere bei batteriebetriebenen Geräten. In vielen Anwendungen reicht es, das System im „Low Duty Cycle“ zu betreiben: Wake-Word-Erkennung dauerhaft (wenn nötig), Befehls-Erkennung nur nach Wake-Event, WLAN nur bei Bedarf. Deep-Sleep ist für Dauer-Audio eher unpraktisch, aber Stromsparstrategien über Takt, Task-Design und Funk-Management sind weiterhin relevant.

- WLAN on demand: Sprachsteuerung lokal, Netzwerk nur für Status/Updates.

- Wake then listen: Erst Aktivierungswort, dann kurzes Kommandofenster.

- Sampling pragmatisch: 16 kHz ist oft ausreichend; höhere Raten erhöhen Rechenlast.

Datenschutz und Produktreife: Was Sie dokumentieren sollten

Bei lokaler Spracherkennung ist Transparenz gegenüber Nutzern entscheidend. Dokumentieren Sie klar, ob Audio gespeichert wird, ob Rohdaten übertragen werden und wie Updates erfolgen. Wenn Sie ESP-SR nutzen, beachten Sie zusätzlich die Hinweise im Repository zu Wake-Words und Rechten – besonders, wenn Sie kommerzielle Anwendungen planen. ESP-SR Hinweise (GitHub)

- Data Handling: Werden Audiodaten gespeichert? Wenn ja, wie lange und wofür?

- Edge-First: Standardmäßig lokal, Cloud optional und abschaltbar.

- Update-Sicherheit: Signierte Updates/OTA-Strategie (je nach Projektumfang).

Praxis-Checkliste: So starten Sie strukturiert mit TinyML-Spracherkennung auf dem ESP32-S3

- Boardwahl: ESP32-S3-Board mit passender Speicheroption (ggf. PSRAM) und zugänglichen I2S-Pins.

- Mikrofon: I2S-Mikrofon bevorzugt; Abtastrate (z. B. 16 kHz) und Datenformat festlegen.

- Framework: Schnellstart mit ESP-SR oder Custom-Training mit TFLM Micro Speech.

- Audio-Frontend: Feature-Parameter dokumentieren (Fenster, Hop, Mel-Bänder, Normierung).

- Erkennungslogik: Schwellenwert + Smoothing + Cooldown gegen Mehrfachtrigger.

- Testplan: Mehrere Sprecher, mehrere Entfernungen, typische Hintergrundgeräusche.

- Firmware-Struktur: Audio-Capture getrennt von Inferenz; Puffergrößen explizit festlegen.

- Dokumentation: Pins, Abtastrate, Modellversion, Trainingsdaten-Version, bekannte Grenzen.

Für die saubere I2S-Grundlage ist die offizielle Referenz im ESP-IDF ein verlässlicher Ausgangspunkt. Inter-IC Sound (I2S) – ESP32-S3

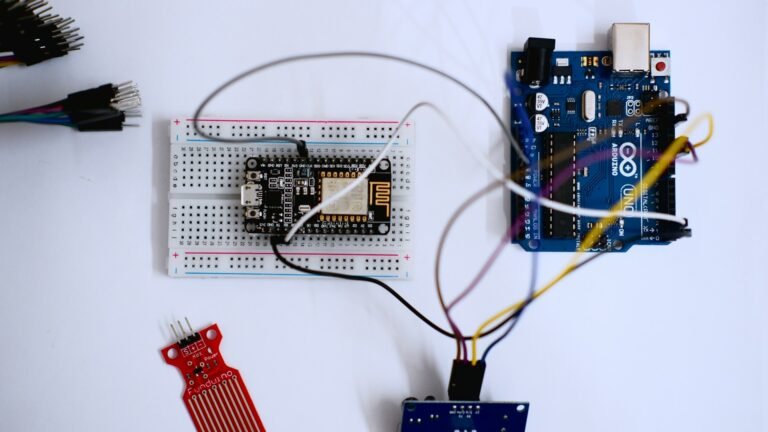

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.