Mein Jahr mit 100 Pro Minis: Ein Fazit zur Langzeitstabilität war kein reines Technikexperiment, sondern ein praxisnaher Dauertest unter realen Bedingungen: Innenräume mit trockener Heizungsluft, feuchte Kellerräume, wechselnde Lastprofile, unterschiedliche Stromversorgungen und ein Mix aus Sensor-, Aktor- und Logging-Aufgaben. Genau diese Vielfalt macht die Frage nach der Langzeitstabilität so relevant. Ein einzelner Prototyp kann monatelang sauber laufen und trotzdem nichts über ein größeres Feld aus 100 Knoten aussagen. Erst wenn viele Nodes gleichzeitig arbeiten, zeigen sich die echten Muster: Welche Ausfälle treten wiederholt auf? Welche Firmware-Strategien reduzieren Reboots? Wie stark beeinflussen Netzteile, Leitungswege und Gehäuse das Verhalten? Dieser Artikel zeigt die wichtigsten Erkenntnisse aus einem vollständigen Betriebsjahr mit 100 Pro Mini Systemen – inklusive Planung, Messmethodik, Fehlertypen, Wartungsprozessen und konkreten Optimierungen. Ziel ist ein belastbarer Leitfaden für Einsteiger, Fortgeschrittene und Profis, die Pro-Mini-Projekte nicht nur zum Laufen bringen, sondern langfristig stabil betreiben möchten.

Ausgangslage des Langzeittests: Warum 100 Nodes mehr zeigen als ein Laboraufbau

Langzeitstabilität ist in Embedded-Projekten kein abstrakter Qualitätsbegriff, sondern eine messbare Systemeigenschaft. Im Testverbund wurden 100 Pro Minis in drei Hauptrollen eingesetzt: Umweltsensorik, einfache Aktorsteuerung und zyklisches Datenlogging. Die Knoten liefen in unterschiedlichen Intervallen, teils batteriegestützt, teils mit Netzversorgung und teils mit hybriden Versorgungspfaden. Dadurch entstand ein realistisches Bild über typische Schwachstellen.

- 40 Sensor-Nodes mit periodischer Messung und Sleep-Betrieb

- 35 Aktor-Nodes mit Ereignissteuerung und kurzen Lastspitzen

- 25 Logger-Nodes mit lokalem Puffern und zeitversetzter Übertragung

Die wichtigste Erkenntnis schon in den ersten Wochen: Die Hardware selbst ist selten der alleinige Problemverursacher. Instabilität entsteht meist an den Übergängen zwischen Versorgung, Firmware, Peripherie und Montageumgebung.

Testdesign und Metriken: So wurde Stabilität überhaupt messbar

Ohne klare Messgrößen bleibt „stabil“ ein Bauchgefühl. Für das Jahr wurden daher einheitliche Metriken festgelegt. Neben klassischen Ausfallraten wurden auch Soft-Fehler, Brownouts und Wiederanlaufzeiten dokumentiert.

Verwendete Kernmetriken

- Uptime pro Node und Monat

- Ungeplante Neustarts pro 1.000 Betriebsstunden

- Fehlerfreie Messzyklen in Prozent

- Kommunikationsaussetzer pro Tag

- Wiederherstellungszeit nach Störung

Für die statistische Vergleichbarkeit wurde jeder Node einer Hardware-Revision, Firmware-Version und Standortklasse zugeordnet. Dadurch ließen sich Fehlercluster schnell identifizieren, statt isolierte Einzelfälle zu diskutieren.

Stromversorgung als Hauptfaktor für Langzeitstabilität

Über das Jahr zeigte sich deutlich: Die meisten Probleme waren energiebedingt. Nicht die nominelle Spannung war kritisch, sondern kurzzeitige Einbrüche, Lastsprünge und schlecht abgestimmte Reglerketten. Besonders problematisch waren Konstellationen mit langen Leitungen und impulsstarken Verbrauchern.

- Brownouts bei gleichzeitiger Sensor- und Funkaktivierung

- Spannungsrauschen durch minderwertige Netzteile

- Instabile Startzustände bei kalten Umgebungen

- Batteriebedingte Drift im unteren Spannungsbereich

Ein einfaches, aber wirksames Mittel war die striktere Trennung von Logik- und Lastpfad sowie zusätzliche lokale Pufferung an den Knoten. Nach dieser Anpassung sank die Reboot-Rate spürbar.

Faustformel zur Abschätzung der Laufzeitreserve

Mit

Firmware-Qualität übertrifft Hardware-Tuning in der Wirkung

Der zweite große Hebel war die Firmware. Schon kleine Änderungen in Scheduling und Fehlerbehandlung reduzierten Störungen deutlicher als viele Hardware-Nachbesserungen. Besonders erfolgreich war eine klarere Zustandslogik mit harten Timeouts und definierter Recovery.

- Watchdog mit sauberem Wiederanlaufpfad statt blindem Reset

- Sensorinitialisierung mit Retry-Backoff

- Kommunikation strikt entkoppelt von Messroutine

- Fail-safe Default, wenn Peripherie keine gültigen Werte liefert

Ein häufiger Fehler in frühen Versionen: zu viel Arbeit in einem Zyklus. Nach Aufteilung in kleine, planbare Arbeitspakete wurden Timing-Spitzen reduziert, was wiederum Versorgung und Stabilität entlastete.

Die häufigsten Ausfallmuster im Jahresverlauf

Über 12 Monate traten fünf Fehlertypen immer wieder auf. Wer diese Muster früh kennt, spart in eigenen Projekten viel Zeit.

1) Brownout-Reboots unter Lastspitzen

Kurzzeitige Spannungseinbrüche führten zu sporadischen Neustarts, häufig ohne klaren Logeintrag. Ursache war selten der Pro Mini selbst, sondern die Kombination aus Leitungswiderstand, Pufferung und Lastprofil.

2) Sensor-Hänger nach fehlerhafter Initialisierung

Einige Sensoren lieferten nach seltenen Startsequenzen keine gültigen Daten mehr, blockierten aber den Hauptloop. Erst klare Timeouts und Reinit-Strategien beseitigten das Problem nachhaltig.

3) Speicherfragmentierung durch ungünstige String-Nutzung

In älteren Firmwareständen entstanden Langzeitfehler durch dynamische Speicheroperationen. Nach Umstellung auf statische Puffer verschwanden die Symptome weitgehend.

4) Kommunikationsstörungen bei schlechtem Antennen- oder Leitungslayout

Vor allem in Aktor-Nodes mit zusätzlichen Störquellen trat Paketverlust auf. Verbesserte Leitungsführung und entkoppelte Versorgung stabilisierten die Kommunikation.

5) Umweltbedingte Drift in feuchten Standorten

Nicht jeder Fehler ist digital. Kondensation, Oxidation und verschmutzte Kontakte verursachten schleichende Instabilität. Mechanische und klimatische Schutzmaßnahmen waren hier entscheidend.

Mechanik und Gehäuse: Der unterschätzte Teil der Zuverlässigkeit

In Langzeitsystemen entscheidet die Mechanik oft stärker als erwartet. Zwei identische Nodes können sich völlig unterschiedlich verhalten, wenn Gehäuse, Zugentlastung oder Montagehöhe variieren.

- Kondensationsmanagement durch sinnvolle Belüftung

- Spritzwasserschutz ohne Wärmestau

- Zugentlastete Leitungen zur Reduktion von Kontaktproblemen

- Korrosionsarme Steck- und Lötverbindungen

Besonders wirksam war eine standardisierte Montageanleitung mit Bildreferenzen. Dadurch sanken standortbedingte Installationsfehler bereits in der Einführungsphase.

Wartungskonzept statt Feuerwehrmodus

Bei 100 Knoten funktioniert „bei Ausfall reagieren“ nur kurzfristig. Stabilität über ein Jahr entsteht durch planbare Wartung. Eingeführt wurde ein fester Rhythmus aus Fernüberwachung, Vor-Ort-Checks und vorbeugendem Tausch kritischer Komponenten.

Bewährter Wartungsrhythmus

- Täglich: automatischer Health-Check (Heartbeat, Spannungsniveau, Datenlücken)

- Wöchentlich: Anomaliebericht und Priorisierung

- Monatlich: Stichprobenprüfung vor Ort

- Quartalsweise: Revisionsabgleich, Firmware-Review, Ersatzteilrotation

Der Effekt war messbar: weniger Totalausfälle, kürzere Wiederherstellungszeiten und stabilere Datenkontinuität über alle Standortklassen.

Standardisierung als Schlüssel für Skalierung

Je größer das Node-Netz, desto wichtiger werden Standards. Ohne einheitliche Revisionen und Namenskonventionen ist Ursachenanalyse kaum effizient möglich. Im Projekt wurden daher Hard- und Software strikt versioniert.

- Hardware-Revision mit eindeutiger Kennung je Node

- Firmware-Version in jedem Datentelegramm

- Einheitliches Pin- und Kabelschema

- Standardisierte Log-Events mit Fehlercodes

Durch diese Vereinheitlichung konnten Fehlercluster innerhalb weniger Stunden statt mehrerer Tage isoliert werden. Für Profis ist das der entscheidende Hebel zur Senkung der Betriebskosten.

Datenqualität im Langzeitbetrieb: Stabil heißt nicht automatisch valide

Ein Node kann technisch online sein und dennoch fachlich unbrauchbare Daten liefern. Deshalb wurden Verfügbarkeits- und Qualitätsmetriken getrennt betrachtet. Für die Datenqualität waren Plausibilitätsprüfungen und Driftkontrollen zentral.

Hierbei steht

Einsteigerfehler, die im Feld teuer werden

Viele Probleme traten anfangs aus Gründen auf, die in Tutorials selten im Fokus stehen. Wer diese Punkte früh beachtet, erhöht die Langzeitstabilität deutlich.

- Zu optimistische Annahmen zur Batterielaufzeit ohne Kältereserve

- Fehlende Entkopplung bei gemischten Lastprofilen

- Keine klare Trennung von Mess-, Kommunikations- und Wartungslogik

- Ungenügende Dokumentation von Standort und Montagebedingungen

- Keine definierten Recovery-Pfade bei Sensor- oder Busfehlern

Besonders wertvoll für Einsteiger war ein „Pre-Deployment-Check“, der jedes Gerät vor Feldmontage auf Startverhalten, Spannungsstabilität und Log-Signatur testete.

Was Fortgeschrittene aus dem Jahresbetrieb mitnehmen können

Für Teams mit ersten Projekterfahrungen liegt der nächste Schritt in reproduzierbaren Betriebsprozessen. Der Fokus verschiebt sich von „läuft“ zu „läuft überall gleich“. Drei Maßnahmen zeigten hier den größten Nutzen:

- Konfigurationsmanagement mit festen Profilen statt manueller Einzelanpassung

- Automatisierte Regressionstests für neue Firmwarestände

- Stufenweiser Rollout (Canary-Nodes) vor flächiger Aktualisierung

Durch Canary-Rollouts konnten fehlerhafte Versionen früh erkannt werden, bevor sie die gesamte Flotte beeinflussten. Das senkte operative Risiken erheblich.

Profi-Perspektive: TCO, MTBF und Betriebssicherheit

Im professionellen Umfeld zählt nicht nur technische Eleganz, sondern Gesamtwirtschaftlichkeit. Über ein Jahr wurden daher neben Fehlern auch Wartungszeit und Ersatzteilbedarf erfasst. Daraus ergaben sich klare Prioritäten für den nächsten Ausbau:

- MTBF-orientierte Designentscheidungen statt Feature-Überladung

- Reduktion seltener, aber teurer Vor-Ort-Einsätze

- Bessere Diagnosefähigkeit für Remote-Entscheidungen

- Ersatzteilstrategie nach Ausfallwahrscheinlichkeit

Eine einfache Verfügbarkeitsbetrachtung pro Flotte half bei der Planung:

Selbst moderate Verbesserungen der mittleren Reparaturzeit (MTTR) hatten einen großen Effekt auf die Gesamtverfügbarkeit.

SEO-relevante Erkenntnisse aus realem Dauerbetrieb

Wer Inhalte zu „Langzeitstabilität Pro Mini“ veröffentlicht, sollte sich an realen Suchintentionen orientieren. Nutzer suchen selten abstrakte Theorie, sondern konkrete Lösungen für Feldprobleme.

- „Pro Mini rebootet sporadisch“

- „Brownout bei Sensor + Funk“

- „Arduino Langzeitbetrieb stabilisieren“

- „Watchdog richtig einsetzen“

- „Batterielaufzeit realistisch berechnen“

Content mit hoher E-E-A-T-Wirkung zeigt reproduzierbare Methodik, klare Messgrößen und nachvollziehbare Verbesserungen statt isolierter Einzelerfolge.

Praktische Checkliste für stabile Pro-Mini-Flotten

- Versorgungspfad unter realer Last messen, nicht nur im Leerlauf

- Sensor- und Kommunikationsfehler mit Timeouts absichern

- String-lastige dynamische Speicheroperationen vermeiden

- Watchdog mit bewusstem Recovery-Design implementieren

- Gehäuse, Montage und Leitungsführung standardisieren

- Firmware-Rollouts stufenweise mit Canary-Nodes durchführen

- Health-Metriken täglich automatisiert überwachen

- Dokumentation von Revisionen und Standorten verpflichtend führen

Nützliche Ressourcen für belastbare Embedded-Praxis

- Arduino-Dokumentation: Boards, Libraries, Best Practices

- Microchip Application Notes: AVR, Power, Reliability

- Memfault Interrupt: Embedded Reliability und Debugging

- Analog Dialogue: Praxisartikel zu Power und Signalintegrität

- All About Circuits: Grundlagen zu Versorgung, Layout und EMV

Das Jahr mit 100 Pro Minis hat gezeigt, dass Langzeitstabilität kein Zufall ist, sondern das Ergebnis aus konsistenter Architektur, sauberem Energiemanagement, robuster Firmware und diszipliniertem Betrieb. Wer diese vier Ebenen gemeinsam optimiert, kann mit vergleichsweise einfacher Hardware eine überraschend hohe Zuverlässigkeit im Dauerbetrieb erreichen – auch bei heterogenen Standorten und wechselnden Umweltbedingungen.

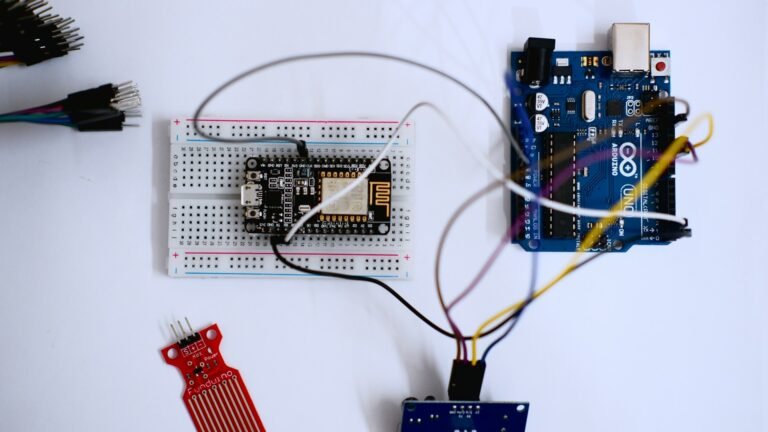

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.