MTTR senken mit einem „Evidence Pack“ pro OSI-Layer bedeutet, dass Sie im Incident-Fall nicht erst Daten zusammensuchen, sondern pro Schicht des Netzwerk- und Applikationsstacks eine vordefinierte, belastbare Beweissammlung bereit haben. Das Hauptkeyword „MTTR senken mit einem Evidence Pack pro OSI-Layer“ ist dabei kein Buzzword, sondern ein praktisches Betriebsprinzip: Jede Minute, die ein On-Call in Logs, Dashboards, Tickets und Chat-Threads nach Hinweisen sucht, verlängert die Mean Time To Repair. Ein Evidence Pack strukturiert diese Suche, reduziert Vermutungen und sorgt dafür, dass Teams schneller zwischen Symptom und Ursache unterscheiden. In modernen Cloud- und Kubernetes-Umgebungen ist das besonders relevant, weil Fehlerbilder oft „network-ish“ wirken, aber auf ganz anderen Ebenen entstehen: DNS, TLS, Load Balancing, Retries, Connection Pools oder Session-Themen. Mit einem OSI-basierten Evidence Pack bringen Sie Ordnung in diese Komplexität, schaffen gemeinsame Sprache zwischen SRE, Platform, Netzwerk, Security und Entwicklung und verkürzen die Zeit bis zur ersten belastbaren Hypothese. Entscheidend ist: Das Pack muss klein genug sein, um im Stress genutzt zu werden, aber vollständig genug, um Streit über Zuständigkeiten zu vermeiden.

Warum ein OSI-basiertes Evidence Pack die MTTR konkret reduziert

In Incidents verlieren Teams Zeit an drei Stellen: beim Kontextaufbau (Was ist kaputt?), bei der Eingrenzung (Wo ist es kaputt?) und bei der Absicherung (Können wir es beweisen?). Ein Evidence Pack pro OSI-Layer beschleunigt alle drei Schritte. Es zwingt nicht in starre „Netzwerk vs. App“-Gräben, sondern betrachtet den Datenpfad als Kette von Abhängigkeiten. Sobald klar ist, auf welchem Layer die Evidenz „rot“ wird, können Sie Owners, Runbooks und Mitigations zielgerichtet aktivieren.

- Schneller Kontext: Standardisierte Screens/Datenpunkte zeigen sofort, ob das Problem global oder segmentiert ist (Region, AZ, Client-Typ, Service).

- Schnellere Eingrenzung: OSI-Layer dienen als mentale Checkliste, sodass „blinde Flecken“ seltener auftreten (z. B. DNS/TLS als Hidden Layers).

- Schnellerer Beweis: Evidenzartefakte (Metriken, Logs, Traces, Flow Logs) werden so gesammelt, dass sie eine Hypothese stützen oder widerlegen.

Für die Methodik rund um Reliability, Incident Response und SLO-Denken ist das Site Reliability Engineering Book eine solide Grundlage, die sich gut mit OSI-orientierten Playbooks verbinden lässt.

Das Prinzip „Evidence Pack“: Was gehört hinein und was nicht

Ein Evidence Pack ist keine Dokumentenhalde. Es ist ein kuratierter Satz an Evidenzen, der in wenigen Minuten abrufbar ist. Die wichtigste Regel lautet: Jedes Artefakt muss eine konkrete Frage beantworten. Alles andere erhöht kognitive Last und verlängert die MTTR.

- Signal statt Rauschen: Maximal 5–10 Kernsignale pro Layer, dazu optional 2–3 Deep-Dive-Signale.

- Segmentierung: Jede Evidenz sollte nach den üblichen Fault Domains filterbar sein (Region/AZ, Cluster, Node Pool, Service, Client-Klasse).

- Zeitrahmen: Standardfenster (z. B. „letzte 15 Minuten“, „letzte 2 Stunden“) plus ein „Vergleich zu Baseline“.

- Beweisbarkeit: Bevorzugt objektive Messdaten (Metriken/Logs), nicht subjektive Beobachtungen.

MTTR messen: Von Gefühl zu belastbarer Kennzahl

Damit Sie „MTTR senken“ nicht nur behaupten, sollten Sie messen, wie sich das Evidence Pack auswirkt. Praktisch ist eine Unterteilung in Teilzeiten: Zeit bis Detection, Zeit bis Triaging, Zeit bis Mitigation, Zeit bis Recovery. Ein Evidence Pack wirkt besonders stark auf „Time to Triage“ und „Time to Correct Hypothesis“.

Wenn Sie pro Incident grob dokumentieren, in welcher Phase Zeit verloren ging, können Sie das Evidence Pack iterativ verbessern: Entfernen, was nie hilft, und ergänzen, was in der Praxis fehlt.

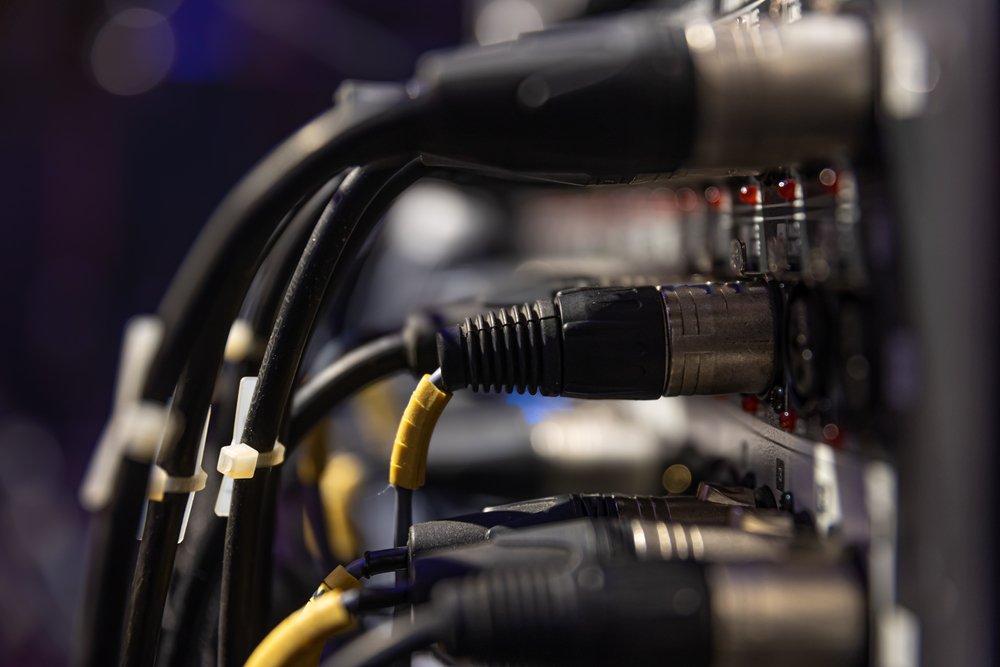

Layer-1-Evidence Pack: „Physisch“ in der Cloud trotzdem relevant

Auch wenn Sie keine Kabel anfassen, ist Layer 1 als Underlay-Realität relevant: Provider-Netz, NIC-Probleme, Hypervisor-Host, ToR-Switches, optische Links. Ihre Einflussmöglichkeit ist begrenzt, aber Ihre Diagnosefähigkeit sollte es nicht sein. Ziel ist nicht, Layer 1 selbst zu reparieren, sondern Underlay-Störungen zu erkennen, zu isolieren und sauber zu eskalieren.

- Provider-Status und Incident Feeds: Region/AZ-spezifische Degradationsmeldungen, Wartungsfenster, bekannte Störungen.

- Host-/Node-Health: NIC errors, link flaps, Packet drops auf Interface-Ebene (falls verfügbar), Hardware Events.

- Cross-AZ-Baseline: Latenz-Baseline zwischen AZs/Regions als Vergleichswert.

- Blast Radius Muster: Viele Services gleichzeitig, aber nur in einer Zone/Region betroffen.

Als Orientierung für Provider-Abgrenzungen ist das Konzept der „Shared Responsibility“ hilfreich; je nach Cloud-Anbieter finden Sie dazu offizielle Modelle, etwa über den Anchor-Text Shared Responsibility Model.

Layer-2-Evidence Pack: ARP/ND, Overlay und „unsichtbare“ Broadcast-Effekte

Layer 2 ist in virtuellen Netzwerken oft „emuliert“: VPC/VNet abstrahieren vieles, Overlays (VXLAN/GENEVE) kapseln L2 über L3. Trotzdem entstehen L2-ähnliche Probleme: ARP/ND-Pressure, MAC-Table-Churn, Storms in bestimmten Setups, fehlerhafte Bridge-Konfigurationen oder CNI-Effekte in Kubernetes.

- Node/Host Netzwerkstatistiken: RX/TX drops, errors, overruns, queue length, MTU-Mismatches.

- ARP/ND-Rate: ungewöhnlich hohe Neighbor Discovery/ARP-Events als Indikator für Scale-Probleme.

- CNI-Health: Pod-to-Pod Connectivity Checks, CNI-Logs, iptables/eBPF-Komponentenstatus.

- Overlay-Symptome: Paketverluste nur bei bestimmten Pfaden (z. B. Pod-to-Service), nicht aber Host-to-Host.

Wenn Sie in Data-Center-nahen Umgebungen EVPN/VXLAN einsetzen, lohnt sich Hintergrundwissen über EVPN, z. B. über den Anchor-Text BGP MPLS-Based Ethernet VPN als Referenz für die EVPN-Grundidee.

Layer-3-Evidence Pack: Routing, CIDR, NAT und die häufigsten Designfehler

Layer 3 ist der Layer, auf dem Cloud-Fehlerbilder besonders oft „teuer“ werden: falsche CIDR-Planung, kollidierende Netze in Hybrid-Setups, ungewollter Cross-Zone-Traffic, fehlerhafte Route Tables oder Engpässe an NAT-Gateways/Firewalls. Ein gutes Evidence Pack trennt „Connectivity vorhanden, aber langsam“ von „Connectivity fehlt“.

- Route Table Snapshot: relevante Routen (0.0.0.0/0, Service CIDRs, Peering/Transit) inkl. letzter Änderung (Change-Korrelation).

- Flow Evidence: VPC/VNet Flow Logs, Firewall Logs, Drop Reasons, accepted/rejected Trends.

- NAT-Gateway-Indikatoren: Port Exhaustion, Connection Tracking, throughput, drop counters.

- Path-Symmetrie: Hinweise auf asymmetrisches Routing (z. B. Rückweg über andere Appliance).

- Cross-Zone/Region-Anteile: Traffic-Topologie: steigt Cross-AZ, steigen oft Kosten und Tail Latency.

Für BGP-Grundlagen in Hybrid-Szenarien ist die Spezifikation ein guter Einstieg, z. B. über den Anchor-Text A Border Gateway Protocol 4 (BGP-4).

Layer-4-Evidence Pack: TCP, Timeouts, Retransmissions und Tail Latency

Layer 4 ist die Heimat vieler „mysteriöser“ Produktionsprobleme: Retransmissions, SYN Backlog, Connection Resets, Idle Timeouts, Keepalive-Missverständnisse, Port Exhaustion und Conntrack-Limits. Diese Signale sind extrem wertvoll, weil sie beweisen können, ob Degradation real im Transport stattfindet oder nur wie Netzwerk aussieht.

- TCP Retransmissions: Rate und Korrelation zu Latenzspitzen; segmentiert nach Pod/Node/Service.

- Handshake-Fehler: SYN/SYN-ACK/ACK-Fehlerquoten, connect timeouts.

- Conntrack-Auslastung: current vs. max, drop count, time_wait-Sättigung.

- Ephemeral Port Usage: Port-Auslastung und Fehler wie „cannot assign requested address“.

- Timeout-Matrix: Client-Timeout, Load Balancer-Timeout, Upstream-Timeout, Idle Timeout (nebeneinander, nicht getrennt).

Als technische Referenz für TCP ist Transmission Control Protocol (TCP) hilfreich, um Begriffe wie Retransmission, RTO und Congestion Control sauber einzuordnen.

Layer-5-Evidence Pack: Sessions, Affinity und warum „sticky“ die Resilienz sabotieren kann

Layer 5 wird in der Praxis oft übersehen, weil Sessions „applikativ“ wirken. Operativ sind Sessions jedoch ein Stabilitätsfaktor: Sticky Sessions können Hotspots erzeugen, Session Stores können Single Points of Failure sein, und Session Drops können Retry Storms auslösen. Ein Evidence Pack auf Layer 5 fokussiert daher auf Session-Lebenszyklus, Affinity-Verhalten und Abhängigkeiten (z. B. Redis).

- Session Creation/Refresh Rate: sprunghafte Erhöhung kann auf Loops, Bots oder fehlerhafte TTLs hinweisen.

- Session Store Health: Redis/Memcached Latenz, Errors, saturation, evictions.

- Load Balancer Affinity: Anteil stickier Verbindungen, Skew in Backend-Verteilung.

- Retry Amplification: Retries pro Request (Client/Ingress/Service Mesh), korreliert mit Session Drops.

Layer-6-Evidence Pack: TLS, Zertifikate und „Network“-Fehlalarme

Viele Incidents beginnen mit „Verbindungen brechen random ab“ und enden als Zertifikats- oder TLS-Problem. Layer 6 ist deshalb ein Pflichtteil des Evidence Packs, insbesondere in Umgebungen mit mTLS, Service Mesh, TLS-Offload oder häufiger Zertifikatsrotation.

- TLS Handshake Success/Latency: getrennt nach Client-Klassen, Regionen und SNI.

- Zertifikatszustand: Ablaufdatum, Chain-Validität, OCSP/CRL-Verhalten, Intermediate-Kette.

- Cipher/Protocol Mismatch: Fehlercodes/Logs, die auf Client-Inkompatibilität hindeuten.

- mTLS Policy Evidence: abgewiesene Verbindungen nach Reason (z. B. unknown CA, SAN mismatch).

Für TLS-Grundlagen ist The Transport Layer Security (TLS) Protocol Version 1.3 ein guter Referenzpunkt, um Handshake-Phasen und Fehlermuster korrekt zu interpretieren.

Layer-7-Evidence Pack: HTTP-Semantik, Retries, Idempotency und „echte“ Ursachen

Layer 7 ist meist der sichtbarste Layer, aber nicht automatisch der ursächliche. Ein gutes Evidence Pack hilft, zwischen Upstream Down, Timeout und Misroute zu unterscheiden, 4xx korrekt einzuordnen und Retry-Verhalten sowie Caching zu berücksichtigen. Besonders wichtig: Nicht nur Statuscodes sammeln, sondern semantische Hinweise (Pfad, Methode, Header, Idempotency).

- Statuscode-Taxonomie: 502/503/504 getrennt, 429/408/499 (client closed) als eigene Kategorie.

- Request-Latenz nach Phase: DNS, connect, TLS, TTFB, download – wenn verfügbar.

- Retry-Header und Policies: clientseitige Retries, Ingress-Retries, Service-Mesh-Retries (inkl. Backoff).

- Idempotency Indicators: Anteil nicht-idempotenter Retries (Risiko für Nebenwirkungen).

- Tracing Evidence: verteilte Traces mit klarer Markierung, ob Zeit im Client, Proxy oder Upstream verbrannt wird.

Für Observability-Standards über Services hinweg ist das OpenTelemetry-Projekt eine verbreitete Basis, insbesondere wenn Sie Metriken und Traces aus Ingress, Mesh und Apps konsistent verknüpfen wollen.

Evidence Pack als Template: So wird es „einsatzbereit“ statt nur dokumentiert

Ein Evidence Pack funktioniert nur, wenn es im Incident in Sekunden erreichbar ist. Das gelingt, wenn Sie es als operationales Artefakt behandeln: als Dashboard-Set, Query-Sammlung, Standard-Export und Ticket-Template. Idealerweise erzeugen Sie daraus im Incident automatisch ein „Bundle“: Screenshots/Permalinks, relevante Log-Snippets, Flow Log-Ausschnitte, Traces und Change-Events.

- Ein Entry Point: eine zentrale „Incident Home“-Seite mit Tabs pro OSI-Layer.

- Standardfilter: Service, Region, Cluster, Zeitfenster; Voreinstellungen für On-Call.

- Permalinks: Links auf exakt reproduzierbare Abfragen (damit Diskussionen nicht auf „bei mir sieht’s anders aus“ enden).

- Change-Korrelation: Deployments, Config-Changes, Feature Flags und Infrastrukturänderungen im gleichen Zeitstrahl.

Wie Sie pro Layer „Beweisstärke“ definieren: von Indiz zu Ursache

Nicht jede Metrik ist ein Beweis. Ein Evidence Pack sollte deshalb pro Layer Signale nach Beweisstärke ordnen. Das reduziert die Gefahr, dass Teams aus schwachen Indizien falsche Prioritäten ableiten.

- Stark: eindeutige Fehlercodes, Drops mit Reason, reproduzierbare Synthetics, Traces mit klarer Zeitallokation.

- Mittel: korrelierende Latenzspitzen, erhöhte Retransmissions, Queueing-Indikatoren.

- Schwach: „CPU hoch“, „Fehler im Log“ ohne Kontext, einzelne User Reports ohne Segmentierung.

Playbook-Integration: Vom Evidence Pack zur nächsten Aktion

Ein Evidence Pack senkt MTTR besonders dann, wenn es nicht nur Diagnose liefert, sondern direkt in Handlungen übersetzt: Welche Mitigation ist erlaubt? Welche Eskalation ist sinnvoll? Welche Guardrails verhindern Nebenwirkungen? Verknüpfen Sie daher jedes Layer-Pack mit klaren „Next Steps“.

- Layer 1–3: Provider-Ticket-Vorlage, betroffene Regionen/AZs, Belege (Flow/Drops/Baselines), temporäre Reroutes/Failover.

- Layer 4: Timeout-Tuning, Connection Pool Anpassungen, Rate Limits, Node-Scale, Conntrack-Limits prüfen.

- Layer 5: Session-Affinity reduzieren, Session Store Failover, TTLs anpassen, Retry-Storm stoppen.

- Layer 6: Zertifikatsrotation, Chain-Fix, mTLS Policy Rollback, Client-Kompatibilitätsmatrix.

- Layer 7: Retry/Backoff korrigieren, Circuit Breaker aktivieren, Feature Flag zurückrollen, Cache-Control prüfen.

Anti-Patterns, die MTTR trotz Evidence Pack hoch halten

Selbst ein gutes Template scheitert, wenn es falsch betrieben wird. Diese Anti-Patterns erhöhen die MTTR typischerweise, obwohl „alles dokumentiert“ ist.

- Zu groß, zu langsam: 30 Dashboards pro Layer sind im Incident unbenutzbar.

- Kein Ownership: niemand pflegt Queries/Links; nach Tool-Updates ist alles veraltet.

- Keine Segmentierung: globale Mittelwerte verdecken Regional- oder Client-spezifische Fehler.

- Keine Baseline: ohne Vergleichswerte werden normale Schwankungen als Incident fehlinterpretiert.

- Keine Übung: Evidence Packs werden erst im echten Incident „entdeckt“ statt regelmäßig getestet.

Operationalisierung: Wie Sie das Evidence Pack in 30 Tagen stabil etablieren

Sie müssen nicht alles auf einmal perfektionieren. Starten Sie mit einem Minimal Pack pro Layer, testen Sie es in GameDays oder Postmortems und erweitern Sie gezielt. Entscheidend ist ein wiederholbarer Prozess: Pack nutzen, Lücken notieren, Pack verbessern.

- Woche 1: Minimal-Signale definieren, Entry Point bauen, Standardfilter festlegen.

- Woche 2: Synthetics pro Layer ergänzen (DNS, TLS, Ingress, Service Call), Baselines erzeugen.

- Woche 3: Change-Korrelation integrieren, Ticket-Templates und Eskalationspfade verlinken.

- Woche 4: Incident-Simulation, Review mit On-Call, harte Kürzung unnützer Artefakte.

Qualitätskriterien: Woran Sie erkennen, dass die MTTR wirklich sinkt

Wenn das Evidence Pack wirkt, sehen Sie nicht nur eine bessere MTTR-Zahl, sondern auch bessere Zusammenarbeit: weniger Ping-Pong zwischen Teams, weniger „gefühlt Netzwerk“, mehr reproduzierbare Hypothesen. Gute Indikatoren sind „Time to First Strong Evidence“ und „Time to Correct Owning Team“.

- Time to First Strong Evidence: wie schnell liegt ein starker Beleg vor (z. B. TLS-Handshake-Fehlerklasse, Flow-Drop-Reason, Retransmission-Spike)?

- Time to Correct Escalation: wie schnell landet das Incident beim richtigen Owner (Ingress, DNS, App, Provider)?

- Rollback-Qualität: weniger „blindes“ Rollback, mehr gezielte Mitigation.

- Postmortem-Dichte: weniger spekulative Ursachen, mehr belegte Kausalität durch Artefakte.

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.