Ein OSI-basiertes Incident-Runbook-Template ist für SRE-, SecOps- und Plattformteams besonders wertvoll, weil es in Stresssituationen eine klare Reihenfolge vorgibt: erst Konnektivität und Transport verifizieren, dann TLS/Session, dann HTTP/Anwendung, und dabei jederzeit Hypothesen sauber dokumentieren. Das Hauptkeyword „OSI-basiertes Incident-Runbook-Template“ steht für einen Ansatz, der die häufigste On-Call-Falle verhindert: sofort in Applikationslogs zu springen, obwohl das Problem möglicherweise bei DNS, Routing, TCP, TLS oder einem vorgeschalteten Control Point liegt. Gleichzeitig hilft ein OSI-orientiertes Runbook, Zuständigkeiten effizient zu klären (Netzwerkteam, Plattformteam, Applikationsteam, Provider), weil Symptome pro Schicht typischerweise andere Hebel und andere Telemetrie benötigen. Dieses Template ist Copy-Paste-ready, aber bewusst so geschrieben, dass es in unterschiedlichen Stacks (Kubernetes, VM-basiert, Service Mesh, CDN/Edge, API Gateway) funktioniert. Sie können es direkt in Ihr internes Wiki übernehmen und pro Service mit Links auf Dashboards, Pager/On-Call-Rotation, Ownership und konkrete Kommandos ergänzen. Ziel ist ein Runbook, das On-Call nicht nur „Checklisten“ liefert, sondern Entscheidungen beschleunigt, Eskalationen sauber begründet und Post-Incident-Arbeit strukturiert vorbereitet.

Runbook-Metadaten und Einsatzbereich

- Runbook-Name: OSI-basiertes Incident-Runbook-Template

- Gilt für: Web/API-Services, interne Services, Edge/Gateway-Setups, Microservices

- Primäres Ziel: Schnell isolieren, ob Ursache eher Layer 3/4/5/6 (Netzwerk/Transport/TLS) oder Layer 7 (HTTP/App/Downstream) ist

- Voraussetzung: Zugriff auf Monitoring (Metriken), Logs (Edge/Gateway/App), ggf. Traces; On-Call darf Mitigations ausführen

- Artefakte: Incident-Log (Timeline), Hypothesenliste, Maßnahmenliste, Status-Updates

Incident-Start: Triage in den ersten 5 Minuten

- Incident-ID: [eintragen]

- Startzeit (UTC): [eintragen]

- Impact: [User Impact / Business Impact / interne Systeme]

- Betroffene Komponenten: [Service, Region, Cluster, Gateway, CDN, DB, externe Provider]

- Symptome: [Timeouts? 5xx? 4xx? Latenzspikes? nur bestimmte Regionen?]

- Erste Hypothese: [Netzwerk/Transport/TLS vs. App/Downstream]

Kommunikation und Rollen

- Incident Commander: [Name/Handle]

- Ops/SRE On-Call: [Name/Handle]

- App Owner: [Team/Name]

- Netzwerk/Plattform Owner: [Team/Name]

- Comms/Status: [Statuspage/Slack/Teams Kanal]

- Update-Cadence: alle [15] Minuten oder bei wesentlicher Änderung

Definitionen: Good/Bad und Erfolgskriterien

Damit Maßnahmen und Messungen konsistent bleiben, definieren Sie zu Beginn, was als „erfolgreich“ gilt. Für HTTP-Semantik ist RFC 9110 hilfreich, um Statuscodes konsistent zu interpretieren.

- Erfolg: [z. B. 2xx/3xx, oder business-spezifisch 2xx + erwarteter Payload]

- Fehler: [z. B. 5xx, Timeouts, TLS-Fehler, DNS-Fehler, 429/403 je nach Kontext]

- Primäre SLIs: Error Rate, Timeout Rate, P95/P99 Latenz, Erfolgsquote synthetischer Checks

OSI-basierte Diagnose-Reihenfolge: Überblick

- Layer 7 Symptome können durch Layer 3–6 Ursachen entstehen (z. B. 502/504 vom Proxy).

- Beginnen Sie mit Erreichbarkeit und Handshake (DNS/TCP/TLS), bevor Sie in App-Debugging abtauchen.

- Dokumentieren Sie nach jedem Schritt: Beobachtung, Hypothese, nächster Test, Maßnahme.

Layer 1–2: Host/Link/Node-Health (selten, aber wichtig)

In Cloud-Umgebungen sind Layer-1/2-Probleme meist indirekt sichtbar (knotenspezifische Drops, MTU-Mismatches, NIC/Kernel-Themen). Sie sind häufig „partiell“: nur einzelne Nodes oder AZs sind betroffen.

- Symptom-Indikatoren: nur einzelne Pods/VMs betroffen; stark abweichende Latenz auf wenigen Hosts; sporadische Verbindungsabbrüche

- Checks:

- Betroffene Nodes/VMs identifizieren (Top Outliers nach Fehler/Latenz)

- Node-Drain/Reschedule als schneller A/B-Test (verbessert sich der Zustand?)

- MTU-/Encapsulation-Themen prüfen, wenn nur bestimmte Pfade/Services betroffen sind

- Mitigations:

- Traffic von auffälligen Nodes wegnehmen (Drain/cordon)

- Skalieren/Reschedule, um „bad actors“ zu umgehen

Layer 3: Routing, IP-Connectivity, Segmentierung

Layer-3-Probleme führen häufig zu Timeouts, nicht zu sauberen HTTP-Fehlercodes. Sie sind oft regional oder netzsegmentiert (bestimmte Subnets, AZs, Provider, VPN, Peering).

- Symptom-Indikatoren: Timeout-Spikes; starke Regionalität; synthetische Checks aus bestimmten Regionen schlagen fehl

- Checks:

- Ist der Dienst aus mehreren Regionen/Netzen erreichbar?

- Sind nur bestimmte Quellnetze (ASN/ISP) betroffen?

- Flow-Logs/Firewall-Events prüfen (drops, denies)

- Letzte Changes an Routen/Peering/NAT/Security Policies prüfen

- Mitigations:

- Traffic-Shifting auf gesunde Regionen/Paths

- Rollback der letzten Netzwerkpolicy-Änderung, wenn klar korreliert

- Failover auf alternativen egress/peering, falls vorhanden

Layer 4: TCP/UDP/QUIC – Transport und Verbindungsaufbau

Transportprobleme sind eine der häufigsten Ursachen für „mysteriöse“ Latenzspikes und sporadische 502/504. Typische Themen sind Retransmits, Resets, Conntrack-Limits, Port-Exhaustion und ungünstige Timeouts.

- Symptom-Indikatoren: Connect-Timeouts; erhöhte Retransmits; RST-Spikes; „connection refused“

- Checks:

- Connect-Zeiten (p95/p99) und Timeout-Raten prüfen

- Retransmit-/Reset-Metriken prüfen (wenn verfügbar)

- Load-Balancer Health/Target-Status prüfen

- Conntrack/Connection Limits prüfen (Cluster/Nodes/LB)

- Mitigations:

- Skalieren (mehr Targets reduziert Queueing und Connection Pressure)

- Timeout-/Keep-Alive-Tuning (vorsichtig, mit Rollback)

- Traffic drosseln oder priorisieren, um Sättigung zu reduzieren

Layer 5–6: Session/TLS – Handshake, Zertifikate, ALPN, mTLS

TLS-Themen wirken oft wie „Service down“, obwohl die App gesund ist. Besonders nach Zertifikatswechseln oder Proxy-Updates entstehen plötzlich client-spezifische Ausfälle. Für TLS-Details ist RFC 8446 eine verlässliche Referenz.

- Symptom-Indikatoren: TLS handshake failed; certificate verify failed; mTLS rejects; nur bestimmte Clients betroffen

- Checks:

- Zertifikatgültigkeit/Chain/Expiry prüfen

- SNI-Routing prüfen (zeigt SNI auf das erwartete Backend?)

- ALPN/HTTP2/HTTP3-Verteilung prüfen (nur bestimmte Protokolle betroffen?)

- mTLS-Policies und Trust Stores prüfen (gab es Changes?)

- Mitigations:

- Rollback auf vorherige Zertifikats-/TLS-Konfiguration, wenn sicher

- Temporäre Kompatibilitäts-Policy (nur wenn Risiko vertretbar und dokumentiert)

- Traffic auf alternative Termination (anderer Edge/Region) shiften

Layer 7: HTTP/Applikation – wenn Requests ankommen, aber falsch/zu langsam beantwortet werden

Layer-7-Probleme zeigen sich häufig als konsistente 5xx/4xx-Muster, erhöhte App-Latenz, Sättigung, Regressionen nach Deployments oder Downstream-Ausfälle. Wichtig ist, die Frage zu beantworten: „Kommt der Request an?“ Wenn nein, sind die vorherigen Layer wahrscheinlicher.

- Symptom-Indikatoren: 5xx-Spikes; Latenz P95/P99 steigt; spezifische Routen betroffen; Fehler korrelieren mit Deploy/Config

- Checks:

- App-Access-Logs: sehen Sie Requests mit Request-ID/Trace-ID?

- Segmentierung: welche Route/Version/Region/Client-Kohorte treibt den Fehler?

- Ressourcen: CPU, Memory, Threadpools, DB-Connections, Queue Depth

- Downstreams: Traces/Spans auswerten (DB, Cache, externe APIs)

- Retries/Timeouts: verstärken Retries die Last (Retry-Sturm)?

- Mitigations:

- Rollback von Deploy/Feature-Flag/Config, wenn korreliert

- Graceful Degradation: teure Features abschalten, statische Fallbacks aktivieren

- Rate Limiting/Load Shedding, um System zu stabilisieren

- Circuit Breaker schärfen, um Downstream-Kaskaden zu verhindern

DNS als vorgelagerter Spezialfall: Schnellchecks und typische Fehlerbilder

DNS wird im Incident oft als „Netzwerkproblem“ behandelt, weil es vor dem Connect entscheidet. Gerade CNAME-Ketten, TTL-Strategien und Resolver-Probleme können große Teile des Traffics betreffen. Grundlagen finden Sie in RFC 1034 und RFC 1035.

- Symptom-Indikatoren: SERVFAIL/Timeout; NXDOMAIN unerwartet; Lookup-Latenz steigt; nur bestimmte ISPs betroffen

- Checks:

- DNS-Auflösung aus mehreren Regionen/Resolvern prüfen

- TTL/CNAME-Kette prüfen (unerwartet lang?)

- Änderungen an DNS Records/Provider in den letzten [X] Stunden prüfen

- Mitigations:

- Failover auf Secondary DNS/Provider (wenn vorbereitet)

- Rollback falscher Records

- Temporäre TTL-Anpassung (vorsichtig; dokumentieren)

Mitigation-Playbook: Standardaktionen (sicher, reversibel, dokumentiert)

Unabhängig von der OSI-Schicht sollten Mitigations drei Eigenschaften haben: reversibel, beobachtbar, und mit klarer Abbruchbedingung. Diese Liste ist als Copy-Paste-Katalog gedacht.

- Traffic-Shifting: auf andere Region/PoP/Cluster umleiten; Abbruchkriterium: Fehler/Latenz normalisieren sich nicht innerhalb [X] Minuten

- Rollback: letzter Deploy/Config/Policy-Change; Abbruchkriterium: keine Verbesserung, oder Nebenwirkungen steigen

- Scale Out: zusätzliche Kapazität; Abbruchkriterium: keine Wirkung auf Queueing/Latenz

- Load Shedding: teure Endpunkte drosseln; Abbruchkriterium: kritische Journey bleibt nicht stabil

- Feature Degradation: nichtkritische Features deaktivieren; Abbruchkriterium: Kernfunktion weiterhin beeinträchtigt

- Timeout/Retry Tuning: nur mit Canary/kleinem Scope; Abbruchkriterium: Retries/Fehler steigen

Dokumentations-Template: Timeline, Hypothesen, Entscheidungen

- Timeline:

- [Zeit] Alarm ausgelöst: [Signal, Schwelle]

- [Zeit] Erste Einschätzung: [Impact, Scope]

- [Zeit] Hypothese 1: [Layer, Begründung]

- [Zeit] Test 1: [Ergebnis]

- [Zeit] Mitigation 1: [Aktion, Scope]

- [Zeit] Ergebnis: [Metriken verbessert?]

- Hypothesenliste:

- H1: [Layer 3/4/5/6/7] – Indikatoren: [..] – Nächster Test: [..]

- H2: [Layer ..] – Indikatoren: [..] – Nächster Test: [..]

- Entscheidungen:

- [Zeit] Entscheidung: [z. B. Traffic-Shifting] – Grund: [Beobachtung] – Risiko: [..] – Rollback: [..]

Observability-Checkliste: Pflichtsignale, die jedes Team verlinken sollte

Dieses Runbook wird erst dann wirklich schnell, wenn Sie pro Service feste Links zu Dashboards und Log-Queries pflegen. Als Template können Sie folgende Pflichtsignale je Service hinterlegen:

- Edge/Gateway: Requests/s, 4xx/5xx/429, Upstream-Fehlergründe, WAF/Policy-Actions

- Netzwerk/Transport: Connect-Time, Timeout-Rate, Retransmits/Resets (wenn vorhanden), LB Health

- TLS: Handshake Success Rate, Handshake Latency, Zertifikat-Expiry

- App: Error Rate, Latenz P95/P99, CPU/Memory, Threadpools, Queue Depth

- Downstreams: DB-Latenz, Cache Hit Rate, externe API-Fehler/Latenz

- Synthetik: Multi-Region Checks für DNS→TCP→TLS→HTTP

Eskalationsmatrix: Wann welches Team hinzugezogen wird

- Layer 3/4 Indikatoren (Timeouts, Connect-Fails, Regionalität): Plattform/Netzwerkteam + Cloud/Provider-Support

- Layer 5/6 Indikatoren (TLS-Handshake, Zertifikatsfehler, mTLS): Plattform/PKI/Edge-Team

- Layer 7 Indikatoren (5xx, Regression, DB): App-Team + DB/Infra-Team

- Security-Indikatoren (WAF-Spikes, DDoS/Bot): SecOps + Edge/WAF-Owner

Post-Incident-Template: RCA-Inputs, die Sie während des Incidents sammeln

Um spätere RCA-Arbeit zu beschleunigen, sammeln Sie bereits im Incident strukturierte Daten. Das reduziert „Memory-based RCA“ und macht Verbesserungen schneller umsetzbar.

- Trigger: Was hat den Incident gestartet (Change, Traffic-Spike, Provider-Issue)?

- Blast Radius: Welche Regionen/Clients/Routes waren betroffen?

- Detection Gap: Welche Signale fehlten oder waren zu spät/noisy?

- Mitigation: Welche Aktionen haben geholfen, welche nicht?

- Prevention: Welche Guardrails (Canary, Limits, Failover-Tests) hätten das verhindert?

Outbound-Links für vertiefende Orientierung

- OSI model für Schichtdefinitionen und Zuordnung von Protokollen

- RFC 9110 (HTTP Semantics) für konsistente Interpretation von Statuscodes und HTTP-Verhalten

- RFC 8446 (TLS 1.3) für TLS-Handshake, Zertifikatskonzepte und Failure Modes

- RFC 9293 (TCP) für Transportverhalten, Retransmits und Verbindungslogik

- RFC 1034 und RFC 1035 für DNS-Konzepte, Records und typische Fehlerbilder

- Google SRE Workbook: Alerting on SLOs für Burn-Rate-basierte Alarmierung und Runbook-taugliche SLO-Alerts

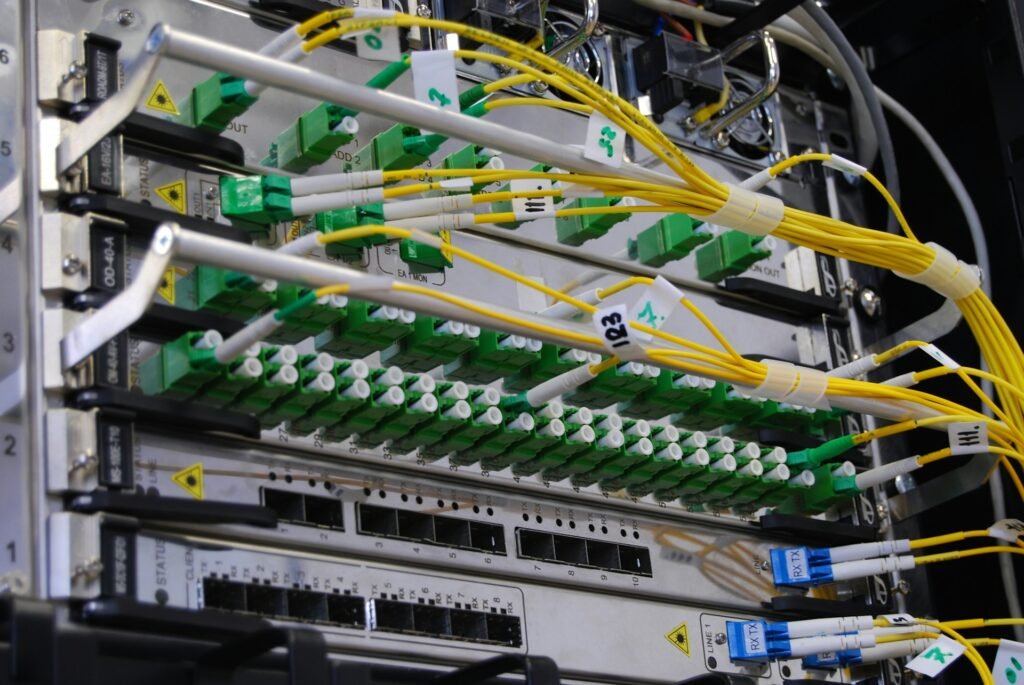

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.