Das Hauptkeyword „OSI-Modell für DC/ISP-Operatoren“ klingt auf den ersten Blick nach Lehrbuchstoff – in der Praxis ist es jedoch eines der robustesten Denkmodelle, um Störungen in großen Rechenzentren (DC) und Provider-Netzen (ISP) schnell einzugrenenzen. Wer in NOC, SOC, Data-Center-Operations oder Backbone-Engineering arbeitet, kennt das Problem: Eine Meldung wie „Service langsam“ oder „Verbindungen brechen ab“ ist zu unscharf, um direkt die richtige Maßnahme zu treffen. Gleichzeitig ist das System hochkomplex: Underlay/Overlay, BGP/EVPN, L2/L3, Anycast, Load Balancer, Firewalls, TLS, Microservices, Abhängigkeiten zu DNS und Identitäten – und all das über viele Standorte hinweg. Das OSI-Modell liefert hier ein skalierbares Framework zur Störungsisolation: Es zwingt Teams, Symptome systematisch einer Schicht zuzuordnen, Messpunkte zu standardisieren und Eskalationspfade klar zu definieren. Der Nutzen ist nicht akademisch, sondern operativ messbar: schnellere Eingrenzung, weniger „War-Room“-Chaos, konsistente Runbooks und eine deutlich bessere Kommunikation zwischen Teams.

Warum das OSI-Modell im Großbetrieb besonders gut funktioniert

Das OSI-Referenzmodell wurde als allgemeines Schichtenmodell für Kommunikationssysteme entwickelt und beschreibt Funktionen von der physikalischen Übertragung bis zur Anwendungsebene. Für den Betrieb ist weniger die historische Entstehung wichtig, sondern die Wirkung: Die Schichten bieten eine gemeinsame Sprache, um Ursachen von Symptomen zu trennen und Hypothesen zu testen. Gerade bei DC/ISP-Skalen sind drei Eigenschaften entscheidend:

- Entkopplung von Symptomen und Ursachen: „Timeout“ kann ein Layer-1-Problem (Fehler auf der Faser), ein Layer-3-Problem (Routing-Loop), ein Layer-4-Problem (Port-Filter) oder ein Layer-7-Problem (Applikations-Threadpool erschöpft) sein.

- Standardisierte Messpunkte: Für jede Schicht lassen sich minimalinvasive Checks definieren, die überall gleich funktionieren (z. B. Optik/CRC auf L1/L2, ICMP/Traceroute auf L3, SYN/SYN-ACK auf L4, HTTP-Statuscodes auf L7).

- Skalierbare Übergaben zwischen Teams: Ein NOC kann sauber formulieren „L1/L2 sauber, L3 zeigt Asymmetrie zwischen PoPs“, statt nur „Internet kaputt“ – das reduziert Reibung und beschleunigt Entscheidungen.

Wenn Sie eine formale Referenz benötigen, finden Sie die OSI-Basisbeschreibung in der ITU-T Recommendation X.200 über passenden Anchor-Text: ITU-T X.200 (OSI Basic Reference Model).

Das Betriebsziel: Störungsisolation statt Vollanalyse

In der Incident Response ist die zentrale Frage selten „Was ist die endgültige Root Cause?“, sondern zunächst: Wo liegt die wahrscheinlichste Fehlerdomäne und welches Team kann mit den richtigen Tools schnell Stabilität wiederherstellen? Das OSI-Modell ist dafür ideal, weil es Störungsisolation strukturiert. Ein praxistaugliches Zielbild lautet:

- In 5–10 Minuten: Schichtzuordnung (z. B. „L3-Routing-Anomalie im Core“).

- In 15–30 Minuten: Fehlerdomäne (z. B. „nur PoP Berlin“, „nur ein Leaf-Paar“, „nur Kunden mit IPv6“).

- In 30–60 Minuten: Stabilisierung (Rollback, Traffic-Shift, Rate-Limits, Degradation-Mode).

Root Cause Analysis folgt danach in Ruhe. Diese Trennung verhindert, dass Teams in Details abtauchen, während der Dienst noch brennt.

Schichtbasierte Diagnose im DC/ISP-Kontext

Layer 1: Physical – „Strom, Licht, Signal“

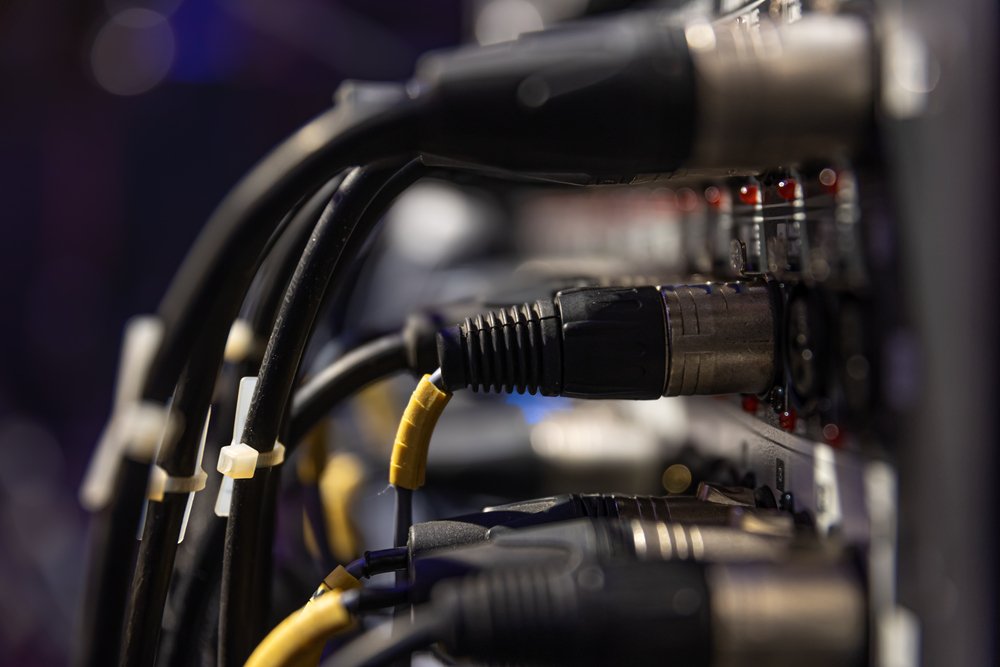

Layer 1 ist häufig unterschätzt, weil moderne Umgebungen viel Virtualisierung darüber stapeln. Dennoch sind L1-Fehler im Großbetrieb tückisch: Sie wirken wie „random packet loss“, „flapping links“ oder „sporadische Latenzspitzen“. Typische Signale und Checks:

- Optische Parameter: Rx/Tx-Power, SNR, BER, DOM-Werte an Transceivern.

- Link-Flaps: Interface up/down, LOS/LOF, PCS-Fehler, FEC-Counter.

- Umwelt: Temperatur, Biegeradien, Patchpanel, Staub, Stromversorgung im Rack.

Operativ wichtig: L1-Probleme erzeugen oft L2/L3-Symptome. Deshalb sollte jedes Runbook mit L1/L2-Health starten, bevor komplexe Routing-Hypothesen aufgebaut werden.

Layer 2: Data Link – „Frames, VLANs, MAC, EVPN“

In Data Centern spielt Layer 2 oft über EVPN/VXLAN oder klassische VLAN/Trunk-Topologien. Häufige Fehlerbilder sind Broadcast-Stürme, MAC-Flapping, MTU-Mismatches oder fehlerhafte LAG-Konfigurationen. Praxischecks:

- CRC/FCS-Fehler: deuten auf physikalische Störungen oder Duplex/Encoding-Probleme hin.

- MTU/Fragmentierung: VXLAN-Overhead führt bei unpassender MTU zu Drop/Blackholing.

- STP/Loop-Events: selten in modernen Leaf-Spine-Designs, aber bei Mischumgebungen relevant.

- EVPN-Indikatoren: inkonsistente MAC/IP-Routen, ARP/ND-Suppression-Fehler, VTEP-Reachability.

Für eine kompakte, praxisnahe Übersicht der OSI-Schichten mit Beispielen ist dieser externe Einstieg hilfreich: OSI Model Reference Chart (Cisco Learning Network).

Layer 3: Network – „Routing, IP, BGP, IGP, Anycast“

In ISP- und DC-Backbones ist Layer 3 oft die größte Fehlerfläche: BGP-Policy, Route Leaks, falsche Communities, IGP-Konvergenz, ECMP-Hashing, Asymmetrien. Typische Symptome sind „einige Ziele erreichbar, andere nicht“, „nur ein Teil der Kunden betroffen“, „Latenz über Umwege“. Bewährte Checks:

- Reachability: ICMP (wo erlaubt), TCP-Connect-Tests, Synthetic Probes aus mehreren PoPs.

- Pfad-Analyse: Traceroute/MTR (mit Vorsicht bei ICMP-Rate-Limits), BGP Looking Glass intern, Segment-Routing-Paths.

- Kontroll- vs Datenebene: „BGP Session up“ heißt nicht „Forwarding korrekt“. FIB/TCAM-Auslastung und RIB/FIB-Consistency prüfen.

- Blast Radius: Ist der Fehler standortbezogen, prefixbezogen (nur bestimmte Netze) oder protokollbezogen (nur IPv6)?

Für großskalige Netzwerkphilosophie und „Simplicity Principle“ als Leitlinie lohnt ein Blick in die IETF-Perspektive: RFC 3439 (Internet Architectural Guidelines). Im Betrieb ist „einfach“ oft gleichbedeutend mit „schnell isolierbar“.

Layer 4: Transport – „Ports, TCP/UDP, NAT, Load Balancing“

Layer 4 entscheidet häufig darüber, ob Nutzer „es geht“ oder „es hängt“ erleben. Klassische Fallen sind Port-Blocks, State-Table-Exhaustion, asymmetrisches Routing in Kombination mit Stateful Firewalls, oder Load-Balancer, die Health Checks bestehen, aber echte Flows verlieren. Wichtige Checks:

- Handshake: SYN/SYN-ACK/ACK (TCP) – lässt sich sauber messen und korreliert stark mit „Connectivity“.

- Retransmits/Zero Window: Hinweise auf Congestion, Bufferbloat oder Server-Overload.

- Conntrack/State: Auslastung von NAT/Firewall-State, Drops wegen Limits, Timeouts.

- Load-Balancer-Ebene: L4 vs L7 LB unterscheiden; Hash-Algorithmen und Source-NAT verstehen.

Praxis-Tipp: Definieren Sie pro kritischem Service einen „goldenen“ L4-Test (z. B. TCP-Connect auf Port 443 von drei unabhängigen Messpunkten). Das ist oft schneller und verlässlicher als ein komplexer HTTP-Test, wenn die Frage zunächst nur „kommt überhaupt etwas durch?“ lautet.

Layer 5–7: Session, Presentation, Application – „TLS, HTTP, DNS, APIs“

Im Alltag werden die oberen OSI-Schichten häufig zusammengefasst, weil moderne Protokolle Funktionen bündeln. Für die Störungsisolation ist die Trennung dennoch nützlich:

- „Session“-Aspekte: Authentifizierungs-Sessions, Sticky Sessions am Load Balancer, WebSockets/Long Polling.

- „Presentation“-Aspekte: TLS-Versionen, Zertifikatsketten, Cipher Suites, Content-Encoding, Kompression.

- „Application“-Aspekte: HTTP-Statuscodes, gRPC-Errors, Datenbank-Latenzen, Queue-Backlogs, Rate-Limits.

Ein häufiger Großbetriebsfehler: Layer-7-Symptome werden vorschnell als „Netzwerkproblem“ eskaliert. Umgekehrt werden echte L3/L4-Probleme als „App ist kaputt“ abgetan. Deshalb sind saubere Übergabekriterien wichtig, etwa: „TLS-Handshake scheitert bereits (L5/6), HTTP-Request kommt nicht zustande (L7 nicht erreichbar)“.

Für eine leicht verständliche, aber technisch korrekte OSI-Erklärung als externe Referenz eignet sich: Was ist das OSI-Modell? (Cloudflare Learning Center).

Ein OSI-basiertes Framework zur Störungsisolation im großen Maßstab

Damit das OSI-Modell im Betrieb wirklich skaliert, braucht es mehr als „Wir denken in Schichten“. Bewährt hat sich ein Framework aus vier Bausteinen, das in Runbooks, Monitoring und On-Call-Übergaben fest verankert wird.

Baustein 1: Symptom → Schicht → Hypothese (standardisiertes Triage-Template)

Definieren Sie ein einheitliches Triage-Template, das jede Incident-Beschreibung zwingend ergänzt. Beispielstruktur:

- Symptom: „HTTP 503 steigt“, „Timeouts“, „Packet loss“, „nur IPv6 betroffen“

- Schicht-Verdacht: L3/L4/L7 (oder „unklar, starte L1→L7 Checks“)

- Scope/Blast Radius: Region/PoP, bestimmtes ASN, bestimmter Service, nur ein AZ

- Erste Messpunkte: 3–5 definierte Checks mit Ergebnissen

Wichtig ist dabei nicht Perfektion, sondern Reproduzierbarkeit. Ein guter On-Call kann in Minuten sehen, ob bereits „unten“ geprüft wurde oder ob noch Grundlagen fehlen.

Baustein 2: Messpunkt-Matrix pro Schicht (Golden Signals für Netzwerk)

Erstellen Sie eine Matrix, die pro OSI-Schicht wenige, aber verlässliche Signale festlegt. Die Matrix sollte unternehmenseinheitlich sein, damit NOC, DC-Operations und Engineering dieselbe Sprache sprechen. Beispiel (verkürzt):

- L1: Optik (Rx/Tx), FEC/BER, Link-Flaps

- L2: CRC/FCS, MAC-Flap-Rate, MTU-Errors

- L3: BGP/IGP-Konvergenz, Prefix-Reachability, ECMP-Imbalance

- L4: TCP-Handshake-Success-Rate, Retransmits, State-Table-Utilization

- L7: Error-Rate nach Endpoint, p95/p99-Latenz, Abhängigkeiten (DNS/IdP)

Diese Signale gehören ins Monitoring-Dashboard – nicht als „nice to have“, sondern als erste Startseite im Incident.

Baustein 3: Entscheidungsregeln und Übergabepunkte (Eskalation ohne Reibung)

Skalierbarkeit entsteht, wenn Übergaben klar sind. Definieren Sie für jede Schicht objektive Kriterien, wann die Ownership wechselt. Beispiele:

- Von App zu Netzwerk: Mehrere unabhängige L4-Connect-Tests schlagen fehl, während Server-Health intern grün ist.

- Von Netzwerk zu DC/Facility: Link-Flaps + Optik außerhalb Toleranz + physische Pfadkorrelation (gleicher Patchpanel-Strang).

- Von NOC zu Backbone-Engineering: BGP-Anomalie betrifft mehrere PoPs oder zeigt Policy-/Leak-Muster.

Die Regeln müssen in Tickets/Chats miterfasst werden, damit später nachvollziehbar ist, warum eskaliert wurde.

Baustein 4: „Isolation First“-Mechanismen (Traffic-Shift, Degradation, Rollback)

Im Großbetrieb ist das schnellste Fix oft nicht „Reparieren“, sondern „Isolieren“: Traffic wegnehmen, betroffene Zone aus dem Pool nehmen, Route-Policy zurückrollen, Feature-Flag deaktivieren. OSI hilft, diese Maßnahmen gezielt zu wählen:

- L1/L2-Indikatoren: betroffene Links/Ports deaktivieren, LAG-Mitglied entfernen, Ersatzpfad erzwingen.

- L3-Indikatoren: BGP-Announcements anpassen, Traffic per Anycast/PoP-Drain shiften, IGP-Metriken setzen.

- L4/L7-Indikatoren: LB-Pool reduzieren, Rate-Limits aktivieren, Circuit Breaker schärfen, Degradation-Mode nutzen.

MTTR messbar verbessern: ein einfaches Rechenmodell mit MathML

Um den Nutzen eines OSI-basierten Incident-Frameworks gegenüber Stakeholdern zu belegen, hilft eine einfache Kennzahl: Mean Time To Restore (MTTR). Eine praxisnahe Zerlegung ist die Summe aus Erkennungszeit, Eingrenzungszeit und Wiederherstellungszeit:

MTTR = T(Detect) + T(Isolate) + T(Restore)

Das OSI-Modell zielt primär auf T(Isolate) ab: Wenn Teams schneller die richtige Schicht und Domäne finden, sinkt die Eingrenzungszeit deutlich. Gerade bei verteilten Systemen ist das oft der größte Hebel.

Typische Stolpersteine und wie Sie sie OSI-konform vermeiden

- „Alles ist Layer 7“: Wenn HTTP-Fehler steigen, starten viele sofort im Code. OSI-konform heißt: erst L4-Handshake und L3-Reachability als Basis verifizieren.

- ICMP ist kein Allheilmittel: ICMP kann gefiltert oder priorisiert sein. Ergänzen Sie es durch TCP-basierte Tests, die näher am echten Traffic sind.

- Asymmetrisches Routing ignoriert Statefulness: In ISP/DC-Designs ist Asymmetrie normal. Problematisch wird sie, wenn Firewalls/NAT/LBs stateful arbeiten. OSI hilft, diese Kopplung (L3↔L4) bewusst zu prüfen.

- MTU-Fehler als „komische App-Bugs“: PMTUD-Probleme wirken wie zufällige Timeouts, oft nur bei großen Responses oder bestimmten Endpunkten. Ein definierter MTU-Check spart Stunden.

- Unklare Ownership: Ohne feste Übergabekriterien eskaliert man im Kreis. OSI-konforme Regeln reduzieren Ping-Pong erheblich.

Praxis-Checkliste für On-Call und NOC (OSI als Runbook-Skelett)

- Start: Scope klären (Region/PoP/Service/IPv4/IPv6) und 3 Messpunkte aus unterschiedlichen Perspektiven wählen.

- L1/L2 prüfen: Link-Flaps, Optik, CRC/FCS, MTU-Indikatoren, LAG-Status.

- L3 prüfen: Routing-Health (BGP/IGP), Reachability, Pfadänderungen, Asymmetrien, ECMP.

- L4 prüfen: TCP-Handshake-Rate, Retransmits, State-Table, Port/ACL-Änderungen.

- L7 prüfen: Fehlercodes, Abhängigkeiten (DNS, Auth, Datenbanken), Release- oder Config-Änderungen.

- Isolieren: Traffic-Shift/Drain, Rollback, Pool-Reduktion, Degradation aktivieren.

- Dokumentieren: Symptom → Schicht → Hypothese → Messpunkte → Maßnahme in einheitlichem Format.

Wenn diese Checkliste konsequent in Tickets, ChatOps und Dashboards abgebildet wird, entsteht ein belastbares Betriebsmodell: Das „OSI-Modell für DC/ISP-Operatoren“ wird vom Schulwissen zum Framework, das Störungen im großen Maßstab beherrschbar macht – reproduzierbar, teamübergreifend und messbar in kürzerer Wiederherstellungszeit.

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.