Spine-Leaf-Architektur ist heute das Standardmuster, wenn Unternehmen moderne Netzwerke im Rechenzentrum planen, die auf hohe Ost-West-Verkehre, Virtualisierung, Container-Plattformen und skalierbare Cloud-Workloads vorbereitet sind. Während klassische dreistufige Rechenzentrumsdesigns (Core/Distribution/Access) historisch oft auf Nord-Süd-Traffic ausgelegt waren, haben sich die Datenflüsse verändert: Microservices, verteilte Datenbanken, Storage-Cluster und Service-Mesh-Kommunikation erzeugen enorme Kommunikation zwischen Servern und Workloads innerhalb des Rechenzentrums. Genau hier spielt die Spine-Leaf-Architektur ihre Stärken aus: eine vorhersehbare Latenz, eine klare Skalierungslogik durch Hinzufügen weiterer Leaf- oder Spine-Switche und eine hohe Ausfallsicherheit durch parallele Pfade. Allerdings ist ein Spine-Leaf-Fabric nicht automatisch „besser“, wenn Anforderungen, Routing-Design, Segmentierung, Verkabelung und Betrieb nicht sauber mitgedacht werden. Dieser Leitfaden erklärt, wie Sie eine Spine-Leaf-Architektur im Rechenzentrum sinnvoll planen, welche Designentscheidungen wirklich zählen und wie Sie Performance, Stabilität und Sicherheit von Anfang an richtig ausrichten.

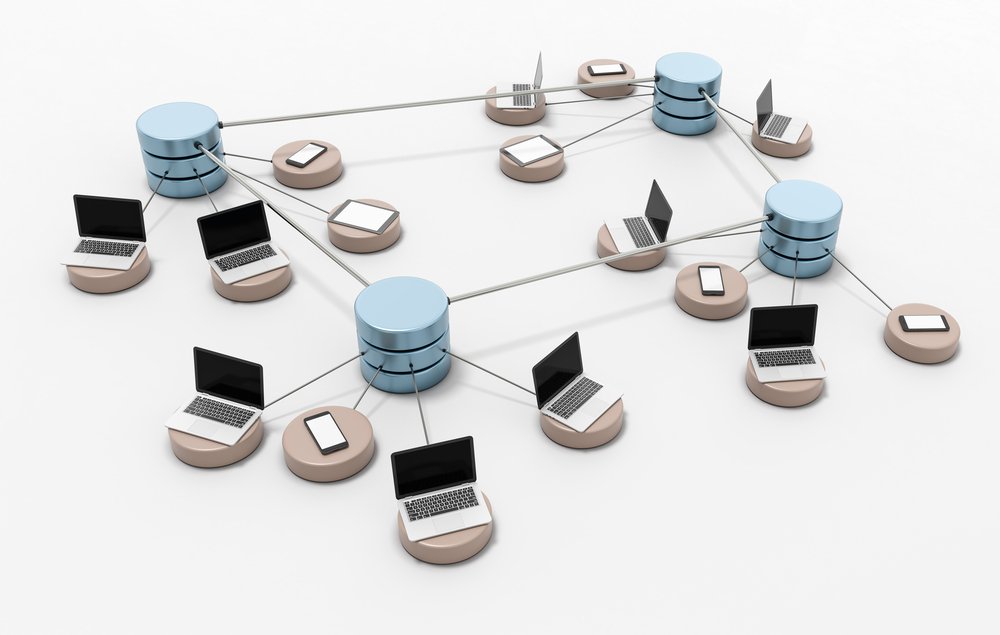

Was ist eine Spine-Leaf-Architektur?

Spine-Leaf beschreibt ein zweischichtiges Fabric-Design: Leaf-Switche bilden die Zugangs- und Aggregationsschicht für Server, Storage und Appliances. Spine-Switche bilden den Backbone, an den jeder Leaf redundant angebunden ist. Es gibt in der Regel keine direkten Verbindungen zwischen Leafs untereinander oder zwischen Spines untereinander. Dadurch entstehen gleichwertige Pfade zwischen Leafs, die Routing zur Lastverteilung nutzen können.

- Leaf: Anschluss von Servern, Hypervisoren, Storage-Arrays, Firewalls, Load Balancern und weiteren DC-Komponenten.

- Spine: hochperformanter Backbone für den Transit zwischen Leafs, meist mit hoher Portdichte und hoher Bandbreite.

- Fabric: Gesamtsystem aus Leafs und Spines plus Routing/Overlay-Mechanik, Monitoring und Betriebsstandards.

Viele technische Grundlagen für Routing, Transport und Skalierung in IP-Netzen werden in den offenen Spezifikationen der IETF-Standards beschrieben und sind eine gute Basis, um herstellerneutral zu planen.

Warum Spine-Leaf im Rechenzentrum so gut skaliert

Skalierbarkeit im Rechenzentrum bedeutet vor allem: mehr Workloads, mehr Bandbreite, mehr Ost-West-Traffic – ohne dass Latenz unberechenbar wird oder Umbauten das gesamte Netzwerk betreffen. Spine-Leaf ist dafür geeignet, weil es ein klares, wiederholbares Muster bietet.

- Vorhersehbare Latenz: Jede Leaf-zu-Leaf-Kommunikation läuft typischerweise über genau einen Spine-Hop.

- Horizontale Skalierung: Mehr Leafs für mehr Serverports, mehr Spines für mehr Fabric-Kapazität.

- Hohe Ausfallsicherheit: Mehrere gleichwertige Pfade (ECMP) ermöglichen Weiterbetrieb bei Link- oder Gerätausfällen.

- Einfachere Fehlerdomänen: Probleme bleiben oft auf einzelne Links oder Nodes begrenzbar, wenn Design und Betrieb sauber sind.

Spine-Leaf vs. klassisches 3-Schichten-Design im Rechenzentrum

Das klassische Design mit Core/Distribution/Access ist nicht per se falsch, aber es passt oft weniger gut zu modernen Ost-West-Verkehrsmustern. Die Entscheidung ist weniger ideologisch als anwendungsgetrieben: Wie sieht Ihr Traffic aus, und wie schnell müssen Sie skalieren?

- 3-Schichten-Design: gut, wenn Nord-Süd dominiert, wenn die Umgebung klein ist oder wenn ein „Collapsed Core“ ausreichend ist.

- Spine-Leaf: stark bei hohen Ost-West-Verkehren, Virtualisierung/Container, schneller Skalierung und hohen Bandbreitenanforderungen.

- Hybrid-Realität: Viele Unternehmen betreiben Spine-Leaf im DC, während Campus/Standorte weiterhin mit 3-Schichten-Modellen oder Fabrics arbeiten.

Layer 3 als Fundament: Warum moderne Fabrics routen

Ein Kernprinzip moderner Rechenzentrumsnetze ist: Die Fabric ist in der Regel Layer-3-orientiert. Das reduziert klassische Layer-2-Risiken wie große Broadcast-Domänen und Schleifen. Gleichzeitig ermöglicht Layer 3 mehrere gleichwertige Pfade, die für Lastverteilung und Resilienz genutzt werden.

- ECMP (Equal-Cost Multi-Path): Routing verteilt Flows über mehrere gleichwertige Pfade zwischen Leaf und Spine.

- Schnelle Konvergenz: Ausfälle können zügig erkannt und umgangen werden, wenn Topologie und Protokolle sauber gewählt sind.

- Begrenzte Fehlerdomänen: Layer-2-Ausbreitung wird reduziert; Störungen bleiben besser isolierbar.

Wichtig ist die Erwartungssteuerung: ECMP verteilt in der Regel auf Flow-Basis. Ein einzelner sehr großer Flow bleibt auf einem Pfad, während viele parallele Flows die Fabric gut ausnutzen.

Underlay und Overlay: Das moderne Baukastenprinzip

Spine-Leaf-Designs werden häufig als Underlay/Overlay aufgebaut. Das Underlay ist das stabile IP-Transportnetz innerhalb der Fabric. Das Overlay ermöglicht logische Netze (Mandanten, Segmente) über die Fabric hinweg, ohne große Layer-2-Domänen zu bauen. Viele Unternehmen nutzen hierfür EVPN/VXLAN-Ansätze, weil sie Segmentierung und Skalierung gut unterstützen.

- Underlay: IP-Routing zwischen Leaf und Spine, fokussiert auf Stabilität, schnelle Konvergenz und klare Adressierung.

- Overlay: logische Netze und Segmente, oft über Tunnelmechanismen, um Workloads flexibel zu verbinden.

- Policy-/Zonenmodell: Segmentierung und kontrollierte Übergänge, damit Sicherheit und Betrieblichkeit erhalten bleiben.

Für eine saubere Sicherheits- und Governance-Einordnung hilft ein Rahmen wie das NIST Cybersecurity Framework, um Segmentierung, Logging und Resilienz als Teil eines Gesamtmodells zu verankern.

Kapazitätsplanung: Bandbreite, Oversubscription und Wachstum

Ein häufiges Missverständnis ist, dass Spine-Leaf automatisch „unendlich skaliert“. In Wahrheit entscheidet die Kapazitätsplanung: Uplink-Bandbreiten, Oversubscription-Ratios, Portdichte und die geplante Wachstumsrichtung. Gute Planung ist messdatenbasiert: Traffic-Profile, Spitzenlasten und künftige Workload-Anforderungen sollten berücksichtigt werden.

- Oversubscription bewusst wählen: Verhältnis von Server-Port-Kapazität zu Uplink-Kapazität pro Leaf.

- Spine-Kapazität planen: Wie viele Leafs, welche Uplink-Geschwindigkeiten, welche Redundanz?

- Wachstumspfade: Skalierung durch zusätzliche Leafs (mehr Anschlüsse) oder zusätzliche Spines (mehr Fabric-Kapazität).

- Failover-Kapazität: Was passiert bei Ausfall eines Spines oder mehrerer Links? Reicht verbleibende Kapazität für kritische Services?

Best Practice ist, nicht nur „heute“ zu dimensionieren, sondern klare Trigger zu definieren: ab welcher Auslastung werden Uplinks erweitert, wann wird ein zusätzlicher Spine eingeplant, welche Lieferzeiten sind realistisch?

Redundanz und Hochverfügbarkeit: Design ohne versteckte Single Points

Spine-Leaf bietet viele parallele Pfade, aber Hochverfügbarkeit entsteht nur, wenn Redundanz konsequent umgesetzt wird: pro Leaf, pro Spine, in der Verkabelung, im Strom und in kritischen Services. Entscheidend ist außerdem, Failover regelmäßig zu testen.

- Leaf-Redundanz: Server dual-homed an zwei Leafs (bei unterstützter Server-/NIC-Architektur), um Leaf-Ausfälle abzufangen.

- Spine-Redundanz: mindestens zwei Spines, häufig mehr für Kapazität und Resilienz.

- Link-Redundanz: mehrere Uplinks pro Leaf zu jedem Spine, wenn Kapazität und Design es erfordern.

- Physische Diversität: getrennte Strompfade, getrennte Kabelwege, saubere Patch- und Trassenplanung.

Segmentierung im Rechenzentrum: Mandanten, Zonen und sichere Übergänge

Moderne Rechenzentren hosten oft unterschiedliche Sicherheitszonen: interne Anwendungen, DMZ-Workloads, Management-Tools, Datenbanken, Monitoring, Backup und manchmal mandantenfähige Plattformen. Eine Spine-Leaf-Fabric muss diese Zonen abbilden, ohne das Netzwerk zu verkomplizieren.

- Zonenmodell definieren: z. B. App-Zone, Data-Zone, Management-Zone, DMZ, Shared Services.

- Default-Deny zwischen Zonen: Kommunikation explizit erlauben, nicht implizit öffnen.

- Kontrollpunkte festlegen: Firewalling oder Policies dort, wo Übergänge entstehen (z. B. zwischen DMZ und intern).

- Microsegmentation gezielt einsetzen: besonders für kritische Workloads oder stark regulierte Datenbereiche.

Für eine praxisnahe Priorisierung von Sicherheitsmaßnahmen können die CIS Controls hilfreich sein, weil sie in umsetzbare Kontrollbereiche gegliedert sind.

Integration von Firewalls, Load Balancern und Service-Insertion

Rechenzentren enthalten selten nur „Server und Switches“. Firewalls, Load Balancer, IDS/IPS, Proxy- oder WAF-Komponenten müssen in den Fabric-Verkehr eingebunden werden. Dabei ist die Frage entscheidend: Werden diese Services zentral (North-South) genutzt oder auch für Ost-West-Policies (East-West) benötigt?

- North-South-Perimeter: Internet- und WAN-Übergänge, DMZ, zentrale Security-Gateways.

- East-West-Kontrollen: Segmentierung zwischen Applikations- und Datenzonen, Schutz vor lateraler Bewegung.

- Service-Insertion-Design: Traffic gezielt über Security-/LB-Services führen, ohne unkontrollierte Umwege zu erzeugen.

- Kapazität und State: Firewalls und LBs müssen Sessions und Durchsatz auch im Failover tragen können.

Adressierung und Namenskonventionen: Ordnung als Skalierungsfaktor

Spine-Leaf wirkt nur dann „einfach“, wenn Adressierung, Benennung und Dokumentation sauber sind. Ein durchdachter IP-Plan für Underlay und Overlay reduziert Fehlkonfigurationen und beschleunigt Erweiterungen.

- Underlay-IP-Plan: konsistente Punkt-zu-Punkt-Adressierung, klare Zusammenhänge, sinnvolle Reserven.

- Overlay-Segmente: eindeutige Segment-/Zonenbenennung, saubere Zuordnung zu VRFs/VLANs.

- Gerätenamen: Standort/Rack/Row/Role in Namenskonventionen, damit Topologie sofort erkennbar ist.

- Dokumentation: Topologie, Portpläne, Abhängigkeiten, Servicepfade, Change-Historie.

Monitoring und Observability: Fabric-Betrieb ohne Blindflug

Mit steigender Bandbreite und mehr parallelen Pfaden wird die Fehlersuche ohne Observability schnell schwierig. Ein modernes Rechenzentrumsnetz sollte deshalb Telemetrie, Logs und Traffic-Analysen von Beginn an einplanen. Ziel ist, nicht nur „Link up/down“ zu sehen, sondern echte Auswirkungen auf Anwendungen zu erkennen.

- Metriken: Auslastung, Drops, Fehlerzähler, Latenzindikatoren, Queue-Statistiken.

- Logs: Routing-Änderungen, Link-Flaps, Policy-Drops, Konfigurationsänderungen.

- Flow-Daten: Top-Talker, East-West-Muster, ungewöhnliche Verbindungen, Trendanalysen.

- Synthetische Tests: Erreichbarkeit und Antwortzeiten kritischer Applikationspfade zwischen Zonen.

Wenn Nachweisbarkeit und Prozesskontrollen wichtig sind, kann ein Rahmen wie ISO/IEC 27001 helfen, Logging, Verantwortlichkeiten und Review-Zyklen verbindlich zu verankern.

Automatisierung und Betrieb: Warum Fabrics Standards brauchen

Spine-Leaf-Designs werden in der Praxis oft dann „teuer“, wenn Betrieb und Changes nicht standardisiert sind. Jede Erweiterung – neue Leafs, neue Segmente, neue Policies – sollte nach einem wiederholbaren Verfahren erfolgen. Automatisierung muss dabei nicht sofort maximal komplex sein, aber Templates und Versionierung sind in modernen DCs fast unverzichtbar.

- Templates: wiederverwendbare Basiskonfigurationen für Leafs und Spines.

- Versionierung: nachvollziehbare Änderungen, schnelle Rollbacks, bessere Audits.

- Automatisierte Validierung: Checks vor Rollout (z. B. Adressierung, Policy-Consistency, Routing-Health).

- Staged Rollouts: Änderungen zuerst pilotieren, dann in Wellen ausrollen, um Fehlerdomänen klein zu halten.

Typische Fehler bei der Planung einer Spine-Leaf-Architektur

Viele Probleme entstehen nicht durch das Konzept, sondern durch falsche Annahmen oder eine zu schnelle Umsetzung ohne saubere Vorarbeit. Diese Stolpersteine treten besonders häufig auf.

- Underlay/Overlay unklar: fehlende Ordnung im IP-Plan, inkonsistente Routing-Parameter, unklare Verantwortlichkeiten.

- Kapazität zu knapp: Oversubscription zu aggressiv, Spine-Kapazität unterschätzt, Failover nicht berücksichtigt.

- Zu große Layer-2-Ansprüche: Broadcast-Domänen wachsen, weil Legacy-Anforderungen nicht sauber isoliert werden.

- Security „später“: Segmentierung und Service-Insertion werden nachträglich ergänzt und erzeugen Umwege und Regelchaos.

- Keine Tests: Failover, Konvergenz und Performance werden nicht real geprüft, sondern nur angenommen.

- Zu wenig Observability: fehlende Telemetrie und Logs machen Troubleshooting langsam und teuer.

Schritt-für-Schritt: Spine-Leaf im Rechenzentrum planen

- Anforderungen erfassen: Workload-Typen, East-West/North-South-Anteile, Verfügbarkeitsziele, Security-Zonen, Wachstum.

- Topologie festlegen: Anzahl Leafs/Spines, Uplink-Geschwindigkeiten, Redundanz, Rack-/Row-Design.

- Underlay designen: IP-Plan, Routing-Konzept, ECMP, Failure Detection, klare Standards.

- Overlay/Segmentierung planen: Zonenmodell, VRFs/VLANs, Policies, Servicepfade.

- Kapazität dimensionieren: Oversubscription, Peak-Lasten, Failover-Kapazität, Wachstumstrigger.

- Integration definieren: Firewalls, Load Balancer, DMZ, Storage, Management-Netze.

- Monitoring einplanen: Metriken, Logs, Flow-Daten, synthetische Pfadtests.

- Rollout- und Testplan: Pilot, staged Deployment, Failover-Tests, Abnahmekriterien, Rollback.

- Betrieb standardisieren: Templates, Versionierung, Change-Prozess, regelmäßige Reviews.

Praxis-Checkliste: Erfolgsfaktoren für moderne Rechenzentrumsnetze

- Planen Sie Spine-Leaf anhand realer Workload- und Traffic-Anforderungen, nicht nur nach „Best Practice“.

- Setzen Sie auf ein sauberes Layer-3-Underlay mit ECMP und klaren Standards.

- Definieren Sie Zonen und Segmentierung früh; kontrollierte Übergänge verhindern spätere Regelkomplexität.

- Dimensionieren Sie Kapazität inklusive Failover und definieren Sie Wachstumstrigger für neue Leafs/Spines.

- Berücksichtigen Sie Service-Insertion (Firewall/LB) als Teil der Architektur, nicht als nachträglichen Umweg.

- Verankern Sie Observability: Telemetrie, Logs und Flow-Analysen sind für Fabrics entscheidend.

- Standardisieren und automatisieren Sie Betrieb und Rollouts, um Konfigurationsdrift zu vermeiden.

- Testen Sie Failover und Performance regelmäßig mit realen Anwendungspfaden, nicht nur mit Connectivity-Checks.

Cisco Netzwerkdesign, CCNA Support & Packet Tracer Projekte

Cisco Networking • CCNA • Packet Tracer • Network Configuration

Ich biete professionelle Unterstützung im Bereich Cisco Computer Networking, einschließlich CCNA-relevanter Konfigurationen, Netzwerkdesign und komplexer Packet-Tracer-Projekte. Die Lösungen werden praxisnah, strukturiert und nach aktuellen Netzwerkstandards umgesetzt.

Diese Dienstleistung eignet sich für Unternehmen, IT-Teams, Studierende sowie angehende CCNA-Kandidaten, die fundierte Netzwerkstrukturen planen oder bestehende Infrastrukturen optimieren möchten. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

Netzwerkdesign & Topologie-Planung

-

Router- & Switch-Konfiguration (Cisco IOS)

-

VLAN, Inter-VLAN Routing

-

OSPF, RIP, EIGRP (Grundlagen & Implementierung)

-

NAT, ACL, DHCP, DNS-Konfiguration

-

Troubleshooting & Netzwerkoptimierung

-

Packet Tracer Projektentwicklung & Dokumentation

-

CCNA Lern- & Praxisunterstützung

Lieferumfang:

-

Konfigurationsdateien

-

Packet-Tracer-Dateien (.pkt)

-

Netzwerkdokumentation

-

Schritt-für-Schritt-Erklärungen (auf Wunsch)

Arbeitsweise:Strukturiert • Praxisorientiert • Zuverlässig • Technisch fundiert

CTA:

Benötigen Sie professionelle Unterstützung im Cisco Networking oder für ein CCNA-Projekt?

Kontaktieren Sie mich gerne für eine Projektanfrage oder ein unverbindliches Gespräch. Finden Sie mich auf Fiverr.