TinyML steht für „Tiny Machine Learning“ und beschreibt den Einsatz von Künstlicher Intelligenz direkt auf Mikrocontrollern – also auf sehr kleinen, energieeffizienten Chips, wie sie in Sensoren, Wearables, Smart-Home-Geräten oder Industrie-Sensorik stecken. Statt Daten permanent in die Cloud zu senden oder ein leistungsstarkes Edge-Gateway zu benötigen, läuft das ML-Modell lokal auf dem Gerät: Es erkennt Muster, klassifiziert Signale oder trifft einfache Entscheidungen in Echtzeit. Das bringt mehrere Vorteile: geringere Latenz, weniger Datenverkehr, bessere Privatsphäre und oft ein deutlich niedrigerer Energieverbrauch, weil Funkmodule seltener aktiv sind. Gleichzeitig setzt TinyML klare Grenzen: Speicher, Rechenleistung und Flash sind knapp, und Modelle müssen stark optimiert werden. Wer TinyML versteht, kann jedoch erstaunlich leistungsfähige Anwendungen bauen – von Geräuscherkennung („Glassbruch“ vs. „Türknall“) über Vibrationsanalyse an Maschinen bis zu Gestensteuerung oder Zustandsklassifikation von Sensoren. In diesem Artikel erfahren Sie, was TinyML genau ist, welche Hardware sich eignet, wie der typische Workflow vom Training bis zum Deployment aussieht, welche Modellarten in der Praxis funktionieren und worauf Sie achten müssen, damit Künstliche Intelligenz auf dem Mikrocontroller zuverlässig, schnell und wartbar bleibt.

Was ist TinyML und wie unterscheidet es sich von „normaler“ KI?

TinyML ist kein neues Lernverfahren, sondern eine angepasste Umsetzung von Machine Learning für extrem ressourcenbegrenzte Systeme. Während klassische KI-Anwendungen oft auf Servern, GPUs oder leistungsfähigen Edge-Computern laufen, arbeitet TinyML meist mit wenigen hundert Kilobyte RAM und einigen Megabyte Flash – manchmal sogar deutlich weniger. Der Fokus liegt auf Inference, also der Ausführung eines bereits trainierten Modells. Das Training findet in den meisten Fällen auf einem PC oder in der Cloud statt, weil dafür mehr Rechenleistung und Datenhaltung benötigt werden.

- Training: meist offline (PC/Cloud), rechenintensiv, iterativ

- Inference: läuft auf dem Mikrocontroller, möglichst schnell und energiesparend

- Modelle: stark komprimiert (z. B. Quantisierung), oft auf kleine Architekturen begrenzt

- Ziel: robuste Erkennung aus Sensordaten, nicht „generative KI“ oder große Sprachmodelle

Als Einstieg in die Grundlagen eignet sich Maschinelles Lernen. Für eine Einordnung von Mikrocontrollern ist Mikrocontroller hilfreich.

Warum TinyML auf dem Mikrocontroller so attraktiv ist

Viele Projekte scheitern nicht an der Idee, sondern an der Systemrealität: Funk kostet Energie, Cloud kostet Geld, Latenz stört UX, und Datenschutzanforderungen werden strenger. TinyML verschiebt die Auswertung an den Rand, direkt in das Gerät. Das ist besonders sinnvoll, wenn Sensordaten häufig anfallen, aber nur selten ein relevantes Ereignis enthalten. Ein Mikrocontroller kann dann „vorsortieren“ und nur bei Bedarf melden.

- Datenschutz: Rohdaten bleiben lokal, weniger Übertragung sensibler Informationen

- Latenz: Entscheidungen in Millisekunden statt Netzwerk-Roundtrips

- Energie: Funk kann schlafen, weil lokale Inferenz vorfiltert

- Robustheit: funktioniert auch ohne Internet und bei schlechtem Empfang

- Kosten: weniger Cloud-Traffic, weniger Serverlast, kleinere Infrastruktur

Typische TinyML-Use-Cases, die in der Praxis gut funktionieren

TinyML glänzt dort, wo Sensorik kontinuierlich Daten liefert und Muster erkennbar sind. Dazu gehören Audiosignale (Schlagworte, Geräusche), Beschleunigungsdaten (Gesten, Aktivität), Vibrationsdaten (Anomalien), sowie einfache Bildaufgaben mit sehr kleinen Kameras – wobei Bildverarbeitung meist höhere Anforderungen an RAM und Rechenleistung stellt.

Welche Hardware eignet sich für TinyML?

Nicht jeder Mikrocontroller ist gleich gut geeignet. Für TinyML zählen vor allem: genügend RAM für Zwischendaten, ausreichend Flash für Modell und Programm, sowie eine CPU, die mit Matrix- und Vektoroperationen halbwegs effizient umgehen kann. In vielen Fällen sind ARM Cortex-M-Controller eine solide Basis. Einige Chips bieten zusätzliche Beschleunigung, etwa DSP-Instruktionen oder spezielle ML-Beschleuniger. Für Einsteiger sind Boards mit guter Dokumentation und stabilen Toolchains besonders wichtig.

- RAM: häufig der Engpass (Zwischentensoren, Puffer, Feature-Extraction)

- Flash: Modellgröße und Firmware müssen hinein passen

- CPU/DSP: ARM Cortex-M4/M7 (DSP), Cortex-M33, oder neuere Varianten

- Peripherie: Sensoranbindung (I2C/SPI/ADC), ggf. Mikrofon (I2S/PDM)

- Stromsparmodi: relevant für batteriebetriebene KI-Sensoren

Wenn Sie Boards vergleichen, hilft ein Blick auf die allgemeinen Konzepte von ARM-Architektur sowie auf typische Cortex-M-Familien in Herstellerdokumentationen.

Warum „mehr MHz“ nicht automatisch „mehr TinyML“ bedeutet

Die Performance hängt nicht nur vom Takt ab, sondern von Speicherzugriffen, Cache, DSP-Instruktionen und der Effizienz der Inferenzbibliothek. Ein Controller mit moderatem Takt, aber guter DSP-Unterstützung, kann in TinyML schneller sein als ein höher getakteter Chip ohne passende Instruktionen.

Der TinyML-Workflow: Von Daten bis zum Modell auf dem Chip

Ein sauberer TinyML-Prozess besteht aus mehreren Schritten. Der häufigste Fehler ist, direkt mit „Modelltraining“ zu beginnen, ohne die Datenqualität und das Problem sauber zu definieren. In TinyML ist Datenarbeit oft wichtiger als Modellkomplexität.

- Problemdefinition: Was soll erkannt werden? Welche Klassen? Welche Fehlalarme sind tolerierbar?

- Datenerfassung: Sensorwerte unter realen Bedingungen sammeln (Gerät, Gehäuse, Montage)

- Labeling: Daten korrekt beschriften (Zeitfenster, Ereignisse, Störfälle)

- Feature-Engineering oder End-to-End: Merkmale berechnen (z. B. FFT) oder direkt Rohdaten nutzen

- Modelltraining: auf PC/Cloud, mit Train/Validation/Test

- Optimierung: Quantisierung, Pruning, Architektur vereinfachen

- Deployment: Modell konvertieren, in Firmware integrieren, testen

Für die Modellkonvertierung und Embedded-Inferenz ist TensorFlow Lite for Microcontrollers eine zentrale Ressource. Für einen Überblick zu TensorFlow Lite allgemein ist TensorFlow Lite hilfreich.

Modelle für TinyML: Was passt auf kleine Systeme?

Auf Mikrocontrollern funktionieren vor allem Modelle, die wenig Speicher brauchen und mit begrenzter Rechenleistung auskommen. Häufig sind das kleine neuronale Netze (z. B. 1D-CNNs für Sensordaten), einfache Fully-Connected-Netze oder auch klassische Verfahren (z. B. Entscheidungsbäume), sofern eine passende Laufzeitumgebung vorhanden ist. In der Praxis wird häufig ein hybrider Ansatz genutzt: Erst Feature-Extraction (z. B. Spektralmerkmale), dann ein kleines Netz zur Klassifikation.

- Audio: MFCCs oder Log-Mel-Spektrogramme + kleines CNN

- Vibration/IMU: Zeitfenster + 1D-CNN oder kleines MLP

- Anomalieerkennung: Autoencoder oder statistische Merkmale + Klassifikator

- Vision (klein): stark reduzierte Auflösung, sehr kleine CNNs

Feature-Extraction: Die unterschätzte Superkraft bei TinyML

Wenn Sie Rohdaten direkt ins Netz geben, steigen Speicher und Rechenlast. Durch Feature-Extraction (z. B. FFT-basierte Merkmale, RMS, Spektralpeaks, Statistik pro Fenster) können Modelle deutlich kleiner und stabiler werden. Das ist keine „alte Schule“, sondern oft der effizienteste Weg, um TinyML alltagstauglich zu machen.

Optimierung: Quantisierung, Modellgröße und Inferenzgeschwindigkeit

Damit ein Modell auf einen Mikrocontroller passt, wird es fast immer optimiert. Die wichtigste Technik ist die Quantisierung: Statt 32-Bit-Floating-Point (float) werden Gewichte und Aktivierungen in 8-Bit-Integern (int8) dargestellt. Das reduziert Speicherbedarf deutlich und kann die Inferenz beschleunigen, insbesondere wenn die Library int8 effizient unterstützt. Zusätzlich können Sie die Architektur vereinfachen, Layer verkleinern oder weniger Filter verwenden.

- Post-Training Quantization: Modell nach dem Training quantisieren

- Quantization-Aware Training: Training berücksichtigt späteres int8-Verhalten

- Pruning: unwichtige Gewichte entfernen (je nach Tooling)

- Architektur-Tuning: weniger Parameter, kürzere Eingabefenster, kleinere Feature-Sets

- Benchmarking: Laufzeit und RAM-Verbrauch auf der Zielhardware messen

Für Hintergründe zur Quantisierung im ML-Kontext bietet Quantisierung einen grundlegenden Einstieg, auch wenn TinyML-spezifische Details meist in Framework-Dokumentationen stehen.

Speicher verstehen: Warum RAM meist der limitierende Faktor ist

Viele Einsteiger schauen zuerst auf die Modellgröße in Kilobyte und vergessen den RAM-Bedarf während der Inferenz. In TinyML wird neben den Gewichten auch Speicher für Zwischentensoren, Eingabepuffer, Feature-Extraction und Stack benötigt. Ein Modell, das „auf den Flash passt“, kann trotzdem scheitern, wenn die Aktivierungen zu groß sind. Deshalb ist Speicherplanung ein Muss.

- Flash: Modellgewichte + Code + ggf. Lookup-Tabellen

- RAM: Eingabefenster, Feature-Puffer, Aktivierungen, Tensor-Arena

- Worst-Case: Peaks treten bei bestimmten Layern auf (z. B. Convs mit großen Featuremaps)

- Praxis: Modell-Profiler und Inferenz-Reports nutzen, dann iterativ vereinfachen

Tensor-Arena: Ein typisches Konzept bei Embedded-Inferenz

Viele Microcontroller-Inferenzumgebungen arbeiten mit einer statisch reservierten Speicherregion („Arena“) für Tensoren. Das ist für deterministischen Speicherverbrauch ideal, erfordert aber, dass Sie die Arena groß genug wählen – sonst läuft die Inferenz nicht.

Energie und Echtzeit: TinyML richtig in Low-Power-Systeme integrieren

TinyML kann Energie sparen, wenn es intelligent eingesetzt wird. Der Trick ist, nicht dauerhaft „volle Inferenz“ laufen zu lassen, sondern in Stufen zu denken. Beispiel Audio: Ein sehr einfacher Energie-Detektor (oder ein kleiner Vorfilter) läuft ständig, und nur bei Auffälligkeiten wird das eigentliche Modell aktiviert. Danach kann das System wieder schlafen. Bei Sensoren wie IMU oder Vibrationsmessung ist es ähnlich: Ereignisbasiertes Aufwachen reduziert den Duty-Cycle.

- Hierarchische Pipeline: Vorfilter (billig) → Modell (teurer) → Aktion/Funk

- Duty-Cycling: seltene Fensterverarbeitung statt Dauerbetrieb

- Interrupts/Events: Sensoren können Wakeups auslösen

- Timing: Inferenzzeit muss in den Echtzeitplan passen (z. B. alle 100 ms)

Datenschutz und Sicherheit: Lokal ist nicht automatisch sicher

Ein großer Vorteil von TinyML ist, dass weniger Rohdaten übertragen werden. Trotzdem bleibt Sicherheit relevant: Modelle können Rückschlüsse zulassen, Firmware kann ausgelesen werden, und ein Gerät im Heimnetz muss abgesichert sein. Außerdem sollten Sie in sensiblen Anwendungsfällen bedenken, dass auch lokale Klassifikationen personenbezogene Daten betreffen können (z. B. akustische Erkennung). Verantwortungsvolle Entwicklung bedeutet: minimale Datenerfassung, klare Zweckbindung und sichere Updates.

- Datensparsamkeit: nur Merkmale/Events statt Rohdaten speichern oder senden

- Secure Boot & Signaturen: Firmware-Integrität sicherstellen (wenn Plattform unterstützt)

- Model Protection: Schutz vor Auslesen, je nach Bedrohungsmodell

- Transparenz: dokumentieren, was erkannt wird und was nicht

Edge-Inferenz als Privacy-Pattern

Wenn das Gerät nur „Ereignisse“ meldet (z. B. „Bewegung erkannt“), statt Rohdaten zu streamen, reduziert das Angriffs- und Datenschutzrisiko erheblich. Dennoch bleibt die Absicherung des Geräts selbst entscheidend.

Testing in der Realität: Genauigkeit ist mehr als eine Zahl

Ein TinyML-Modell kann im Notebook hervorragend aussehen und auf dem Gerät trotzdem enttäuschen. Gründe sind: andere Sensorposition, andere Montage, Gehäuseeffekte, Umgebungsgeräusche, variierende Nutzer, Temperatur, Alterung. Deshalb ist Real-World-Testing zentral. Neben Accuracy sind Metriken wie Precision/Recall, False Positives pro Stunde und Reaktionszeit oft wichtiger. In vielen Anwendungen ist ein „falscher Alarm“ schlimmer als ein gelegentlich verpasstes Ereignis – oder umgekehrt.

- Validierung unter echten Bedingungen: nicht nur Labor- oder Schreibtischtests

- Fehlalarme messen: Rate pro Zeit statt nur pro Datensatz

- Drift berücksichtigen: neue Umgebungen, andere Nutzer, Saison-/Temperaturwechsel

- Monitoring: Telemetrie über Modellkonfidenz (wenn möglich) für spätere Verbesserungen

Häufige Anfängerfehler bei TinyML-Projekten

TinyML scheitert selten an „zu wenig KI“ – meist an unklaren Anforderungen, schlechten Daten oder falscher Systemintegration. Die gute Nachricht: Diese Probleme lassen sich mit methodischem Vorgehen vermeiden.

- Zu wenig und zu saubere Daten: nur perfekte Beispiele, keine Störfälle, keine Varianten

- Overfitting: Modell lernt Trainingsumgebung statt Muster

- Fehlende Baseline: kein Vergleich zu einfachen Schwellwerten oder klassischen Features

- Unterschätzter RAM: Modell passt in Flash, scheitert aber an Aktivierungen

- Keine Robustheitsstrategie: keine Hysterese, kein Debouncing, kein Mehrfach-Check

- Zu wenig Systemdenken: Funk, Sensor, Stromversorgung, Timing nicht gemeinsam betrachtet

Baseline zuerst: Warum einfache Regeln oft der beste Start sind

Bevor Sie ein neuronales Netz einsetzen, lohnt sich eine Baseline: einfache Features, Schwellwerte, Klassifikator mit wenigen Parametern. Wenn die Baseline bereits nahe am Ziel ist, wird TinyML klarer, kleiner und zuverlässiger – und Sie wissen besser, was das Modell wirklich beitragen muss.

Outbound-Ressourcen zur Vertiefung

- TensorFlow Lite for Microcontrollers: Offizielle Dokumentation für Embedded-Inferenz

- TensorFlow Lite: Mobile und Edge-Optimierungen

- Maschinelles Lernen: Grundlagen und Begriffe

- Mikrocontroller: Architektur und typische Einsatzgebiete

- Edge Computing: Einordnung von TinyML im Gesamtsystem

IoT-PCB-Design, Mikrocontroller-Programmierung & Firmware-Entwicklung

PCB Design • Arduino • Embedded Systems • Firmware

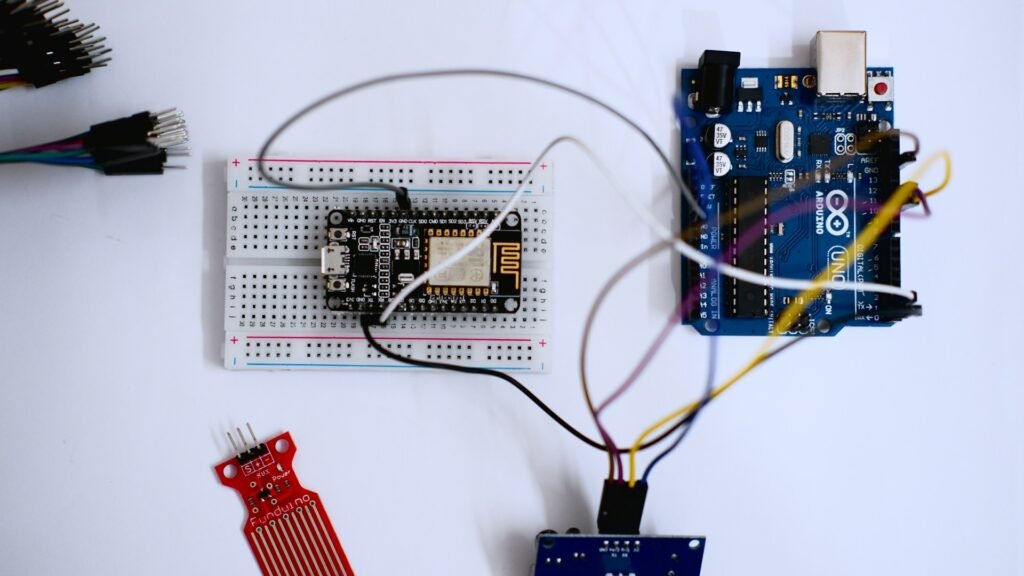

Ich biete professionelle Entwicklung von IoT-Hardware, einschließlich PCB-Design, Arduino- und Mikrocontroller-Programmierung sowie Firmware-Entwicklung. Die Lösungen werden zuverlässig, effizient und anwendungsorientiert umgesetzt – von der Konzeptphase bis zum funktionsfähigen Prototyp.

Diese Dienstleistung richtet sich an Unternehmen, Start-ups, Entwickler und Produktteams, die maßgeschneiderte Embedded- und IoT-Lösungen benötigen. Finden Sie mich auf Fiverr.

Leistungsumfang:

-

IoT-PCB-Design & Schaltplanerstellung

-

Leiterplattenlayout (mehrlagig, produktionstauglich)

-

Arduino- & Mikrocontroller-Programmierung (z. B. ESP32, STM32, ATmega)

-

Firmware-Entwicklung für Embedded Systems

-

Sensor- & Aktor-Integration

-

Kommunikation: Wi-Fi, Bluetooth, MQTT, I²C, SPI, UART

-

Optimierung für Leistung, Stabilität & Energieeffizienz

Lieferumfang:

-

Schaltpläne & PCB-Layouts

-

Gerber- & Produktionsdaten

-

Quellcode & Firmware

-

Dokumentation & Support zur Integration

Arbeitsweise:Strukturiert • Zuverlässig • Hardware-nah • Produktorientiert

CTA:

Planen Sie ein IoT- oder Embedded-System-Projekt?

Kontaktieren Sie mich gerne für eine technische Abstimmung oder ein unverbindliches Angebot. Finden Sie mich auf Fiverr.