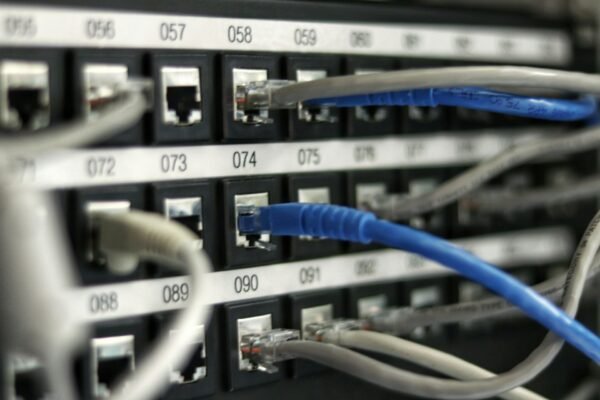

L1-Dokumentation, die im Incident hilft (nicht nur Deko)

Die Qualität von L1-Dokumentation, die im Incident hilft (nicht nur Deko), entscheidet im Ernstfall oft darüber, ob ein Team in Minuten oder in Stunden zur Ursache kommt. In vielen Organisationen existieren zwar Rack-Pläne, Patchlisten und Inventar-Tabellen, doch sie sind unvollständig, veraltet oder so unpraktisch aufgebaut, dass sie während einer Störung kaum nutzbar sind. Genau das…